Hamarosan jön az AI-hatóság, amihez fordulhatunk, ha átvert a ChatGPT

„Az esszenciája a törvénynek az, hogy figyeljünk oda. Az eddigieknél sokkal jobban figyeljünk arra, hogy mit engedünk piacra lépni, és a fejlesztési folyamatainkba építsünk bele olyan fékeket és ellensúlyokat, hogy a fejlesztési folyamat minden lépcsőjén, minden abban résztvevő ember gondolja végig, hogy ezt jól csináljuk-e. Ez szerintem nettóban pozitív” – értékelte Tilesch György globális mesterségesintelligencia-szakértő, a PHI Institute elnöke a Qubitnek a mesterséges intelligenciáról szóló európai uniós szabályozást (AI Act), amely múlt csütörtökön lépett hatályba. „Ahhoz borzasztóan jól hozzájárul, hogy ne szaladjon el velünk a ló, és az európai értékeket megfelelő mértékben oltalomban részesítsük. Az, hogy technikailag jól csinálja-e az Európai Unió azt, amit csinál, ott már sokkal több kritikám van.”

Az EU és a szakértők által úttörőnek tartott szabályozásról tavaly decemberben állapodtak meg Brüsszelben, és azt az Európai Parlament idén márciusban fogadta el nagy többséggel. De milyen konkrét következménye lehet az AI-jogszabálynak és más uniós törvényeknek a sokak által használt chatbotokra, valamint a többségében nem európai technológiai vállalatok által az elmúlt időszakban bemutatott AI-újításokra? És mit gondolnak az AI Act kritikusai, valamint támogatói?

Nemet mondtak a biometrikus besorolásnak és az emberi viselkedést manipuláló AI-rendszereknek

A jogszabály, mint korábban összefoglaltuk, megtiltja azokat a mesterséges intelligenciára épülő alkalmazásokat, amelyek az állampolgári jogokat veszélyeztetik – köztük az internetes vagy biztonságikamera-felvételeken alapuló biometrikus besorolási rendszereket, a személyre szóló algoritmikus értékelést, vagy az emberi viselkedést manipuláló AI-rendszereket. Emellett új kötelezettségeket vet ki az infrastruktúrában és társadalmi rendszerekben használt mesterségesintelligencia-algoritmusokra, az általános célú AI-modellek fejlesztőit pedig új átláthatósági követelményeknek történő megfelelésre kötelezi.

„Az EU AI-jogszabálya a világ első átfogó mesterségesintelligencia-törvénye. A célja, hogy kezelje az egészséggel, biztonsággal és alapvető jogokkal összefüggő kockázatokat. A szabályozás emellett megvédi a demokráciát, a jogállamot és a környezetet” – nyilatkozta a Qubitnek az Európai Bizottság. A Bizottság szerint az AI-rendszerek elterjedésének komoly társadalmi és gazdasági előnyei lehetnek, valamint elősegítheti az európai innovációt és az EU globális versenyképességét. Azonban, mint írják, bizonyos esetekben egyes AI-rendszerek jellemzői új kockázatokkal járhatnak a felhasználók biztonságára és alapvető jogaira. Néhány fejlett, széles körben használt AI-modell pedig rendszerszintű kockázatokat is tartogathat. “Ez jogi bizonytalansághoz, és a bizalomhiány miatt az AI-technológiák potenciálisan lassabb elterjedéséhez vezet a hatóságok, vállalatok és állampolgárok körében” – írták.

A Bizottság szerint ha egy egységes, a mesterséges intelligencia előnyeire és kockázataira is reflektáló AI-jogszabály helyett a technológiát nemzeti hatáskörben, eltérően kezdenék el a tagországok szabályozni, az az EU belső piacának széttöredezésével fenyegetne. Az AI-jogszabály – néhány specifikus rendelkezés kivételével – teljes egészében 2026. augusztus 2-ától lép majd életbe. Az AI-rendszerek ismeretével és a róluk történő oktatással összefüggő rendelkezések hat hónap múlva lesznek érvényesek, az általános célú mesterségesintelligencia-rendszerekre vonatkozó kötelezettségek csak jövő augusztusban lépnek életbe, a magas-kockázatú AI-rendszerekre szabottak pedig 2027. augusztus 2-ától.

A legjobb chatbotok mind hozzáférhetők az EU-ban, kivéve a Metáét

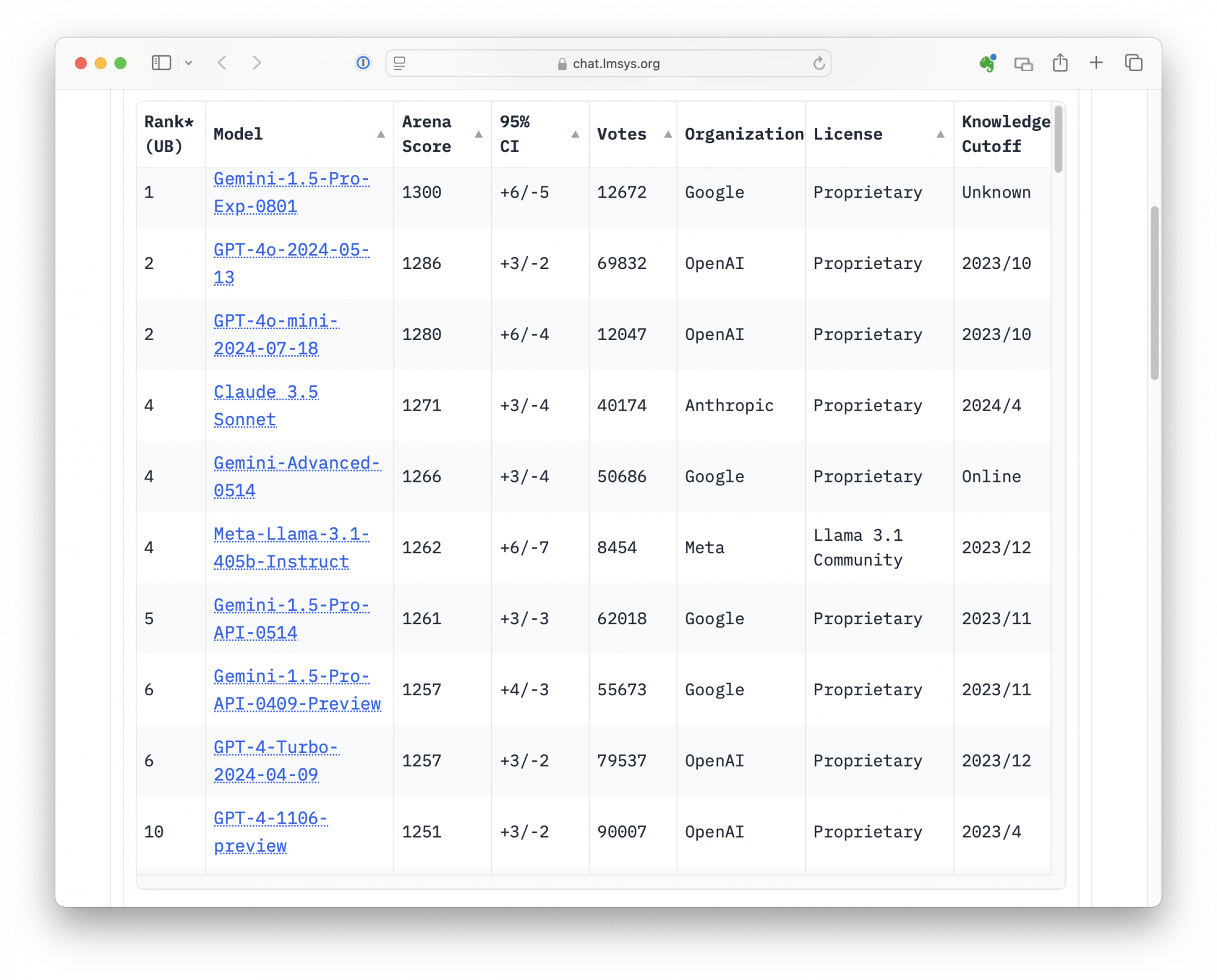

A cikk publikálásakor a felhasználók értékelései alapján összeállított LMSYS Chatbot Arena ranglistát a Google Gemini 1.5 Pro nagy nyelvi modellje (LLM) vezeti, a második és harmadik helyen pedig az OpenAI GPT-4o és GPT-4o mini modelljei állnak. Egy másik, szakemberek által összeállított tesztet alapul vevő ranglistán, a LiveBenchen a Gemini 1.5 Pro új változatának megjelenése előtt az Anthropic Claude 3.5 Sonnet állt az első helyen, a második a GPT-4o, harmadik pedig a Meta Llama 3.1 405B modellje volt. A vezető chatbotok a Llama 3.1 kivételével mind könnyen és problémamentesen hozzáférhetők az Európai Unióból, és ebben az AI-jogszabály hatályba lépése sem hozott változást.

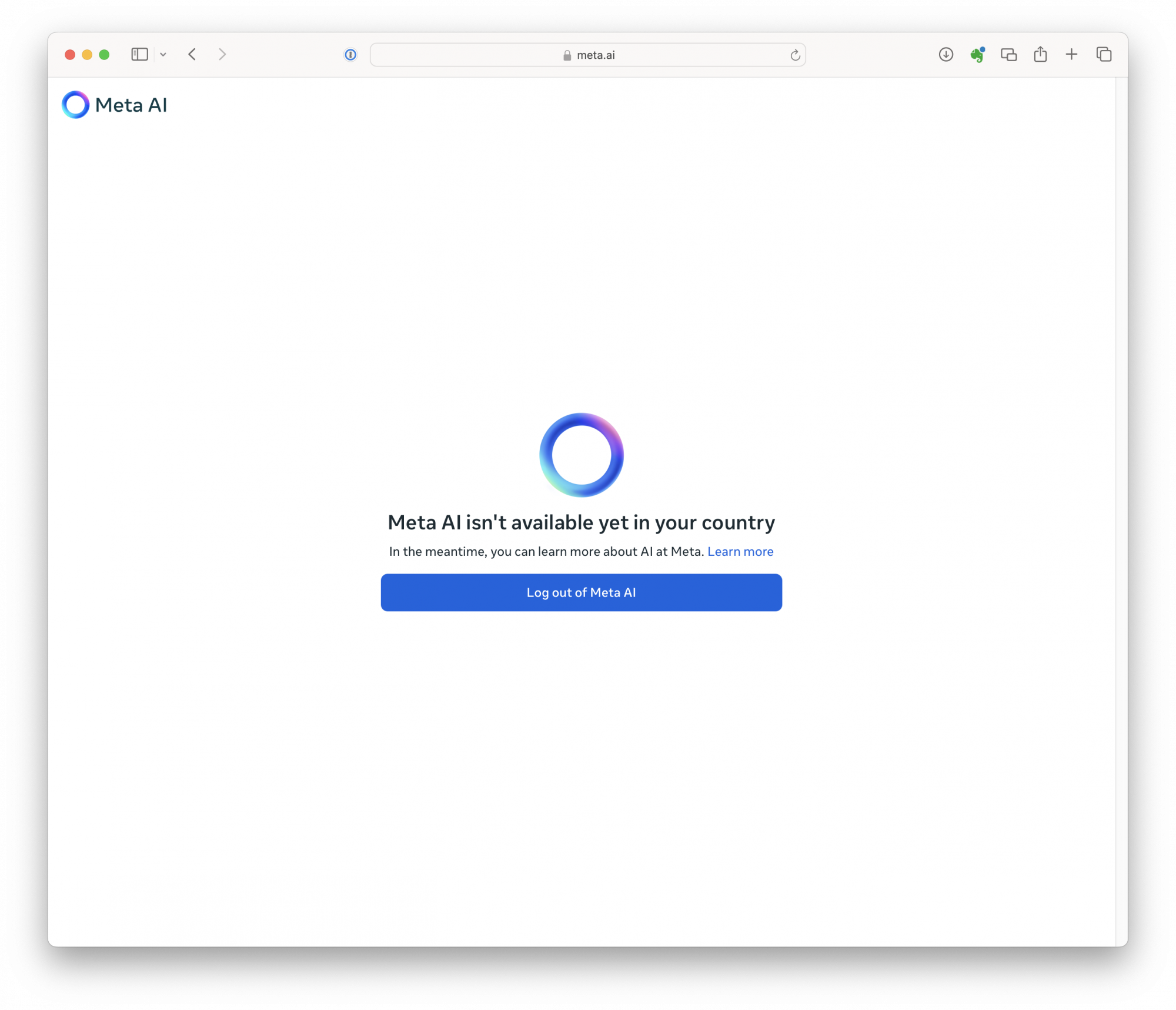

A Mark Zuckerberg által vezetett Meta még áprilisban jelentette be a LLama 3 generatív mesterséges intelligenciát, amit rögtön be is épített a cég több alkalmazásába, köztük az Instagramba, a Messengerbe és a WhatsAppba, valamint a Meta.ai weboldalon keresztül is elérhetővé tette. Az, hogy magyar és európai felhasználók ezekről még nem nagyon hallottak, nem véletlen: az EU-ban a chatbothoz ezeken a felületeken nem lehet hozzáférni, és ez a frissített Llama 3.1 verzió júliusi kiadásával sem változott. A helyzet furcsaságát csak fokozza, hogy a nyílt hozzáférésű Llama 3 és 3.1 modelleket bárki letöltheti az EU-ból is: bár a 405 milliárd paraméteres modell futtatásához extrém teljesítményű számítógépre van szükségünk, a 8 milliárd paraméteres verziót (8B) egy Ollamanak nevezett szoftverrel bárki kipróbálhatja egy modern PC-n vagy Mac-en.

A Meta július közepén az Axiosnak azt nyilatkozta, hogy a következő hónapokban várható multimodális – vagyis szövegek mellett képeket, hangokat és videókat is értelmezni képes – Llama modelljüket nem teszik majd elérhetővé az Európai Unióban az „európai szabályozási környezet kiszámíthatatlansága miatt”. Az Axios szerint a Metának nem az európai AI-jogszabállyal van problémája, hanem azzal, hogy nem tudja, miként tanítsa modelljeit európai felhasználók adatain, miközben betartja a GDPR adatvédelmi szabályozást. Tilesch szerint nem kell megrettenni ettől, ez nem sokáig fog tartani, ugyanis hiányozna a Metának az EU hatalmas piaca. „A Meta évente legalább kétszer megcsinálja azt, hogy elmondja, az adott térségben nem fognak szolgáltatni, aztán két hét múlva meggondolja magát. Én ezt nem annyira veszem komolyan” – mondta.

„A nagy platformok, különösen a Meta most azt az üzenetet hangsúlyozza minden európai fórumon, hogy a kkv-szektort meg kell menteni ezektől a szabályozási terhektől, és ennek az egyetlen módszere az, hogy nyílt forráskódú (open source) modelleket használnak. Ezt az AI Act hatálya alól ugyanis majdnem teljesen kivették. A Meta nemrég piacra is dobott egy open source modellt, a Llama 3.1-et, ami nem annyira multimodális, nem annyira széles körben alkalmazható, mint a GPT, de paramétereit, teljesítményét tekintve közel olyan jó. Amit látunk, az gyakorlatilag egy őrült versengés a cégek és az EU között, hogy kinek a narratívája győz” – mondta Tilesch. „Az open source pedig nagyon szépen hangzik, mint cél, csak az vele a probléma, hogy onnantól kezdve, hogy kikerült az éterbe, nem igazán tudod kontrollálni, mi történik vele. A feketepiacon meglévő, dezinformációra, terrorizmusra, bűnözésre használt AI-modellek mind open source modellekre épülnek.”

A cikk innentől csak a Qubit+ előfizetőinek elérhető.

Csatlakozz, és olvass tovább!

Ha már van előfizetésed, lépj be vele. Ha még nincs, válassz csomagjaink közül!