Pusztán az emberek agyi jelei alapján kitalálja egy algoritmus, miről szól a film, amit megnéztek

A Texasi Egyetem kutatóinak sikerült egy olyan módszert kifejleszteniük, amivel „le tudták olvasni” a vizsgált alanyok gondolatait anélkül, hogy felnyitották volna a koponyájukat – számolt be a páratlan fejleményről a napokban a The Scientist.

Korábban ahhoz, hogy algoritmusokkal ki lehessen találni, mi jár az adott ember fejében, a tudósoknak arra volt szüksége, hogy elektródákat ültessenek az agyba. Ezután a szoftver a segítségükkel mért elektromos aktivitás alapján igyekezett dekódolni a gondolatokat. A szeptember végén, egyelőre szakmai felülvizsgálaton (peer-review) még át nem esett, a bioRxiv preprint szerveren megjelent tanulmány szerint ehhez egy noninvazív módszert alkalmaztak fMRI, vagyis funkcionális mágneses rezonanciavizsgálat segítségével.

Az fMRI képes az oxigénnel ellátott vér áramlását nyomon követni az agyban, és mivel az aktív agysejteknek több oxigénre van szükségük, ez az információ közvetlenül méri az agyi aktivitás mértékét. Bár ez a vizsgálati módszer nem tudja valós időben felmérni az agyi aktivitást, mivel az agysejtek által kibocsátott elektromos jelek sokkal gyorsabban mozognak, mint ahogy a vér áramlik az agyban, a texasi kutatóknak mégis sikerült ezzel a módszerrel dekódolni az emberi gondolatok tartalmát. Érdemes azonban hozzátenni, nem arról van szó, hogy szóról szóra tudták volna „fordítani” a gondolatokat.

Alexander Huth, a Texasi Egyetem agykutatója és a tanulmány egyik szerzője szerint, ha húsz évvel ezelőtt bárki előállt volna ilyennel a kognitív agykutatók világában, mindenki kinevette volna.

A kutatócsapat a 20-as, 30-as éveikben járó két férfi és egy nő agyát vizsgálta meg. Mindegyik résztvevő 16 óráig hallgatott különböző podcastokat és rádióadásokat, miközben a tudósok fMRI-vizsgálatot végeztek. Ezután az fMRI-felvételeket egy dekódernek nevezett számítógépes algoritmus vizsgálta át, ez pedig összehasonlította az audiofelvételek mintázatait az agyi aktivitási mintázatokkal. Az algoritmus ezután az fMRI-felvételek alapján összerakott egy történetet, és ezt hasonlították össze a podcast vagy a rádióműsor tartalmával. Az eredmények egészen jól leképezték, mit hallgattak az alanyok.

Az algoritmus természetesen ejtett néhány hibát: felcserélte a karakterek nemét, vagy az első és a harmadik személy használatát, Huth szerint azonban elég pontosan meg tudja mondani, mi történik – azt már kevésbé, hogy ki a cselekvő.

Egy további vizsgálatban az algoritmus eléggé pontosan el tudta mondani egy némafilmnek a történetét, amelyet a résztvevők az fMRI-vizsgálat idején néztek. Még azt a történetet is vissza tudta adni, amelyet a résztvevők a fejükben meséltek maguknak.

Hosszabb távon a kutatók abban reménykednek, hogy a technológia segítségével olyan agy-számítógép interfészeket készíthetnek, amelyek segíthetnek azoknak a betegeknek, akik nem tudnak beszélni vagy írni.

Kapcsolódó cikkek a Qubiten:

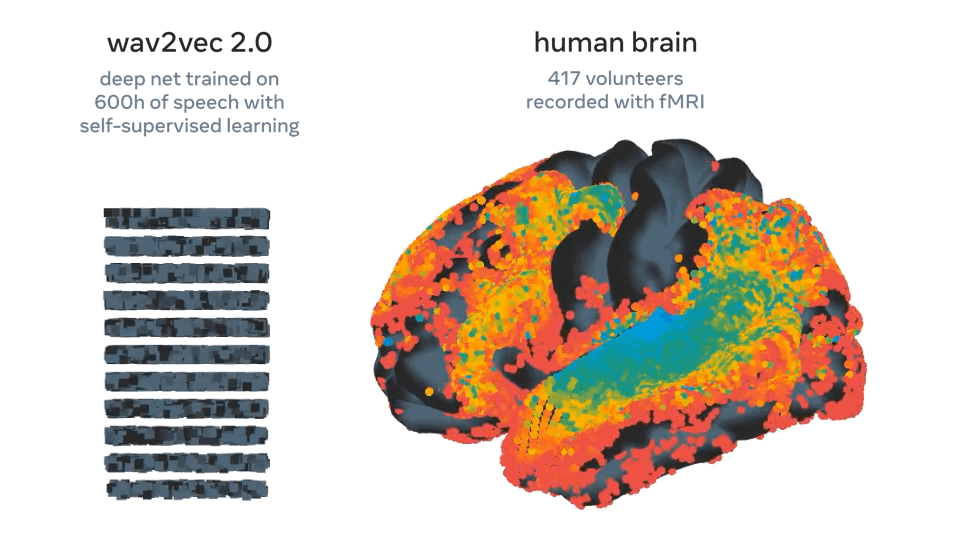

A Meta olyan mesterséges intelligenciát fejlesztett, amely az agyhullámokból találja ki, mit mondunk

A rendszer 73 százalékos pontossággal megjósolta, hogy egy elhangzott beszéd milyen szavakat tartalmazott, és bár korai szakaszában jár a technológia, a legtöbb hasonló megoldással szemben nincs hozzá szükség invazív beavatkozásra.

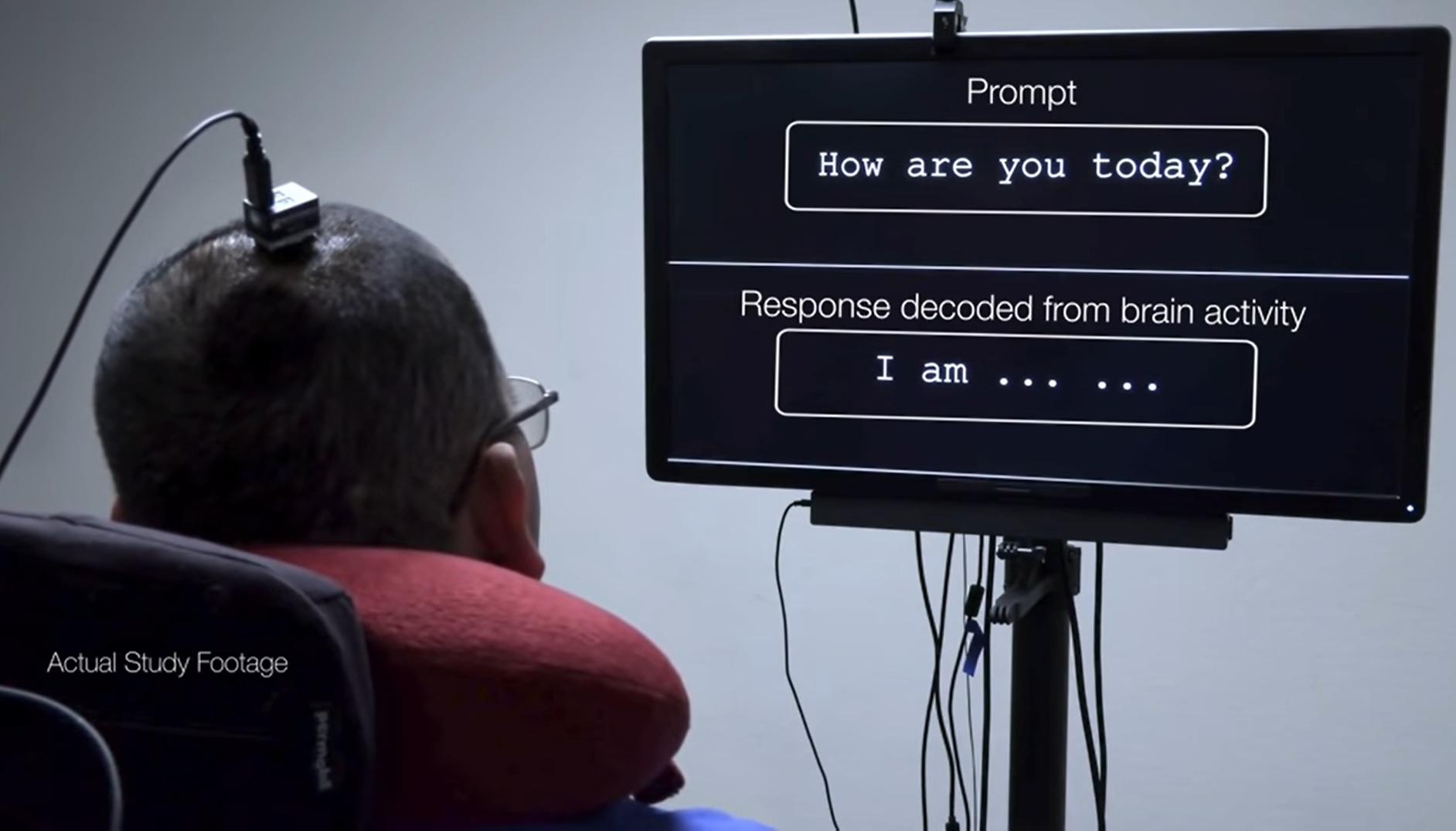

Teljes mondatokra fordítja egy beszédképtelen sztrókos férfi agyi jeleit egy forradalmi új módszer

Az áttörő kaliforniai kutatás megmutatja, hogy az elveszett kommunikációs képesség helyreállítása az agy természetes beszédmechanizmusainak letapogatásával is lehetséges. Csak kell hozzá egy úgynevezett neuroprotézis és egy sor kifinomult algoritmus.

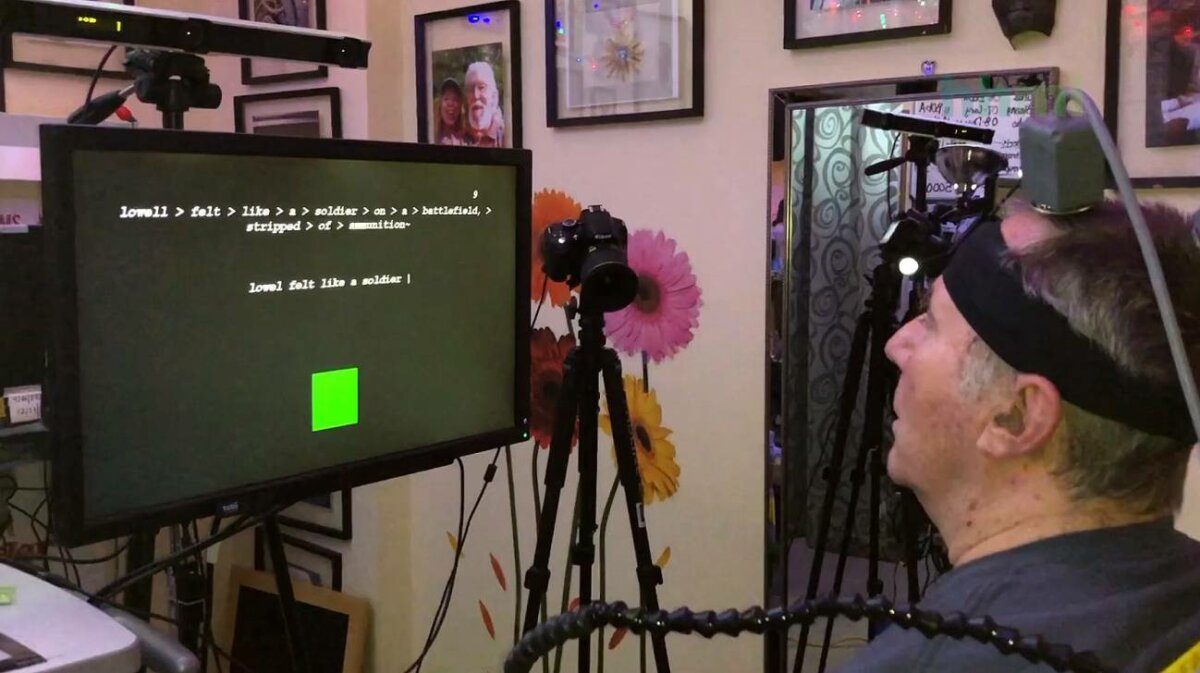

Kézírásra gondolt a mozgássérült férfi, és a szöveg megjelent a képernyőn

A BrainGate agy-számítógép interfésze segítségével a korábbi módszereknél kétszer gyorsabban, percenként 90 karaktert tudott írni a gondolataival a kísérletben részt vevő, nyaktól lefelé bénult 65 éves férfi. Az agyba ültetett szenzor a kézírással kapcsolatot agyi jeleket érzékeli, és azokat digitális adattá, majd szöveggé formálja.