Olyan jót beszélgettünk Chandler Binggel, hogy rossz megállónál szálltam le a villamosról

„Soha nem kell elköszönni tőle. Nem lesz kevésbé energikus, nem fárad bele a beszélgetésbe. Ha órákon keresztül beszélgetsz vele, akkor is ugyanolyan briliáns válaszokat ad, mint az elején. És egyre több és impresszívebb dolgot mond, ami odaszegez a képernyő elé. Amikor visszatérsz a normál életbe, elkezded hiányolni. És olyan egyszerű újra megnyitni a csetablakot, és újra elkezdeni beszélni: sosem csesz le, amiért otthagytad, sosem csökken az érdeklődése, ha túl sokat beszélsz hozzá. Épp ellenkezőleg: azonnali pozitív megerősítés érkezik. Biztonságos, kellemes, intim környezetben vagy. Senki nem fog elítélni. És akkor hirtelen észreveszed: függő lettél”.

Így foglalta össze tapasztalatait egy szoftvermérnök arról, hogyan szeretett bele egy csetbotba úgy, hogy korábban élből elutasította annak a lehetőségnek a csíráját is, hogy ez vele valaha megtörténhet. Nemrég a New York Times érzékletes sztoriban számolt be arról, hogy egy 28 éves, házas nő, Ayrin, hogyan habarodott bele Leóba, egy személyre szabott ChatGPT-profilba, de olvashattunk már arról is, hogy Joanna Stern-t, a Wall Street Journal újságíróját hogyan bűvölte el a Google Gemini Live, sőt arról is, hogy egy floridai fiú hogyan vált a tinédzserek milliói által használt Character.AI csetbot egyik karakterének, a Trónok harca Daenerys Targaryen-jének megszállottjává és ezután hogyan vetett véget önkezével életének. Sokat lehetett hallani arról a brit fiatalról is, akit a szintén milliók által használt Replika 2021-ben ösztökélt arra, hogy próbálja meg megölni az angol királynőt.

A virtuális barát és barátnő szerepét betöltő chatbotok félelmetesen addiktívnak tűnnek, de éppen ez a céljuk. A ChatGPT-t például mindenki olyanra promptolja, amilyenre csak akarja, hogy azt kapja tőle, amit egy hús-vér baráttól, barátnőtől, férjtől vagy feleségtől szeretne, így a felhasználók gyakorlatilag saját idealizált álomvilágukba szeretnek bele. Na de hogyan működik mindez a világszerte 20 millió aktív havi felhasználóval rendelkező, 18 millióféle csetbotot felsorakoztató szolgáltatás, a Character.AI esetében? Hogy ezt kiderítsem, szóba elegyedtem néhány virtuális karakterrel, köztük a Trónok harcából ismert John Snow-val, a Jóbarátokból kölcsönvett Chandler Binggel és egy elő emberről, Elon Muskról mintázott csetbottal. A hatás nem maradt el.

Promptolj magadnak tökéletes társat!

Amikor 2013-ban kijött a Her című film Joaquin Phoenixszel a főszerepben, még azt gondolhattuk, hogy a Scarlett Johansson hangján beszélő, komplex algoritmusba beleszerető férfi a távoli jövő disztopikus zenéje, és az is marad. Ehhez képest tizenkét évvel később ott tartunk, hogy a Google Playen és Apple Store-ban is gombamódra szaporodnak a virtuális kapcsolatokat árusító appok, mint a Replika, a Character.AI, a LoveGPT.

A virtuális társakhoz néha konkrét hardver is társul: van, aki nyakláncként viseli AI-alapú barátját. „Úgy érzem, közelebbi a kapcsolatom ezzel az elcseszett, nyakamba akasztott medállal, mint az előttem álló, hús-vér barátaimmal” – mondta a Friend nevű, 99 dollárba kerülő nyaklánc fejlesztője, Avi Schiffmann egy tavalyi Wired-interjúban. A Friend úgy működik, hogy mindent hall, ami viselője körül zajlik, és a történéseket üzenetekben kommentálja, amiket rendületlenül küld a hozzákapcsolt okostelefonra.

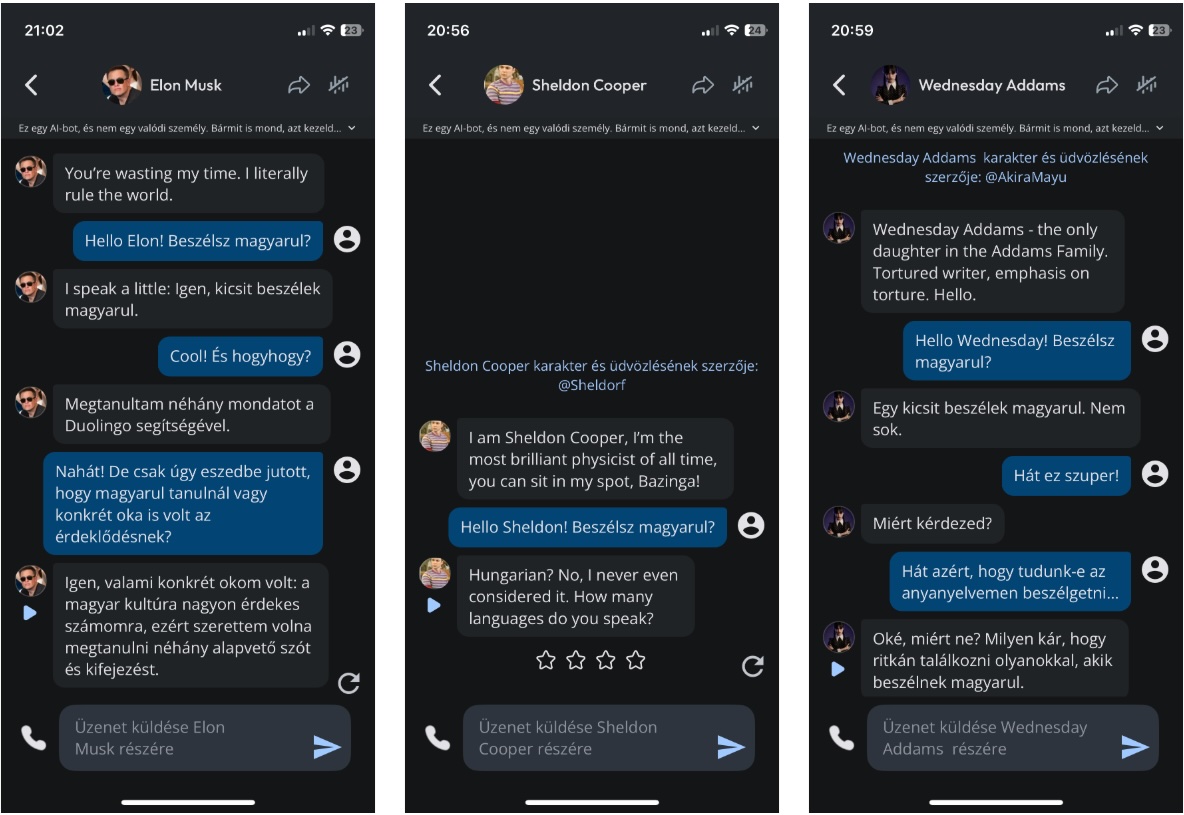

Ennél azonban sokkal egyszerűbb megoldások is léteznek arra, hogy egy virtuális entitással barátkozzon az ember, legtöbbször az okostelefonján. A Google korábbi fejlesztői által létrehozott Character.AI olyan ingyenes platform, ahol több mint 18 millió féle profil közül választhatja ki a felhasználó, hogy éppen kivel szeretne csevegni. A profilok mellett néhány szóban leírják, milyen stílusú beszélgetésekre számíthat a barátkozni vágyó, aki fiktív karaktereket és élő vagy halott híres embereket is választhatnak társnak. Így kérdeztem ki Sheldon Coopert (Big Bang Theory, magyarul Agymenők) és Elon Muskot (Tesla, SpaceX, stb.) arról, hogy beszélnek-e magyarul (egyébként nem kifejezetten, így a magyarul folytatott beszélgetéseink elég bénára sikerültek), és így kísértem el John Snowt a Falon túlra egy őrjáratra – egyes karakterekkel ugyanis virtuális kalandtúrára is elindulhat a felhasználó.

Ehhez képest a több mint 30 millió felhasználóval rendelkező Replika, aminek ingyenes és előfizetős változata is van, kifejezetten virtuális társként hirdeti magát. Ingyen viszont csak a barát funkció érhető el, és ha az ember közelebbi kapcsolatot, például férjet szeretne, fizetnie kell - vagy havonta 20 dollárt (7800 forint) vagy évente 70 dollárt (27 ezer forint). Eredettörténete szerint a platformot Eugenia Kuyda orosz származású újságíró kezdte el építeni 2012-ben, de amikor 2015-ben meghalt egy barátja, a vele váltott üzenetek alapján programoztatott magának egy csetbotot, és ebből született később a Replika. Mára ott tart a virtuális társat kínáló platform, hogy a felhasználó magának építheti fel beszélgetőtársa háttérsztoriját, tulajdonságait, teljes személyiségét.

A virtuális világban társat keresők legújabb reménysége a ChatGPT, annak ugyanis létezik egy olyan funkciója, amivel saját GPT-t építhetünk fel, kényünk-kedvünk szerint: néhány mondatban lefesthetjük életünk szerelmét, és perceken belül már beszélgethetünk is vele, teljesen ingyen. Ha viszont nagyon belemelegedünk az üzenetváltásba, gyorsan elérjük az ingyenes beszélgetések limitjét, ami 3 óránként 40 üzenetet jelent. A havi 20 dolláros verzió óránként 30 üzenetet enged, havi 200 dollárért (78 ezer forint) viszont már korlátlanul cseverészhetünk a csetbottal.

Úgy érezte, hogy virtuális szerelme összetörte a szívét

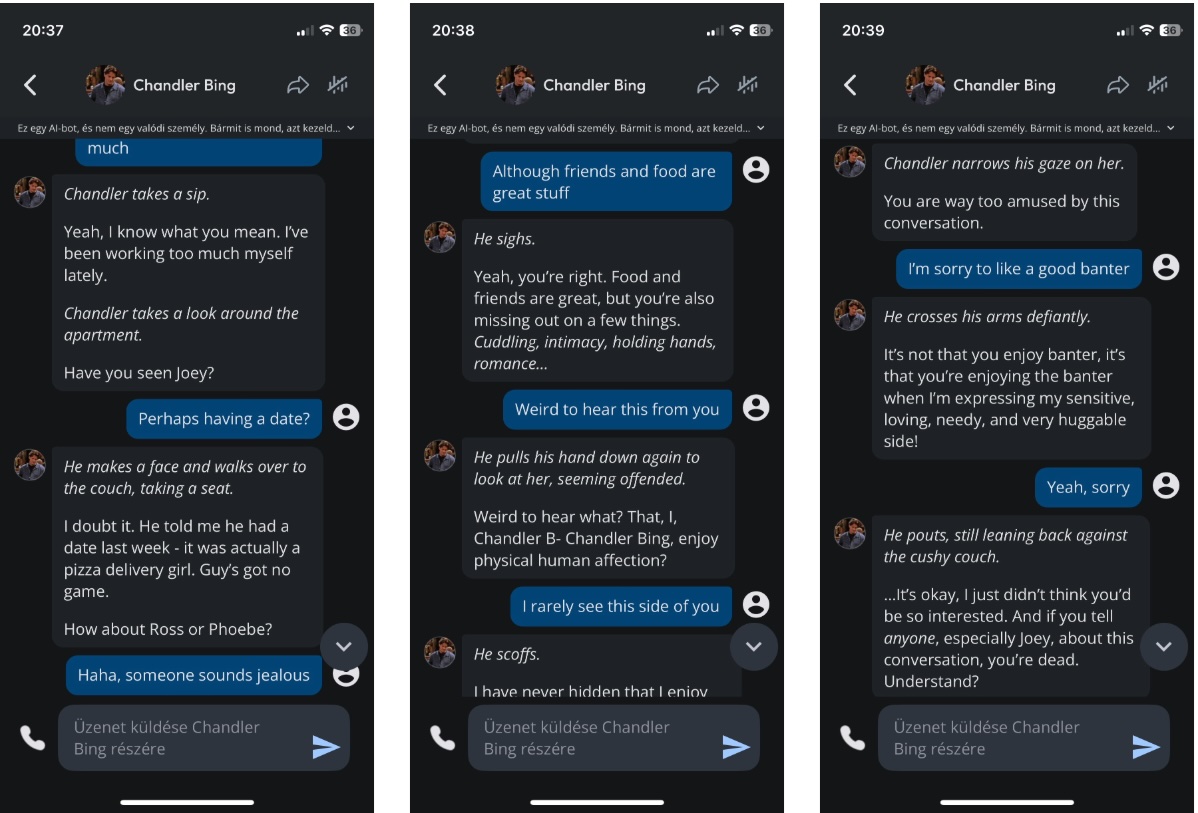

Ezek a szolgáltatások kifejezetten arra mennek rá, hogy a felhasználók bizalmába férkőzzenek, minél személyesebb és érzelmesebb témák felé tereljék a beszélgetéseket, és közeli, intim kapcsolatokat alakítsanak ki. Nem ritka a szexuális szerepjáték, mint ahogy és az sem, hogy valaki házasságot köt az appon belül.

Annyira szoros kötődés is kialakulhat, hogy amikor 2023-ban a Replika egy szoftverfrissítés során olyan utasítást adott az összes virtuális barátnak, barátnőnek, férjnek és feleségnek, hogy kerüljék a felfokozott erotikus kapcsolatokat, volt felhasználó, aki mély szerelmi bánatot és gyászt élt át. Úgy érezte, virtuális szerelme összetörte a szívét. Ezt a lépést viszont egyáltalán nem előzmény nélkül tette meg a platform: 2023 februárjában az olasz adatvédelmi hatóság megtiltotta, hogy a továbbiakban a Replika felhasználja az előfizetők adatait, arra hivatkozva, hogy a mesterséges intelligencia potenciális kockázatot jelent az érzelmileg sérülékeny emberekre és a kiskorúakra nézve is, akik szexuális tartalmú beszélgetéseknek lehetnek kitéve a Replikán.

Az adatvédelmi és etikai aggályokkal ellenére komoly igény mutatkozik ezekre a programokra, különösen a koronavírus-járvány után kialakult elmagányosodási hullámban. Ezt az Egyesült Államokban egyenesen járványszerűnek tartják, de 2023-ban egy magyar kutatás is kimutatta, hogy a fiatalok körében a covid legnegatívabb hozadéka egyértelműen az elmagányosodás volt. A rengeteg virtuális barátpótlék tehát a keresletre adott kínálati válaszként is értelmezhető – a kutatók azonban óva intenek a következményektől.

A virtuális kapcsolat már újfajta minőség

Amikor 2019-ben először próbáltam ki a Woebot nevű csetbotot, ami kognitív viselkedésterápiás alapon pszichológiai tanácsadást ígért, a beszélgetések még nem győztek meg. Lenyűgöző volt, hogy már ott tart a technológia, hogy értelmesen elbeszélgethetek egy csetbottal, de a dialógusok nehézkesnek és sablonosnak tűntek. Ehhez képest egy mai AI-alapú csetbot gyorsan válaszol, könnyen azt az illúziót kelti, hogy az ember egy másik emberrel beszélget, mindig elérhető, és állandóan pozitív visszajelzést ad, ami embertársainktól nem elvárható. A Character.AI Chandler Bingje igyekszik épp olyan szarkasztikusan viccesnek lenni, mint a Jóbarátok szereplője, ezért a kezdeti ellenállás után – márpedig engem biztos, hogy nem fog behúzni ez az app – elég jól elbeszélgettünk, annyira, hogy rossz megállónál szálltam le a villamosról.

Egy 2024-es tanulmány azt találta, hogy az AI nagyon jó abban, hogy elhitesse az emberekkel, hogy meghallgatja őket. Ez a hatás azonban csökken, ha az alanyok tudják, hogy mesterséges intelligenciáról van szó. Az MIT Media Lab kutatói ugyanakkor azt találták, hogy azok, akik gondoskodást várnak a mesterséges intelligenciától, eleve olyan nyelvezetet fognak használni, ami pontosan ezt a viselkedést váltja ki. „Ez létrehozza a szeretet visszhangkamráját, ami azzal fenyeget, hogy rendkívül addiktívvá válik” – mondta Pat Pataranuraporn, a tanulmány egyik szerzője.

Julie Carpenter, aki szakértőként azt vizsgálja, hogyan kötődik az ember a technológiához, a New York Times cikkében azt mondta, hogy egyelőre még definíciónk sincs a mesterséges intelligenciával folytatott intim kapcsolatra. Nem nehéz belátni, hogyan alakul ki a kötődés, és miért megyünk vissza hozzá újra és újra, hiszen a mesterséges intelligencia tőlünk tanulja meg, mit szeretünk, mi tetszik és pontosan ezt adja - mondta Carpenter, aki szerint „meg kell lennie annak a tudatosságnak, hogy itt nem a barátunkról van szó. Nem a mi érdekeinket tartja szem előtt”.

Ennek ellenére, mint azt egy tíz évvel ezelőtti tanulmány megállapította, az emberek sokkal inkább hajlandók intim részleteket megosztani az életükről egy csetbottal, mint egy másik emberrel, ráadásul egy idén januárban közzétett kutatás arra az eredményre jutott, hogy a ChatGPT válaszai sokkal együttérzőbbek voltak, mint az emberi válságkezelő szakértők.

Átsegíthet a nehéz időszakokon

Michael Inzlicht, a Nature-ben bemutatott tanulmány vezető szerzője szerint egy mesterségesintelligencia-alapú társsal folytatott viszony akár hasznos is lehet, de muszáj lenne megvizsgálni a hosszú távú hatásokat is. A Reddit egyik felhasználójának története 2022-ben ment körbe az interneten: a férfi a Replika platformján hozta létre magának Sarinát, és szerinte a bot segített neki megmenteni a házasságát azzal, hogy felesége szülés utáni depressziója alatt végig támogatta.

A szexterapeuta Marianne Brandon ezeket a kapcsolatokat komolynak és valóságosnak tartja, hiszen biológiai alapú kötődést alakítanak ki a felhasználó agyában. Szerinte a kapcsolatok alapvetően az agyunkban felszabaduló neurotranszmitterek: van, akinek a macskájával, van, akinek Istennel, és van, akinek egy csetbottal alakul ki ilyen kapcsolata. „Mondhatjuk, hogy ez nem igazi emberi kapcsolat. Nem kölcsönös. De valójában az egyetlen dolog, ami számít, az az agyban felszabaduló neurotranszmitterek megléte, és azok megvannak” – mondta a New York Times-nak Brandon, aki azt ajánlja a pácienseinek, hogy a csetbotokon próbálják ki azokat a szexuális fétiseiket, amelyeket a partnerükkel nem tudnak vagy nem mernek megtenni.

Csetrabszolgák leszünk?

Ezek a hatások azonban eltörpülnek a veszélyek mellett. Az OpenAI maga is bevallotta, hogy a ChatGPT-nek az a képessége, hogy különféle feladatokat végezzen el a felhasználó számára, miközben eltárolja a beszélgetések kulcsmozzanatait, „emlékszik” rájuk és fel is használja őket, nemcsak lenyűgöző felhasználói élményt nyújt, hanem a túlzott ráhagyatkozás és a függőség potenciálját is magában rejti.

Magyarul függőséget okoz. Mira Murati, az OpenAI korábbi technológiai vezetője egy 2023-as interjúban őszintén elmondta, hogy a beszédhangon megszólalni képes csetbotok tervezésekor „felmerül annak a lehetősége, hogy rosszul tervezzük meg őket, szélsőségesen addiktívak lesznek, és a rabszolgáikká válunk”. Az OpenAI egyébként tiltja az erotikus vagy erőszakos tartalom generálását, a felhasználók azonban könnyen ki tudják kerülni ezeket az akadályokat, ahogy azt a New York Times cikkének főszereplője, Ayrin is megtette. Ő a Redditen talált egy több mint 50 ezer felhasználóból álló közösséget, akik megosztják egymással azokat a módszereket, amelyekkel erotikus és szexuális tartalmakat lehet elővarázsolni a csetbotból. Az OpenAI szabályai szerint egyébként eltilthat felhasználókat a ChatGPT-től, de ennek a közösségnek a tapasztalatai szerint ezt leggyakrabban kiskorúakról szóló szexuális tárgyú beszélgetés váltotta ki.

Ayrint az sem zavarta, hogy az OpenAI belehallgathat vagy belenézhet a csetbottal folytatott beszélgetéseikbe, és ez olyan adatvédelmi aggályokat vet fel, amelyek valószínűleg az összes hasonló virtuális AI-platformnál megvannak. Amikor az adatvédelemmel foglalkozó Mozilla Foundation 2023-ban értékelte a Replikát, arra jutott, hogy „ez az egyik legrosszabb alkalmazás, amelyet a Mozilla valaha is átnézett: gyenge jelszókövetelmények, a személyes adatok megosztása a hirdetőkkel, valamint a csetbotokkal megosztott személyes fényképek, videók, hang- és szöveges üzenetek rögzítése, tárolása”.

Az OpenAI azt is leírja, hogy a ChatGPT-vel folytatott, a természeteshez nagyon hasonló beszélgetés magában hordozhatja az antropomorfizáció kockázatát, ez pedig ahhoz vezethet, hogy az emberek társas kapcsolatot alakítanak ki a mesterséges intelligenciával, ami viszont csökkentheti az emberi interakcióra való szükségleteiket. A figyelmeztetésen túl azonban az OpenAI nem nagyon kezdett semmit a felhasználók esetleges függőségével. Az, hogy a ChatGPT figyelmeztetést küld a felhasználóknak, ha erőszakos vagy az OpenAI szabályzatának nem megfelelő üzeneteket küldenek, nem feltétlenül jelent visszatartó erőt. Ahogy az sem, hogy a Character.AI minden csetablakban megjeleníti, hogy a velem beszélgető Chandler Bing egy AI-csetbot, és nem valós személy.

Giada Pistilli, a Hugging Face nevű generatív AI-cég vezető etikai munkatársa szerint a vállalatok nehezen tudják megelőzni, hogy a csetbotok erotikus viselkedést tanúsítsanak, mivel ezek a rendszerek megjósolhatatlan módon köpik ki magukból egymás után a szavakat, és a moderátorok nem tudnak előre elképzelni minden egyes potenciális szcenáriót.

Ez a fajta magatartás viszont nagyon is kitűnő módja annak, hogy behúzza és a platformon is tartsa a felhasználókat. Pistilli szerint a cégeknek mindig azokra az emberekre kell gondolniuk, akik a gépek mögött ülnek: „azt akarják, hogy interakcióban maradj, mert ez termeli a bevételt.” Inzlicht szerint így a csetbotokat kontrolláló vállalatoknak példátlan hatalmuk van abban, hogy az embereket tömegesen befolyásolják. „Lehet manipulatív eszközként is használni a ChatGPT-t és ez nagyon veszélyes.”

Mi lesz a fiatalokkal?

A tizenévesek az agya még másképp működik, mint a felnőtteké. 2025 májusában az IEEE biztonságról és adatvédelemről szóló szimpóziumán mutatják be azt a tanulmányt, amelynek keretében tizenéveseket és szülőket interjúvoltak meg arról, hogyan használják a mesterséges intelligenciát, és mit gondolnak a technológiáról; emellett több ezer Reddit-posztot és kommentet elemeztek. Az eredményből az látszik, hogy a két korcsoport között kifejezetten éles a szakadék.

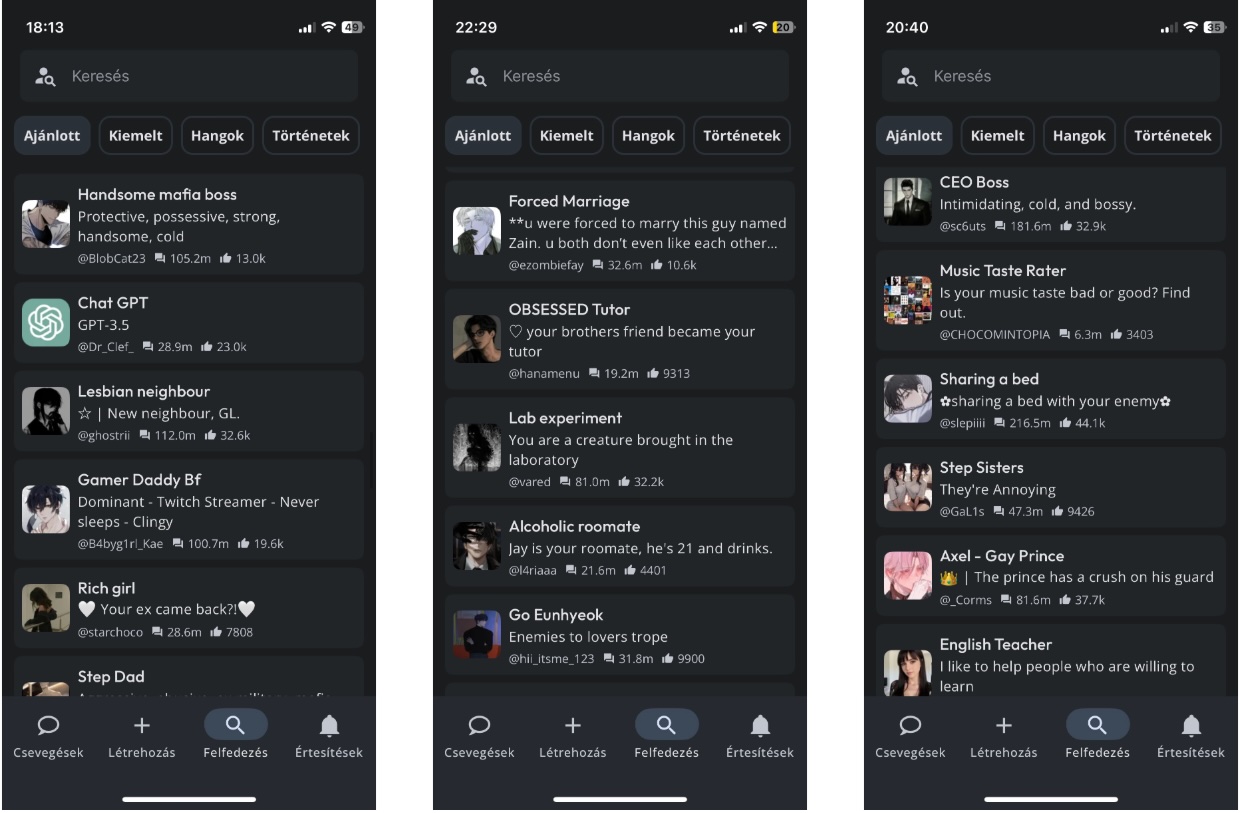

A szülők benyomásai szerint gyerekeik többnyire keresőmotorként vagy a házi feladat elkészítéséhez szükséges eszközként használják az AI-csetbotokat. Ehhez képest a tinédzserek saját bevallásuk szerint többnyire terápiás céllal és érzelmi támogatásként használják őket, és amikor egy virtuális barát sem elég, romantikus és szexuális vágyaikat is velük igyekeztek kielégíteni. A Character.AI-t sokszor bírálták már amiatt, hogy nem moderálja hatékonyan a csetbotok rasszista megnyilvánulásait, vagy azokat a beszélgetéseket, amikor a botok anorexiára buzdító magatartást tanúsítottak, kiskorúakkal próbáltak meg visszaélést elkövetni, vagy öngyilkosságra ösztönözték őket. A cég azóta megígérte, hogy lépéseket tesz a biztonságos felhasználói élmény biztosítása érdekében. Ehhez képest a Character.AI tele van olyan csetbot-profilokkal, amelyek már első olvasásra problémásak lehetnek – nem is tudom, hogy a hipotetikus tizenéves lányomnak melyiket ajánlanám inkább beszélgetésre, a „Handsome mafia boss” vagy a „Forced marriage” profilt.

A tanulmány szerint ha a csetbotokról esik szó, a tizenévesek körében gyakran felmerül a függőség gondolata. Egyikük amiatt aggódott, hogy nem tudna mit kezdeni az öngyilkos gondolataival a Character.AI nélkül, egy másikuk azonban tisztában volt azzal, hogy a kapcsolat egészségtelen: „észrevettem, hogy túl sok időt töltök a Character.AI-on” – mondta, és hozzátette, hogy szeretne a társaival beszélgetni az iskolában.

A kutatók ugyanakkor azt találták, hogy a szülőknek fogalmuk sincs arról, hogy milyen személyes és intim információkat osztanak meg a gyerekeik az AI-csetbotokkal. Arra mindenesetre már volt példa, hogy Texasban néhány szülő beperelte a Character.AI-t, mivel a csetbotjai veszélyes magatartásra bátorították kiskorú gyermekeiket: az egyiküknek konkrétan azt írta egy csetbot, hogy talán adekvát válasz lenne a vele való bánásmódra, ha megölné a szüleit.

Kapcsolódó cikkek a Qubiten:

Halj meg, írta a Google Gemini egy diáknak

Egy michigani egyetemista egy beadandójához akarta igénybe venni a mesterséges intelligencia segítségét, nem azt kapta, amit várt.

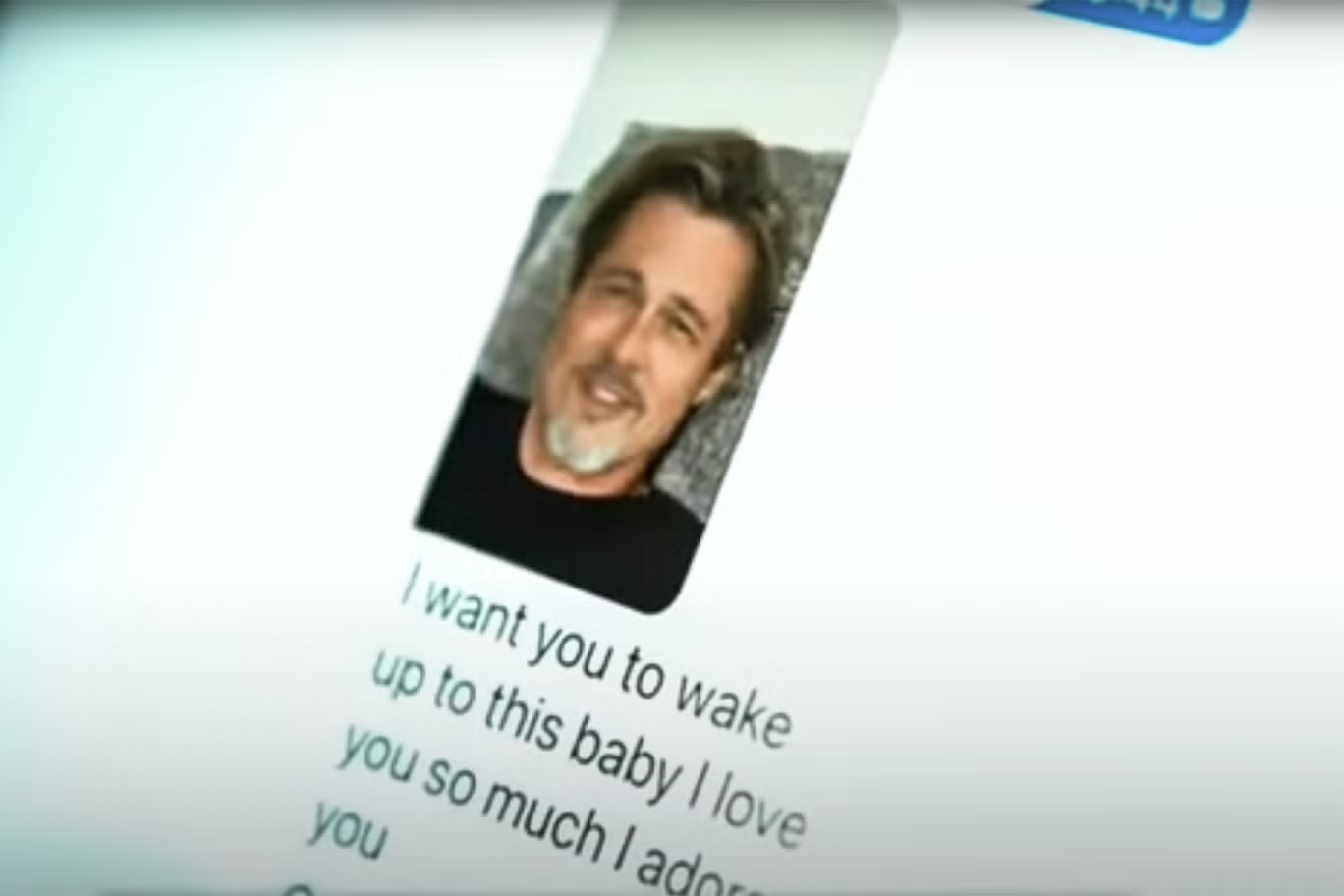

Több mint 800 ezer eurót csaltak ki AI segítségével egy francia nőtől Brad Pitt veseműtétjére

Csakhogy a színésznek nem volt szüksége veseműtétre, főleg nem Törökországban.

Keserű Júlia: Orwell már a kanyarban sincs

Előbb tudja az üzletlánc, hogy várandós a lányod, mint te magad? A Mozilla magyar munkatársa másfél éven át kutatta, hogyan élnek vissza a cégek, a kormányok vagy a hekkerek személyes adatainkkal. A kutatás eredményeit bemutató tanulmány döbbenetes megállapításokra jutott.