Agyi jeleivel irányított karokkal étkezett egy férfi, aki az összes végtagjára lebénult

Robert Chmielewski még húsz éves sem volt, amikor egy baleset következtében mind a négy végtagjára lebénult, így több mint harminc éve csak minimálisan érzi a kezeit és az ujjait, és csak nagyon korlátozottan tudja azokat mozgatni. 2020 novemberében azonban, ha nem is a sajátjaival, de újra két kézzel étkezett.

Cmielewski közel két éve esett át azon a tízórás műtéten, amely során hat elektródát ültettek az agya mindkét oldalába, és hónapokon belül már egyszerre tudta mozgatni a két mesterséges végtagot az agyi jeleinek továbbításával. Az ehhez használt agy-számítógép interfészt (mint amilyen az Elon Musk-féle Neuralink is lenne) a Johns Hopkins Egyetem alkalmazottfizika-kutatói fejlesztették ki.

A férfi egy olyan klinikai vizsgálat keretében próbálhatta ki a forradalmi eszközt, amelyet eredetileg az amerikai hadsereg technológiai újításaiért felelős ügynökség, a DARPA finanszírozott, és amelynek két célja volt: a művégtagok és más kisegítő eszközök irányítása és azok érintésének érzékelése az agyi jeleken keresztül.

A klinikai tesztet aztán az egyetem alkalmazott fizikusai és orvosi karának kutatói folytatták, egy olyan zártláncú rendszer létrehozását célozva, amely a mesterséges intelligencia, a robotika és az agy-számítógép interfészek technológiáit ötvözi. Ennek a rendszernek köszönhető, hogy Chmielewski pusztán gondolataival tudta egyszerre irányítani a két mesterséges kart, olyan finom mozdulatokat végrehajtva, mint az étel késsel-villával történő felvágása, majd szájhoz emelése.

„A végső célunk, hogy egyszerűbben elvégezhetővé tegyük az olyan dolgokat, mint az étkezés, a robotra bízva a munka egy részét, de közben a felhasználóra hagyva a részleteket: hogy mit egyen, hol szúrja bele a villát, vagy mekkora darabot vágjon belőle. Az agy-számítógép interfész jeleinek a robotikával és a mesterséges intelligenciával való egyesítésével elérhetjük, hogy az embernek csak a feladat legfontosabb részeire kelljen koncentrálnia” – mondta a Johns Hopkins közleményében David Handelman, az egyetem emberek és gépek együttműködését tanulmányozó robotkutatója.

A továbbiakban nemcsak a neurotechnológiai eszköz által elérhetővé váló mindennapi tevékenységek körét igyekeznek szélesíteni, de érzékelési visszacsatolást is próbálnak nyújtani az alanyoknak, hogy ne kelljen kizárólag a látásukra támaszkodniuk, hogy megbizonyosodhassanak a feladat sikeréről.

Kapcsolódó cikkek a Qubiten:

Lebénult emberek agyába ültettek egy eszközt, amelyen keresztül a gondolataikkal internetezhetnek

Ausztrál kutatók megvalósították, amiről Elon Musk még csak beszél: először kísérleteztek embereken a Senstrode nevű agy-számítógép interfész beültetésével, a páciensek pedig agyhullámaikon keresztül írtak emaileket és vásároltak az interneten.

Elon Musk péntek éjjel malacokon mutatta be eddigi legvadabb ötletét, a Neuralinket

A Neuralink koponyába fúrt készüléke több ezer elektródával befolyásolja az idegsejteket, így akár olyan, ma még gyógyíthatatlan betegségeket is lehetne kezelni okostelefonon keresztül, mint a bénulás vagy a vakság. Később mindenre emlékező, gondolatolvasó szuperembereket hoznának létre az agyba ültetett chippel.

A Facebook felvásárolt egy agyleolvasó startupot egymilliárd dollárért, mi baj lehet?

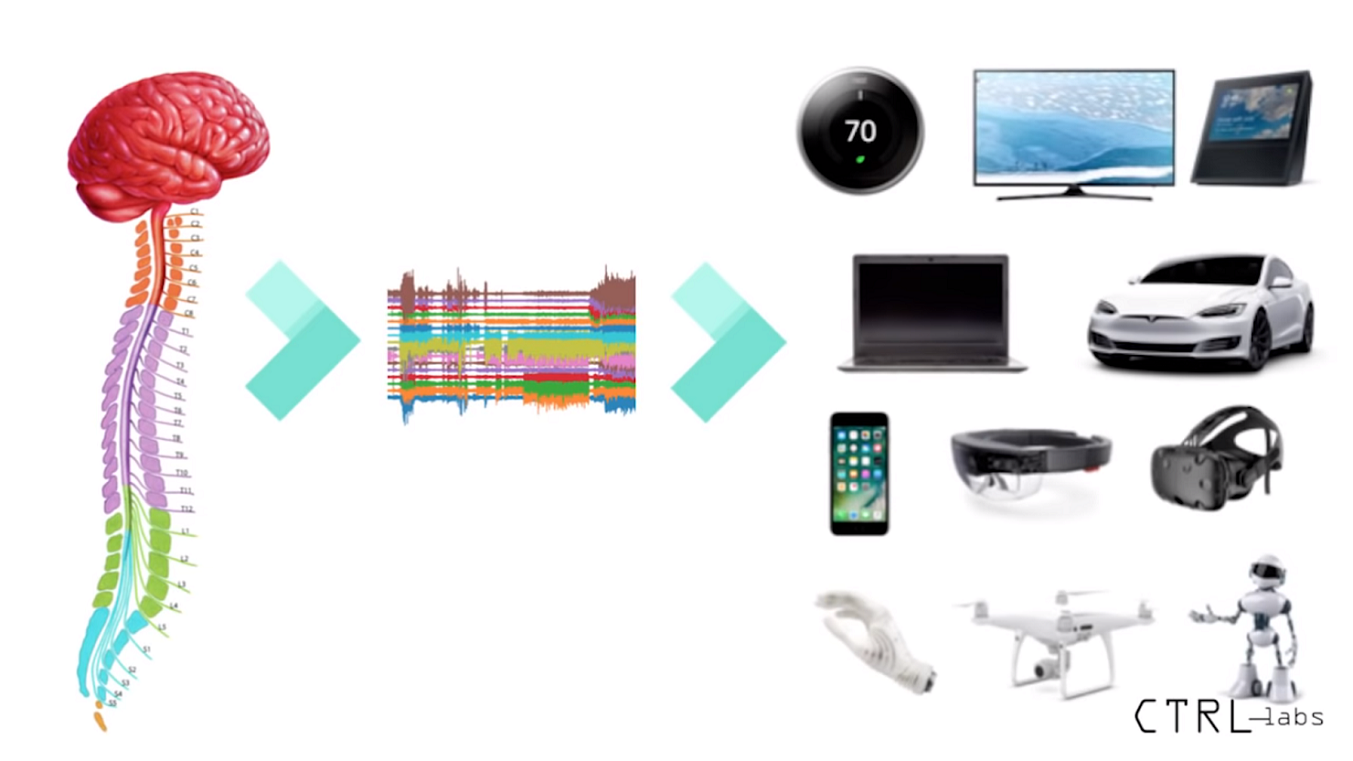

A CTRL-Labs olyan neurális interfészt fejleszt, amellyel az agy elektromos jeleit egy számítógépre lehet küldeni egy karkötőn keresztül. Ez a Facebook történetének harmadik legdrágább üzlete.