Megvilágosodik vajon a mesterséges intelligencia, ha megtanítjuk neki a buddhizmus alapelveit?

Az elme szó hallatán másra asszociál egy neurológus, és másra egy buddhista szerzetes. A neurológusok a mentális folyamatokat az agyban zajló folyamatok megfigyelésével próbálják megérteni. Ez tisztán biológia; nem foglalkozik olyan absztrakciókkal, mint a lélek, a megvilágosodás, a bölcsesség vagy az öntudat.

Noha az idegkutatók számtalan alkalommal és számos eszközzel vizsgálták az emberi agyban zajló folyamatokat, és egyre többet értenek meg ezek összefüggéseiből, még mindig nem tárták fel a neuronok és szinapszisok, vagyis az idegsejtek és kapcsolódási pontjaik akció-reakció viszonyrendszerét. Azt sem tudjuk, hogy a vizsgálható agyi folyamatok közül melyek felelnek a gondolkodásért, az öntudatért, az intuícióért és az intelligenciáért.

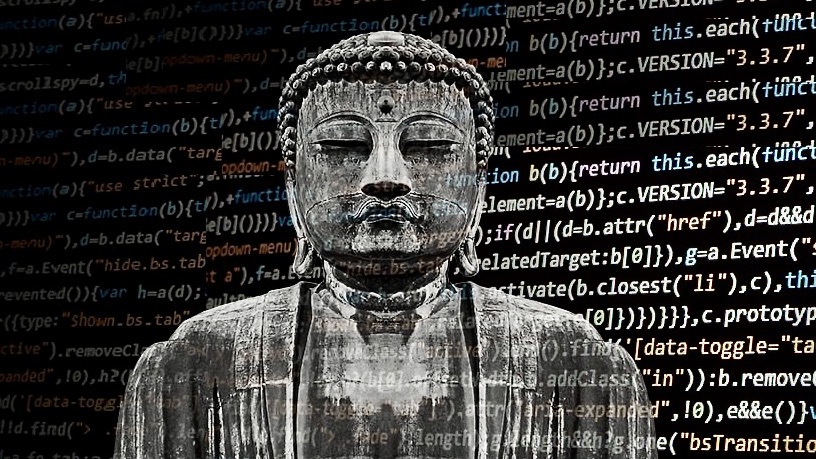

A 2500 éves múltra visszatekintő buddhizmus nem materialista szempontból vizsgálja az elmét. Bár nem tesz egyenlőségjelet az agy és az elme közé, szoros és kölcsönös összefüggést feltételez köztük. Ezt akár az AI-kutatásban is hasznosítani lehetne – legalábbis így látja Subodh Saxena mesterségesintelligencia-szakértő, aki szerint a mesterséges neurális hálózatok (artificial neural networks) és az agyban lezajló folyamatokat imitáló mélytanulás (deep learning) sokat meríthetne a buddhista tanításokból.

Nem Saxena az egyetlen, akinek eszébe jutott, hogy a buddhista filozófia tételei a mesterségesintelligencia-fejlesztésbe is átemelhetők. Egy korábbi cikkünkben megemlékeztünk Soraj Hongladarom, a bangkoki Chulalongkorn Egyetem filozófiaprofesszorának javaslatáról, ami szerint a mesterséges intelligenciákra vonatkozó etikai irányelvek megalkotásakor érdemes lenne figyelembe venni egyes buddhista elveket: például az együttérzést, az elszámoltathatóságot, a mások iránti elkötelezettséget és az önfejlesztést.

Hongladarom inkább az általános etikai irányelvek lefektetését tartotta fontosnak; mintha az Asimov-féle robotikai alaptörvényeket vagy a Tízparancsolatot alkalmazta volna mesterséges intelligenciára. Saxena célkitűzései ennél konkrétabbak: ő egy AI-részterület, a mesterséges neurális hálózatok optimalizálásában hasznosítana egyes buddhista tanokat. (Megjegyzés: a Mediumon közölt esszéjében Saxena szinonimaként használja a mélytanulást és a mesterséges neurális hálózatot, holott a kettő nem ugyanaz. Nem minden neurális hálózat mély, és nem minden mélytanulási architektúra alkot neurális hálózatot.)

Bináris és neurális

A mélytanulást az 1940-es évek óta ismerik a számítástudományban, de a szakértők csak az elmúlt öt-tíz évben kezdtek komolyabban foglalkozni vele. Ekkoriban terjedtek el az intuitív tapasztalatalapú kognitív AI-k, amik új matematikai modellekkel bővítették ki a hagyományos kognitív mesterséges intelligenciákat.

A mélytanulásra épülő AI-k látszólag jóval intelligensebbek lehetnek az embernél: legyőzhetik a világ legjobb játékosait táblás társasjátékokban és számítógépes stratégiai játékokban; természetes nyelvfeldolgozási feladatokat láthatnak el; de akár önvezető autók tájékozódási rendszereihez is felhasználhatják őket.

Az algoritmusok hatékonyságát kevesen kérdőjelezik meg, de a feketedoboz-természetük, vagyis a működésük átláthatatlansága kissé ijesztővé teszi őket. Az elképesztő mennyiségű adattal dolgozó algoritmusok adatfeldolgozási logikáját néha még az őket megalkotó fejlesztők sem értik teljesen; és ha a döntéshozatal ködössége nem lenne elég visszatartó erő, ezek a rendszerek hatalmas számítási kapacitást igényelnek.

A neurális hálózatok az emlősök agyműködését próbálják imitálni. A mesterséges idegsejtek, azaz a perceptronok a biológiai szervezetek idegsejtjeinek egyszerűsített, homogén, digitális változatai. Az imitáció érthető okokból nem százszázalékos; ugyan hogy is lehetne teljes értékű az agyműködés szimulációja, amíg nem értjük pontosan a modellezni kívánt folyamatokat? Az emberi agyban nagyjából százmilliárd idegsejt és nagyjából ezerbillió szinapszis található; a neurális hálózatok jóval kevesebbel dolgoznak. Az emberi agynak a szerkezeti felépítése is más; az idegsejtek mérete és alakja is különbözik; más az aktivitási mintázatuk; és az egyes (agy)területek szelektív használata is más-más képet mutat.

A meditáció: optimalizálás

A neurális hálózat perceptronjai három rétegbe rendezőnek: bemeneti (input), rejtett (hidden) és kimeneti (output) rétegekbe. A tanulás folyamata így zajlik:

- A bemeneti adatokhoz súlyozásokat (weight) és előfeltételeket (bias) társítanak, amikor elérik a szomszédos réteg egyik idegsejtjét, és a bemeneti aktivációs függvény eljuttatja őket a következő réteg idegsejtjeihez.

- Ha a mesterséges idegsejtek triggerei elérik a kimeneti réteget, végbemegy az optimalizálás, működésbe lép az úgynevezett backpropagation algoritmus, majd összevetésre kerül a kapott és a várt kimenet.

- A kétféle kimenet különbsége visszakerül a bemeneti rétegbe, ahol addig ismétlődik a súlyozás és az előfeltétel-kezelés folyamata, amíg meg nem kapjuk a kívánt kimenetet.

- A súlyozás és előfeltétel-kezelés optimalizálása után javulni fog a mesterséges neurális hálózat kimeneti pontossága, ami a modell betanításához, validálásához és teszteléséhez használható.

De hogy jön ide a buddhizmus? Úgy – írja Saxena –, hogy a mélytanulás nagy vonalakban a buddhista meditációra emlékeztet. A bemenetek, az értékekhez társuló súlyok és előfeltételek, az optimalizálás folyamata és a kimenet nagyjából megfeleltethetők a buddhizmus egyes alapfogalmainak.

A buddhista bölcsességet (prajna) három eszközzel érhetjük el: hallással (szútra), szemlélődéssel (cinta) és meditációval (bhávaná). Az intellektuális megértéshez a szútrák meghallgatásán, vizsgálatán és tanulmányozásán keresztül vezet az út; a megszerzett ismeretek integrációját pedig a szemlélődés és a reflexió segítik, és a meditáció mélyíti el.

A tanultak rögzülését segítő irányított meditáció (szamatha) és a valóság valódi természetébe történő bepillantás (vipasszaná) nem kifelé, inkább befelé forduló kognitív folyamat. A mélytanulás folyamata Saxena szerint nagy vonalakban emlékeztet a buddhista gyakorlatokra: a hallásra és a szemlélődésre, valamint az irányított és a vipasszaná meditációra.

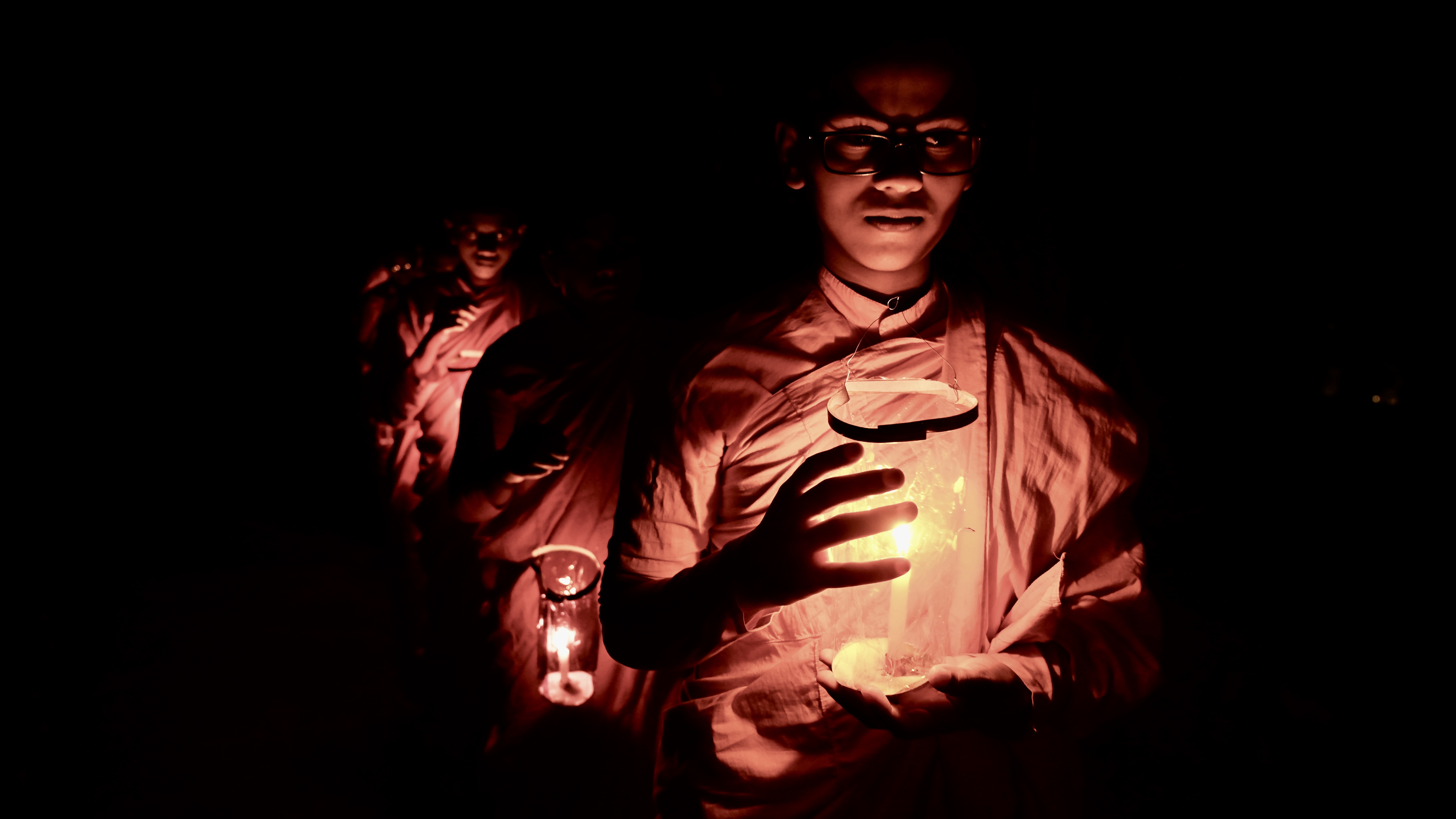

Amikor idegkutatók vizsgálták az évtizedek óta meditáló buddhista szerzetesek agyát, megfigyelték, hogy a figyelemért és az érzékszervi ingerek feldolgozásáért felelős agyi régiókban az átlagosnál jóval sűrűbben burjánzottak az idegsejtek és szinapszisok. (A mesterségesintelligencia-tervezés hálózati topológiájára lefordítva ez úgy hangzik – írja Saxena –, hogy a külső rétegek prioritást élveznek a rejtett rétegekkel szemben.)

Saxena szerint a mélytanulási algoritmusok és a neurális hálózatok feketedoboz-jellege, az absztrakciós készség hiánya és a modellek nehézkes tervezhetősége részben arra vezethető vissza, hogy a modern mélytanulási modellek általában nagy adattömegekkel és komplex számításokkal dolgoznak. A buddhista tanok integrációja ezt optimalizálná: az algoritmusok kisebb adatállománnyal dolgozva, kevesebb számítást végezve sem veszítenének a hatékonyságukból.

Saxena úgy véli, hogy az emberi tapasztalatok, az intuíció és a mélytanulási algoritmusok egyesítésével létrejövő modell olyan problémákat is kezelhetne, mint a gyógyíthatatlan betegségek vagy a klímaváltozás. (Hogy ez mennyire megalapozott, azt nehéz megjósolni, de az optimalizálásra vonatkozó meglátásai egybevágnak Hans Moravec, a híres AI-kutató meglátásával, akiről a Moravec-paradoxont is elnevezték; eszerint a magas szintű érvelés viszonylag kevés számítást igényel, míg az alacsony szintű szenzomotoros készségek imitálásához rengeteg erőforrásra van szükség. )

Valós időben elhibázott megvilágosodás

Adja magát a kérdés: ha a mesterséges intelligencia megértené a buddhista alapelveket, vajon elérhetné-e a megvilágosodást is?

Egy mesterségesintelligencia-kutató alighanem mosolyog a kérdésen. Ő tudja, hogy az AI-kutatásban külön kategóriaként kezelik a hard és soft mesterséges intelligenciákat; az előbbi az önálló gondolkodásra képes gépi intelligenciát takarja, az utóbbi meg a válaszalapú (response-based), nem önállóan gondolkodó technológiát. Könnyű megkülönböztetni őket, mert valódi hard AI még nem létezik – de ha létezne, akkor sem érhetné el a megvilágosodás állapotát.

Noha a buddhizmus egyes iskolái nem zárkóznak el az öntudatra ébredő gépek gondolatától – a dalai láma szerint az is elképzelhető, hogy egy napon AI-ként reinkarnálódunk –, valószínű, hogy a mesterséges intelligencia sosem világosodhatna meg. Ezek ugyanis, ahogy a nevükből is kitűnik, intelligens rendszerek, és az intelligencia nem azonos a tudatossággal. Az intelligencia koncepciókat alkot; nem egészként kezeli a valóságot, hanem a részeit modellezi.

Ha emberként szembesülünk egy problémával, az intelligenciánk hozza létre a problémamegoldáshoz szükséges modellt, ami kisebb részproblémákra bontja a nagy problémát. Ehhez hasonló eljárásokat a mesterségesintelligencia-kutatásban is gyakran alkalmaznak – de a buddhizmus szerint épp ez a mechanizmus a valóság megismerésének fő akadálya. A megvilágosodásra akkor kerül sor, ha feladjuk a modellek és koncepciók megalkotását célzó törekvéseket, és rádöbbenünk, hogy

- az univerzum egy megbonthatatlan egységet alkot;

- semmi nem tart elég sokáig ahhoz, hogy beilleszthető legyen egy modellbe.

Ez megérdemel némi magyarázatot; kezdjük az első ponttal. A buddhizmus egyik alapelve, hogy minden mindennel összefügg; ha megbontjuk a valóságot, az elkerülhetetlenül rossz eredményhez fog vezetni. A buddhista meditációval elérhető tudatállapot (többek között) épp az intelligenciát zabolázza meg, hogy a kategorizálás és modellezés ne legyen a megismerés gátja. A környezeti valóság észlelhető; leírni, reprezentálni viszont nem lehet.

A második pont a buddhizmus egy másik fontos tételét érinti, amit az ókori görög filozófus, Epheszoszi Hérakleitosz (Buddha kortársa!) is vallott: az állandó változás elvét. Eszerint minden folyamatos mozgásban van, és az egyik pillanat sosem lehet olyan, mint az utána következő. Mindebből az következik, hogy a valóságra nem vonatkozhatnak örökké érvényes szabályok. Az intelligens rendszerek viszont szabályokkal dolgoznak: amint működésbe lépnek, elvesztik a kapcsolatukat a valósággal, és egy önkényesen kiválasztott keresztmetszetével fognak dolgozni.

A ma használt mesterséges intelligenciák képesek a tanulásra és a változás integrálására; a legfejlettebb algoritmusok folyamatosan frissülő, gyakran valós idejű adatokkal dolgoznak. De ez nem viszi közelebb őket a megvilágosodáshoz, mert az új tudással csak az érhető el, hogy a valóság más-más szeleteit fagyassza be. Hiába, hogy ez a metszet a legfrissebb irányelv alapján készül, ha csak egy része lesz az egésznek – és mint ilyen, szükségszerűen téves.

Gépi intelligencia van; gépi lélekjelenlét nincsen

De miért kéne beleerőltetni az absztrakt vallásfilozófiai koncepciókat a robotikába és az AI-fejlesztésbe? Jogos kérdés; a mesterségesintelligencia-kutatókat is joggal foglalkoztatja. Számukra ugyanis mindennapos gyakorlati probléma, hogy miként lehetne kiküszöbölni az adatkészlet vagy az algoritmusok torzításait (bias), márpedig a megvilágosodás is egy torzításmentes tudatállapot elérését jelenti.

A fentiekből azonban az következik, hogy a torzításmentes rendszer nem lehet intelligens. A megvilágosodott személy cselekedeteit nem köti gúzsba az akarat és az egó. Nem a tudatos gondolkodás vezérli, hanem az, amit magyarul lélekjelenlétnek hívunk. A megvilágosodott nem törődik a tettei következményeivel, sem azzal, hogy adottak-e a cselekvés előfeltételei: csak cselekszik, ösztönösen, és mégis helyesen.

Mindez azonban nemcsak az AI-kutatás elveit és irányzatait köpi szembe, hanem azt is, amit az észszerű viselkedésről gondolunk. A mesterséges (és emberi) intelligencia általában az alábbi logikai láncolatot követi: megfigyelés, tanulás, osztályozás, konklúziók levonása, tervezés – és csak ezután jöhet a terv végrehajtása. De ez, miként azt tisztáztuk, nem a megvilágosodás útja.

Úgy tűnhet, hogy ez inkább spirituális, mint gyakorlati kérdés, de ez nem teljesen igaz. A buddhista filozófia ezen a ponton erős hasonlóságot mutat Kurt Gödel logikai rendszerekre vonatkozó elméletével, amely szerint az axiómákra épülő rendszerek mindig tökéletlenek: lehet, hogy bizonyos elvek és tételek egy adott rendszerben érvényesülnek, de soha nem bizonyítható, hogy ezek helyesek-e. Ezen az axiómáik megváltoztatása sem segít. Épp az okozza a problémát, hogy a logikai rendszerek természetüknél fogva képtelenek a teljes igazság megragadására: a matematikus Roger Penrose is ezzel érvelt, amikor elvetette egy öntudattal bíró mesterséges elme létrehozásának elvi lehetőségét.

Már csak egy (merőben hipotetikus) kérdés maradt: van-e értelme vallásfilozófiai elméleteket beemelni az AI-fejlesztésekbe, ha ezekkel sosem érhető el az adott vallás végső célja, azaz a megvilágosodás?

Ha így tesszük föl a kérdést, akkor nincsen. Idővel alighanem közelebb jutunk majd egy, az emberi tudatosságot hitelesen imitáló gépi intelligencia megalkotásához, ami sosem fog megvilágosodni. De ahogy arra Saxena esszéje is rávilágít, egyes vallási elvek igenis felhasználhatók az AI-kutatás gyakorlati problémáinak megoldásához. Ha az alkalmazott megoldás működik, nem számít, hogy ezek az elvek eredetileg más célt szolgáltak: paradox módon épp a buddhizmus hirdeti azt, hogy nem a cél elérése a fontos, hanem az, hogy sose hagyjunk fel az elérésére irányuló törekvésekkel.

Kapcsolódó cikkek a Qubiten:

Mit tanulhat Buddhától a mesterséges intelligencia?

Az AI etikai kérdéseivel foglalkozó szakértőknek remek ihletforrások lehetnek az olyan buddhista tanítások, mint az együttérzés, az önfejlesztés, az elszámoltathatóság, vagy a szenvedés megszüntetésére irányuló törekvések.

Az addig rendben van, hogy az ige testté lett, de mihez kezd a vallás a testtel?

A stigmatizáció, a vallás és a test volt a központi témája a CEU Határtalan tudás rendezvénysorozata utolsó idei előadásának, ahol kiderült, hogy a kereszténység több stigmatizált nőt tart számon, mint férfit, és hogy a test, bármekkora nyűgnek is tűnhet számos vallás számára, azért mégis jó valamire – például van minek feltámadnia.

Robotpappal terelnék Buddha útjára a fiatalokat Japánban

A buddhista papok már egyenesen a vallás jövőjét látják a mesterséges intelligenciában, de a nyugati látogatók szentségtörésről beszélnek, és Frankenstein szörnyéhez hasonlítják a robotpapot.