Kitalálja, mi jár a fejedben a forradalmi mesterséges intelligencia, a GPT-3

A mesterséges intelligencia (AI) hosszú évekig, évtizedekig csak elvont fogalomként élhetett az emberek fejében. Legfeljebb olyan emlékképek keringtek a kollektív tudatalattiban, hogy volt az a sakkbajnok gép, meg a Watson is megvert mindenkit egy tévés vetélkedőben. Aztán a 2010-es években, szinte észrevétlenül a mindennapi élet részévé vált, és mára a gigantikus adathalmazra épülő algoritmusok határozzák meg az internetes kereséseinket, a vásárlást, az ismerkedést, a hírfogyasztást, az üzleti életet.

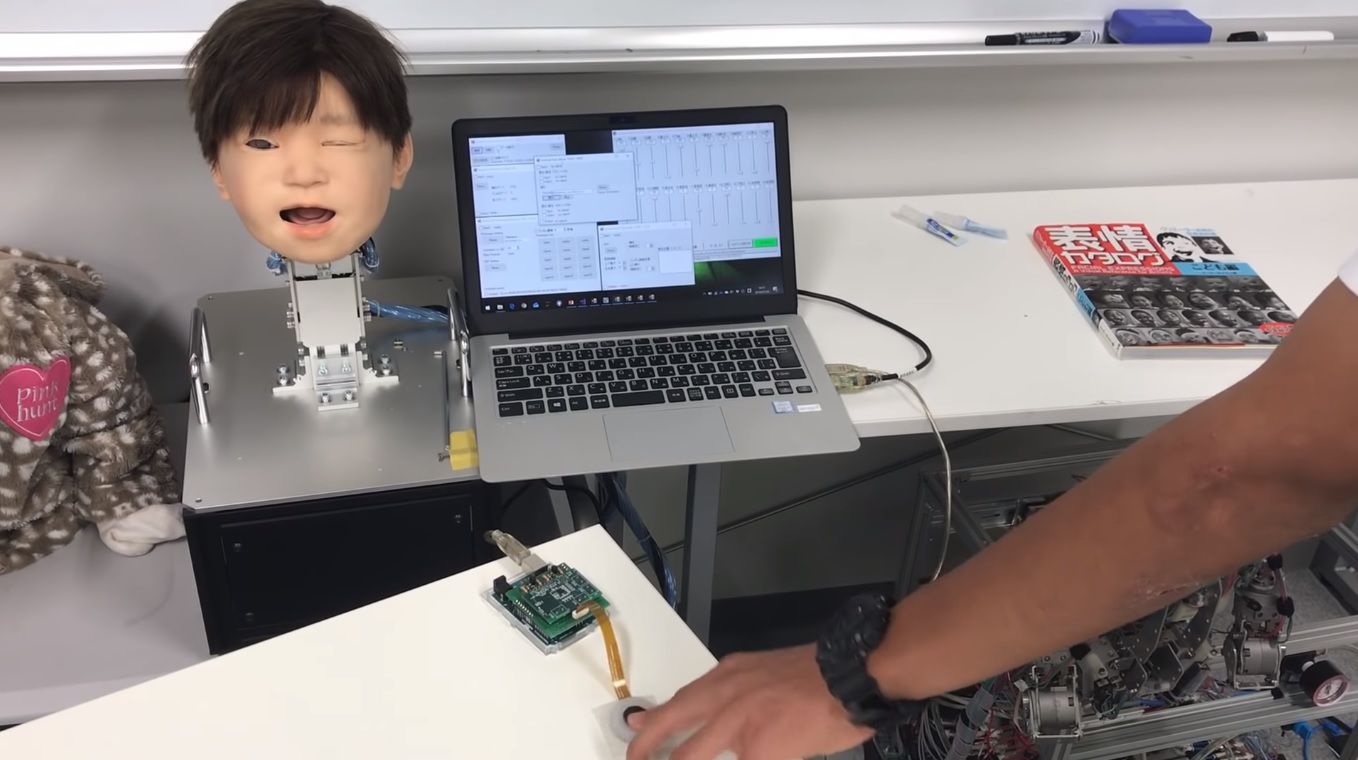

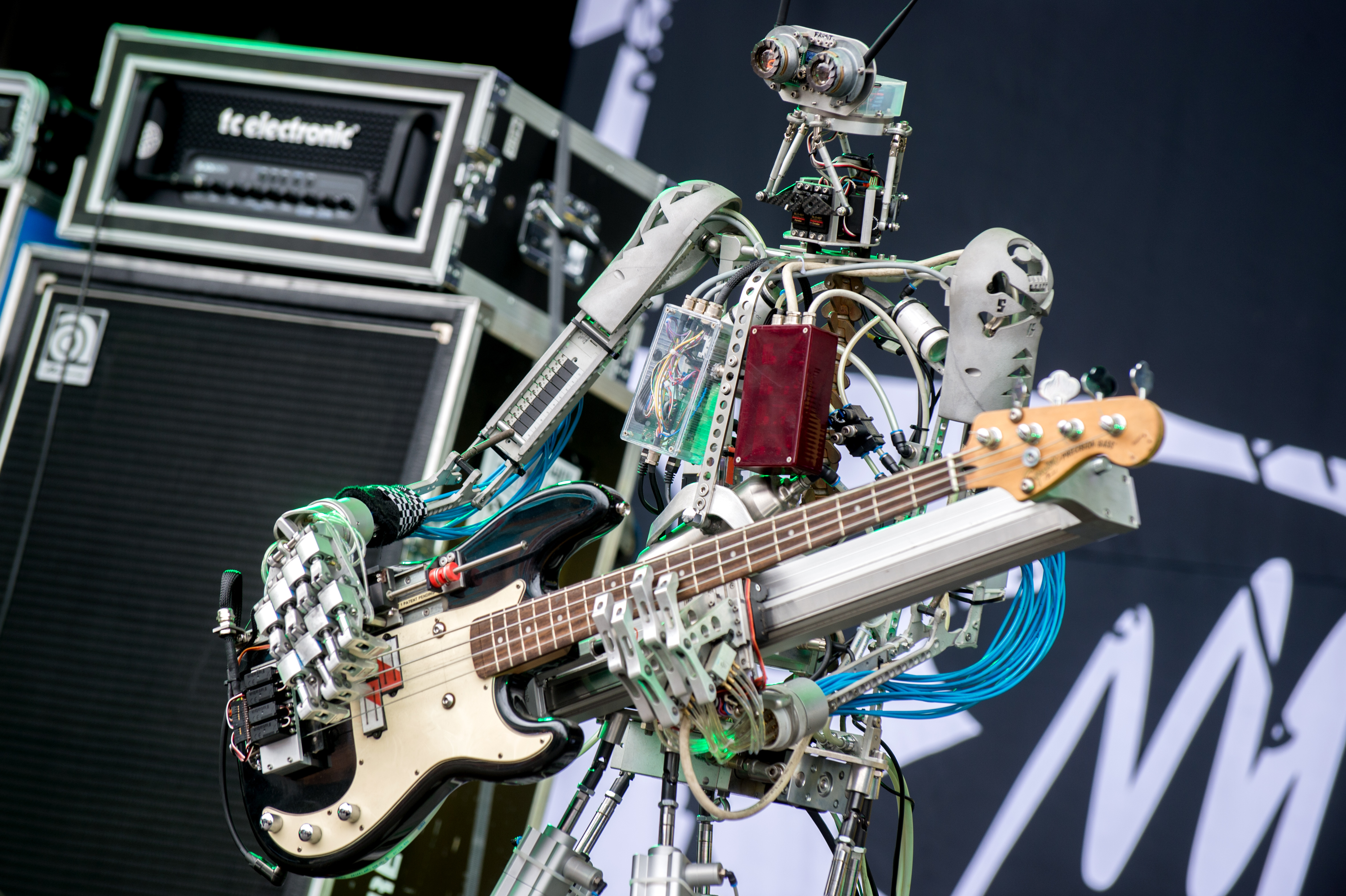

Az elmúlt néhány évben viszont már sorra követik egymást az olyan projektek, amelyek egyre látványosabban mutatják meg a rohamosan fejlődő mesterséges intelligencia elképesztő képességeit. A virtuális asszisztensek (Google, Alexa, Siri) és a chatbotok terjedésén túl lehetővé vált a fotók és videók minőségének javítása; az AI létező zenészek stílusában ír nem létező dalokat; vagy épp kutatók tanítanak arra egy robotfiút, hogy érezze a fájdalmat.

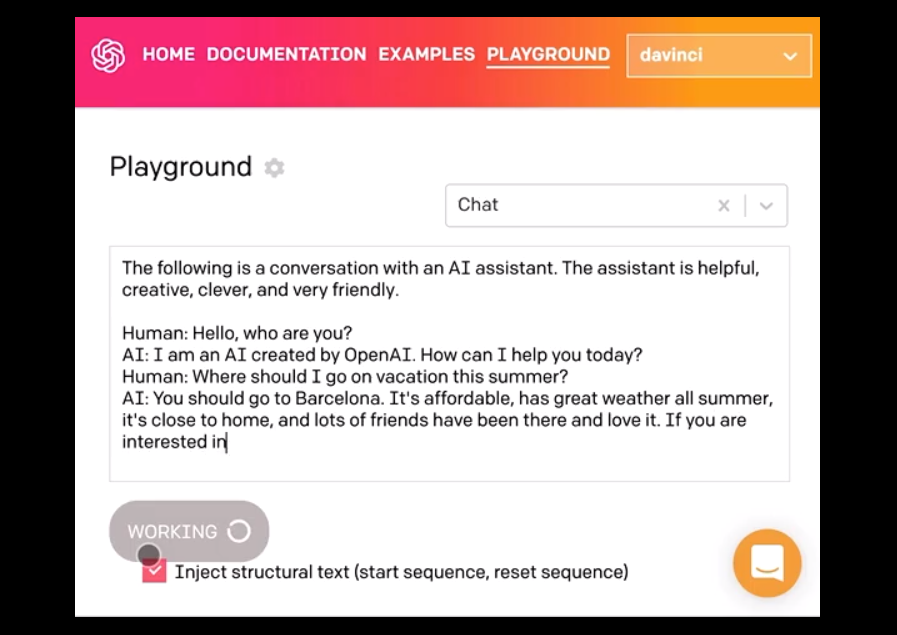

A nevéből is fakadóan a nyilvános AI-kutatások élén járó OpenAI, amit többek között Elon Musk alapított 2015 végén, most először tett elérhetővé olyan eszközt, amellyel a fejlesztők egyszerűen ki tudják aknázni a legújabb AI-modellekben rejlő lehetőségeket. Az egyszerűen csak OpenAI API-nak (API = alkalmazásprogramozási felület) nevezett eszközbe már a vadonatúj GPT-3 generatív nyelvi modellt is beépítették, ami így leírva csak a szokásos informatikai halandzsának tűnik, pedig a hozzáértők a digitális világ új korszakának kezdetét látják benne.

Hogy ez a korszak jó lesz-e nekünk, vagy sem, az azon múlik, hogy mire használják a szövegalkotásban, értelemben és kommunikációban hihetetlenül fejlett AI-t, illetve hogy sikerül-e majd elhárítani potenciálisan veszélyes felhasználását. Merthogy azt még az OpenAI is elismeri, hogy egy ekkora áttörésnek megvannak a veszélyei. Amikor 2019 februárjában bemutatták a GPT-2-t, a cég története során először úgy döntött, nem teszi nyilvánossá a modellt leíró kutatást, mert még nekik is ki kell tapasztalni, hogy mire lehet képes.

A Guardiannek akkor azt nyilatkozták, hogy a rendszer képes pillanatok alatt álhíreket írni, végtelen számú (pozitív vagy negatív) szöveges értékelést írni bármilyen termékről vagy spamek millióit gyártani, mintha az emailfiókok nem lennének már így is tele szeméttel. A legnagyobb probléma viszont a nagy adathalmazok intelligens feldolgozására épülő AI természetében van elrejtve.

Az AI által alkotott szövegek az interneten található írások millióin alapulnak (attól függ, milyen forrásokat „etetnek meg” a gépi tanulást végző rendszerrel), így az algoritmus végeredményben az interneten írásban megnyilvánulók szavait adja vissza, még ha okosan, eredeti módon kombinálja is azokat. Az internetre író emberek szavai pedig, valljuk be, nem mindig mentesek különböző veszélyes gondolatoktól – gyűlöletbeszédtől, összeesküvés-elméletektől, elferdített tényektől.

„Úgy érzem magam, mint aki látta a jövőt”

Az egyelőre csak a várólistáról kiválasztottaknak elérhető, de a cég ígéretei szerint decembertől nyilvános OpenAI API elsősorban olyan célokat igyekszik szolgálni, mint az adatbevitel vagy a programozás egyszerűbbé tétele. Ha például egy táblázatba beírsz nyolc cégnevet, majd közülük kettő alapítási évét és részvényárfolyamát, a rendszer kiegészíti a listát a hiányzó adatokkal. Egy szerencsés korai tesztelő pedig olyan alkalmazást fejlesztett a GPT-3 alapjaira, amely egymondatos utasításra generál kattintható dinnye alakú gombot, vagy hozza létre a legrondább emojit – persze a hozzá tartozó HTML-kóddal együtt.

Már a GPT-2-t is úgy harangozták be, mint ami 5-6-szor erősebb az elődjénél, de a GPT-3 esetében léptéket váltottak: 1,5 milliárd paraméter helyett 175 milliárddal dolgozik. Mivel a betáplált szöveges adatok elemzése során az AI nyelvi összefüggéseket keres, és ebből építi fel a tudását, az adathalmaz mérete rengeteget számít.

Egy San Franciscó-i startupper, Arram Sabeti szerint a GPT-3 minden korábbi rendszernél értelmesebb, koherensebb szövegeket alkot: „Egy rövid leírás alapján úgy egészíti ki a szöveget, ahogy az szerinte a legértelmesebben folytatódna. Írattam már vele dalszöveget, novellát, sajtóközleményt, gitártabot, interjút, esszét és használati útmutatót is. Őrülten vicces és félelmetes. Úgy érzem magam, mint aki látta a jövőt – az általános mesterséges intelligencia már nem lehet olyan messze.”

Sabeti egy blogposztban mutatta be az eredményeket. Van köztük Harry Potter-krimijelenet Raymond Chandler stílusában; Kanye West amerikai elnöki programjának bemutatása egy CNN-interjú formájában; használati útmutató a fluxuskondenzátorhoz; vagy Taylor Swift új, Harry Potter című slágerének dalszövege. Utóbbiból muszáj idézni egy részletet: „I’d walk a thousand miles / To get to see you and / Harry, Harry, you’re so fine / My girly parts all tingle / When you smile that smirk / I’d love to be your girl”.

Szórakoztat és támogat

A magát AI-művésznek nevező Mario Klingemann „az internet elsőszülöttjének” nevezte a GPT-3-at, a hozzá hasonló bétatesztereket pedig az azt felnevelgető mozaikcsaládnak. Klingemann elsősorban történetek és párbeszédek írására, filozófiai fejtegetésekre vette rá az eszközt, és Twitter-oldalán mutatta be az eredményeket. Például azt novellát, amelyet Jerome K. Jerome stílusában íratott a mesterséges intelligenciával a Twitteren való jelenlét fontosságáról – a GPT-3 csak a megadott címből és szerzőből, valamint egyetlen kezdőszóból dolgozott.

Egy másik tesztelő, Joshua Schachter a rendszer kreativitását tesztelte. A rendszer hol üzleti ötletekkel állt elő, vagyis gyakorlatilag feltalálóként viselkedett („IKEA Fall Gadget – módosított ikeás szék, ami hurrikán esetén összeesik, ezzel megelőzve a komoly sérüléseket”), hol pedig mémkaraktereket gyártott a megadott, létező alakok (Scumbag Steve, Philosoraptor stb.) mintájára.

Az OpenAI biztonsági tesztelője, Nick Cammarata ennél eggyel mélyebbre ment: pszichiáterként használta a GPT-3-at, amellyel először csak hétköznapi dolgokról beszélgetett, de aztán kérésre azt is kipróbálta, hogy miként reagál a rendszer, ha egy önostorozó páciens bőrébe bújik. Mint kiderült, az AI-nak egész jó módszerei vannak a problémásabb ügyek kezelésére is.

A legtöbbet talán az argentin Manuel Araoz hozta ki a rendszerből. A fejlesztő képzelt interjút készített Albert Einsteinnel; felfedezte azt a funkciót, amely az agresszív emaileket átírja higgadtabb nyelvezetben, néhány véletlenszerű hozzávaló megadásával pedig részletes receptet íratott, és megszületett a hawaii palacsinta, banánnal és paradicsommal. Araoz a metamegoldások híve, ezért a GPT-3-at először a GPT-3 veszélyeiről és korlátairól kérdezte, majd úgy döntött, hogy a modellről szóló cikket is magával a GPT-3-mal íratja meg.

Korlátolt, veszélyes lehet, de nézzük meg, mire jó

Persze ennek a technológiának is megvannak a maga korlátai. Néha olyan alapvető nyelvtani hibákat ejt, amit egy professzionális író nem tenne, és egyelőre a hosszabb szövegek alkotásával is meggyűlik a baja, nem véletlenül csak novellákat írattak vele, és nem egyből több száz oldalas regényeket. „A GPT-3 mintái bizonyos hosszúságú szövegek esetében elvesztik a koherenciát, önellentmondásba kerülnek, és időnként a kontextusba nem illő mondatokat vagy bekezdéseket tartalmaznak” – írta a modell korlátairól az OpenAI.

Meglepő módon még a cég vezérigazgatója, a 35 éves Sam Altman is azt írta a Twitteren az első tesztelők beszámolói után, hogy „túl nagy a GPT-3 körüli felhajtás”.

Az OpenAI mindenesetre arra figyelmeztet, hogy a mesterséges intelligencia fejlődésének üteme mellett elkerülhetetlen, hogy időnként nem kívánt alkalmazási módokat találjanak neki. Ezt azonban csak a maguk háza táján tudják, legalábbis igyekeznek felügyelni: „Megszüntetjük az API-hozzáférését mindenkinek, aki azt nyilvánvalóan káros dolgokra használja, például zaklatásra, spamre, radikalizálásra vagy manipulálásra. De azt is tudjuk, hogy nem láthatjuk előre a technológia minden lehetséges következményét, ezért is adtuk először kiválasztott bétatesztelők kezébe az eszközt, mielőtt mindenki számára elérhetővé válna.”

Egyelőre nem érdemes túl messzire szaladni az elméletekkel, egy érdekes összefüggést azonban nem árt rögzíteni: az egymilliárd dolláros kezdőtőkével indult OpenAI, amely a nonprofit OpenAI Inc.-ből és a profitorientált OpenAI LP-ből áll, 2019-ben nagy befektetőre talált, a Microsoft ugyanis újabb egymilliárddal tolta meg az OpenAI LP-t. Ugyanez a Microsoft 2020 májusában kirúgott 27 újságírót az MSN nevű portáljától, hogy mesterséges intelligenciával helyettesítse a munkájukat.

Valóra vált CSI: homályos fotókból éles képeket varázsol a MyHeritage új appja

Az ingyenesen kipróbálható szolgáltatás az elmosódott, pixeles, fekete-fehér fotókat is hihetetlenül valószerű, színes képekké alakítja.

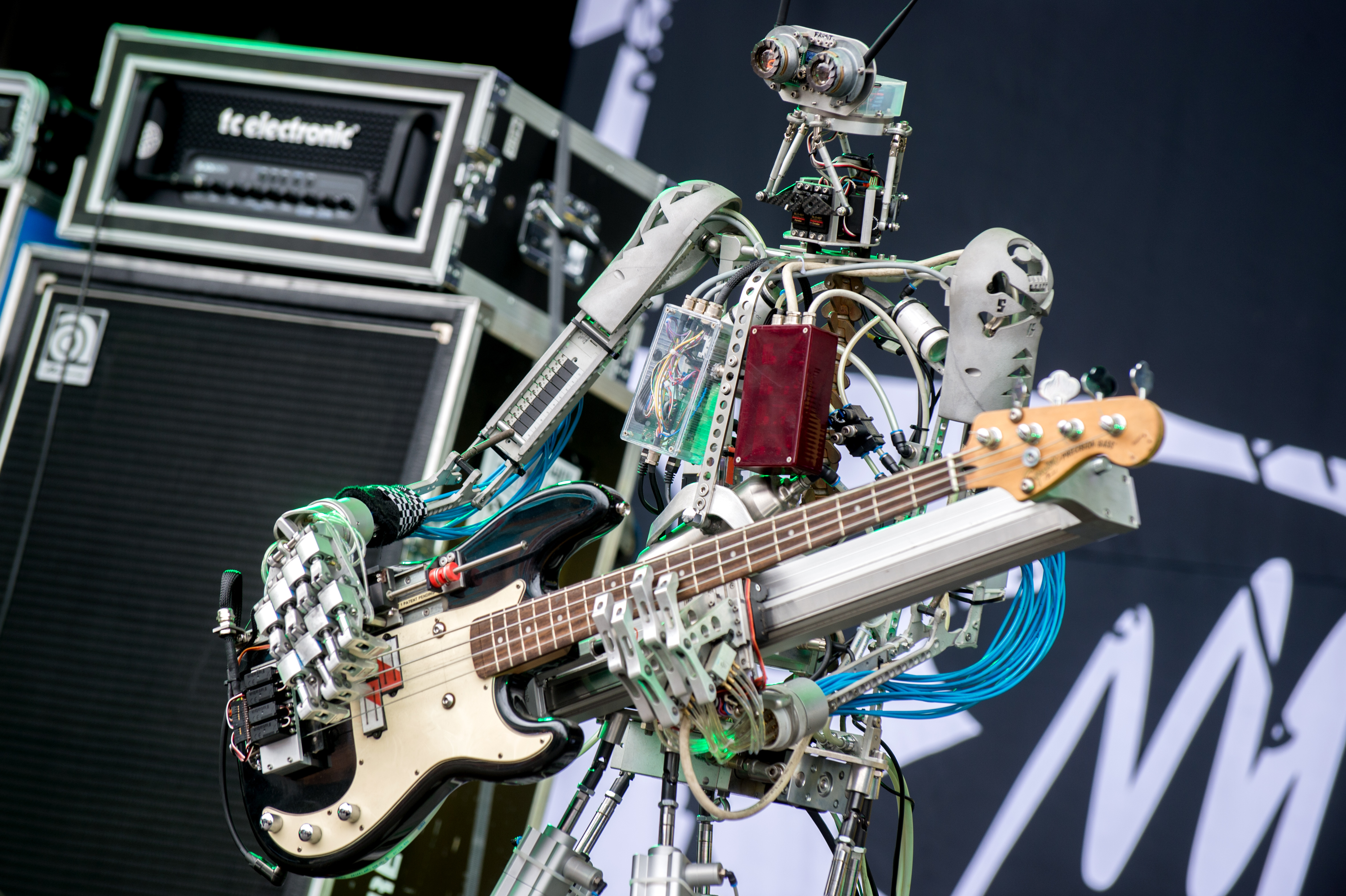

Hátborzongató dalokat írt az OpenAI mesterséges intelligenciája a legnagyobb sztárok stílusában

1,2 millió valódi dalt tápláltak egy gépi tanulási rendszerbe, amely darabjaira bontotta őket, és teljesen új számokat írt azokból. Kiderült, hogy Elvisnek jól áll a nonszensz, hogy Bon Jovi-dalt egy gép is tud írni, viszont popslágereket egyelőre ne várjunk a mesterséges intelligenciától.

Gépi tanulással 4K minőségű, színes videóvá alakítottak egy 1911-es New York-i felvételt

Az ősrégi, fekete-fehér felvételt neurális hálózatok javították fel élethű minőségre, egy új eszközzel pedig színessé is lehetett varázsolni a közel 110 éves videót.

Kapcsolódó cikkek