Mi az a technológiai szingularitás, és mikor jön már el?

Technológiai szingularitásnak nevezzük a tényleges mesterséges intelligencia (MI) esetleges megalkotása után létrejövő technikai fejlődésnek azt a véges időn belül bekövetkező szinguláris pontját, amikor az emberi intelligencia és technika a szingularitás előtti ésszel felfoghatatlan mértékben válna túlhaladottá.

Egy kis kitérő. Azért mondom, hogy tényleges MI (szoktás erős MI-nek is nevezni), mert manapság nagyon divatos MI-nek nevezni minden speciális feladatra kifejlesztett gépi tanuló rendszert, miközben a tényleges emberi szintű intelligencia ennél jóval több. Persze, bizonyos speciális feladatokban a gépi tanuló rendszerek teljesítménye bőven meg is haladhatja az emberekét, más esetekben viszont még egy baba képességeit sem tudják megközelíteni. A legnagyobb hiányosság azonban az, hogy egyelőre nem univerzálisak. Bár képesek tanulni, de csak egy bizonyos részterületen, bizonyos korlátok között és bizonyos szempontok alapján. Hogy a teljes univerzalitás mennyire csak a számítási kapacitás kérdése, az vita tárgya.

Mi lenne, ha a gépek kutatnának helyettünk?

Az említett feltételezett intelligenciarobbanás azon alapszik, hogy egy biológiai korlátoktól mentes emberi szintű MI, amely önmagát szabadon tudja fejleszteni, a visszacsatolás miatt véges idő alatt tudna magának lényegében akármilyen nagy számítási teljesítményt fejleszteni. Természetesen a fizikai korlátok határok maradnak, azonban a becslések azt mutatják, hogy a számítási kapacitásra vonatkozó elvi fizikai korlátok elképzelhetetlenül nagyobbak, mint amivel ma az emberek vagy akár az egész emberiség rendelkezik.

Gondoljuk végig, hogy mi történne akkor, ha a kutatást emberek helyett már az emberi gondolkodást teljes mértékben helyettesíteni képes intelligens gépek végeznék, amik egyúttal maguk is kutatások és fejlesztések tárgyai, azaz elviekben memóriájuk tovább bővíthető, algoritmusaik hatékonysága és sebessége növelhető, számuk sokszorozható, energiafelhasználásuk csökkenthető, és így tovább. Ha korábban az embereknek a technikai fejlődés által például kétévente sikerült a számítási teljesítményt megduplázniuk, akkor az őket helyettesítő gépeknek is ennyire lesz szükségük kezdetben. A második év után azonban a megnövelt számítási teljesítménnyel rendelkező gépeknek fele ennyi idő is elég lesz az újabb duplázáshoz, a rákövetkező gépgenerációnak pedig ennek a fele, és így tovább.

100 év alatt 20 000 évnyi fejlődés

Az ultraintelligens gépek tehát hamar maguk mögött hagynák az ember intelligenciáját, emiatt az ultraintelligens gép lenne az utolsó találmány, amit az embernek létre kéne hoznia. Így fogalmazott I. J. Good már 1965-ben. Raymond Kurzweil közismert jövőkutató, feltaláló és mesterségesintelligencia-kutató A spirituális gépek kora és A szingularitás küszöbén című könyvek szerzője a szingularitás elérését 2045-re jósolja. A dátum relatíve közelinek tűnik, de Kurzweil szerint ez a fejlődés érzékelésének lineáris ütemű illúziója miatt van, miközben a valóságos fejlődés exponenciális ütemű. Ennek megfelelően a 21. században nem 100 évnyi, hanem a jelenlegi ütemben mérve 20 000 évnyi fejlődést fogunk megtapasztalni.

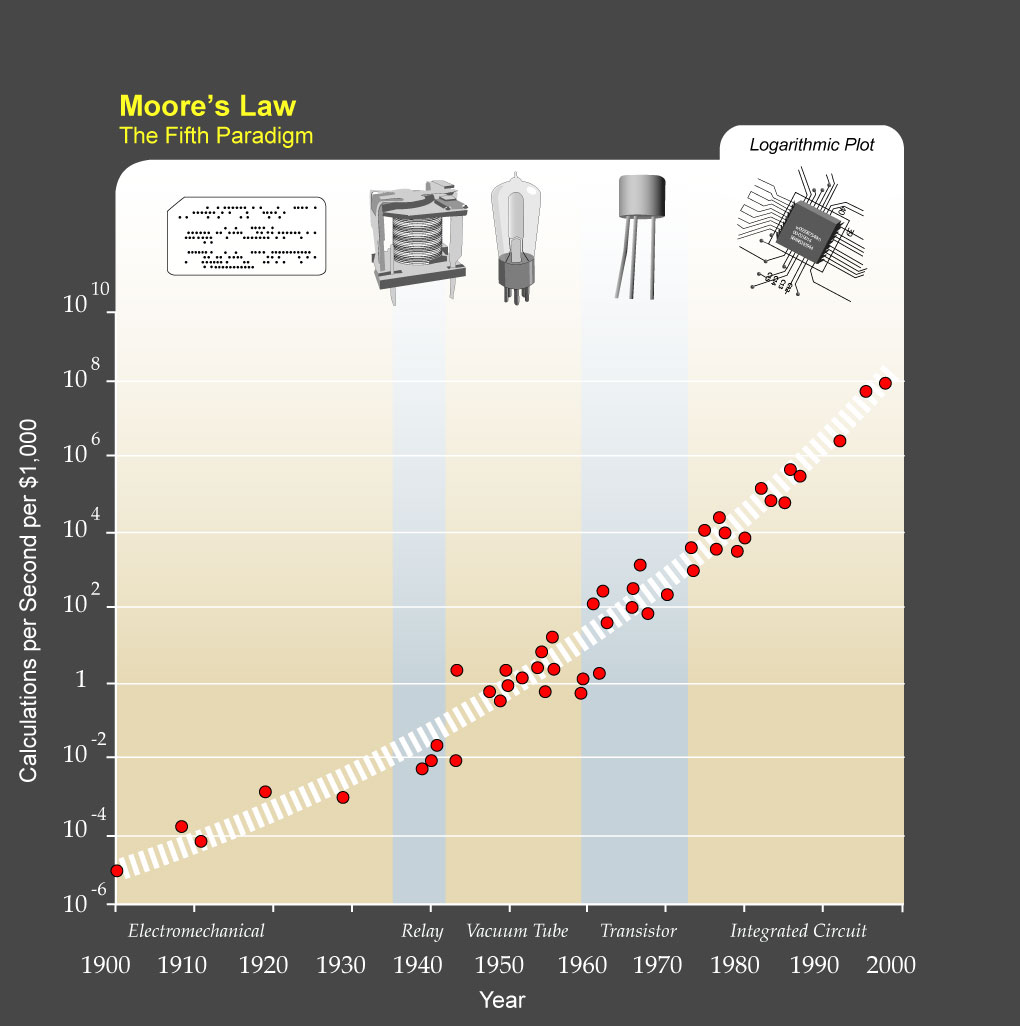

Kurzweil jóslatának alapja az exponenciális ütemű fejlődés, ez vezethet viszonylag rövid időn belül az MI és a szingularitás eléréséhez. Ilyen exponenciális fejlődést tapasztalunk a technika számos területén. A legismertebb a Moore-törvény, amely szerint az integrált áramkörök összetettsége 18 hónaponként megduplázódik. De hasonló exponenciális ütemű fejlődés érvényes a számítási sebességre vagy a chipek méretére is. Nagyjából évtizedenként minden lineáris méret a negyedére csökken. Az exponenciális javulás továbbá érvényes egységnyi költségre vonatkoztatva is, vagyis mindent egybevéve exponenciálisan nő az egy dollárra jutó számítási kapacitás.

Egyesek ellenvetése lehet, hogy a fejlődésnek fizikai korlátai vannak, de Kurzweil rámutat arra, hogy ettől nagyon távol vagyunk, ahogy azt már korábban említettem. Egy adott technikai megoldásra persze mindig érvényesek a fizikai korlátok, de a fejlődés során újabb és újabb technikai megoldások kerülnek elő. A fenti exponenciális ütemű fejlődés különféle technológiákon és paradigmákon kersztül érvényes, ahogy a fenti ábra is mutatja. Sőt Kurzweil amellett érvel, hogy igazából még az exponenciális kitevője is exponenciálisan növekszik, tehát a fejlődés még ennél is gyorsabb lesz, lásd a felfele görbülő trendet a logaritmikus ábrán. Személy szerint egyébként abból, hogy nincsenek olyan technológiai ugrások, amik nem illeszkednek a trendbe, azt a következtetést vonom le, hogy amíg nincsenek fizikai korlátok, addig a trend hajtórugója valójában a gazdasági fejlődés, ami mindig ki fogja termelni az újabb megoldásokat.

Mások ellenvetése az lehet, hogy bár nő a számítási kapacitás, az intelligencia megjelenése minőségi változást feltételez. Mi van akkor, ha a hardver exponenciálisan fejlődik, de ezt a szoftverről nem mondhatjuk el? Ez utóbbi fejlődését valóban nehéz kvantifikálni, de ugyancsak Kurzweil becsli a szoftverfejlesztés produktivitásának megkettőződési idejét, mégpedig körülbelül hat évre. Ugyanakkor az is elképzelhető, hogy nincs is szükség ultraokos szoftvert kitalálni. Ha az emberi agy által végzett algoritmusoknál tudunk majd jobbat alkotni, az persze előnyös, de abban az esetben, ha csak lemásoljuk szolgaian az emberi agyat, vagyis szimuláljuk a működését neuronális szinten, az is elegendő lehet. Lényegében ebből a célból indították mostanában a hatalmas költségvetésű amerikai és európai agykutatási projekteket. Ezeket azonban sokan kritizálják, hogy milyen okból, az egy másik cikknek lehetne a témája.

Az exponenciális fejlődés egyébként az agykutatásra is elmondható. A képalkotó eszközök tér- és időbeli felbontása évente megduplázódik, nem invazív és invazív eljárásokra egyaránt. A képalkotás sávszélessége, az ár-teljesítmény arány és a képrekonstrukció sebessége szintén exponenciálisan javul az idővel. Az agyból szerzett információk adatbázisának nagysága szintén duplázódik évente, a tudományterületen dolgozó tudósok számáról már nem is beszélve.

Csak az emberiség megérje!

A szingularitáskritikák három csoportra oszthatók. Egyesek megkérdőjelezik az exponenciális trendek jövőre való kivetíthetőségét. Erről már beszéltünk, de ha nem is lenne pontos az exponenciális becslés, véleményem szerint legfeljebb pár évtized tévedést okozhat. Mások az emberivel egyenértékű MI létrehozásának lehetőségében kételkednek, ők valószínűleg azt feltételezik, hogy az agy több, mint a fizikai törvények által leírható objektum.

Szintén mások, bár úgy hiszik, hogy a szingularitás lehetséges, azt veszélyesnek és elkerülendőnek tartják, bár én azt gondolom, a technikai fejlődést mesterségesen megakadályozni nem lehet. Sajnos a pálmaolajüzletben tömegesen elpusztított orángutánok esete igazolni látszik a félelmet, ha ugyanis az emberiség így viselkedik az egyik legközelebbi rokonával, az nem sok jóra utal egy esetleges MI-nek a hozzánk való viszonyával kapcsolatban. Kurtzweil azonban amellett is érvel, hogy az MI nem egy szeparáltan alkotott gép formájában jön el, hanem mi magunk fogunk fokozatosan átalakulni, a nanotechnológia és biotechnológia segítségével. Ilyen forgatókönyv mellett pedig csak az a kérdés, hogy kell-e majd saját magunktól félnünk.

Azt gondolom azonban, hogy végeredményben a legfőbb akadály egyáltalán nem technikai jellegű. Az a kérdés, hogy ez az egész bekövetkezik-e azelőtt, mint hogy az egész emberiség jelentős válságba kerülne, amely jelentősen visszaveti a technikai civilizációt, és akár túlélésünket is veszélyezteti. Gondolhatunk itt például globális klímakatasztrófára, világháborúra, gazdasági válságokra vagy világméretű járványokra, melyek mindegyikének reális veszélye van.