Tényleg elpusztítja az emberiséget a mesterséges intelligencia?

Stephen Hawking, a legendás fizikus 2015-ben arra figyelmeztetett, hogy ha tovább kísérletezgetünk a mesterséges intelligenciával, az az emberiség kipusztulásához vezethet. Nem ő az egyetlen, aki így gondolja: miközben az MI egyre sebesebb tempóban fejlődik, egyre többen aggódnak amiatt, hogy idővel elszabadul, és ha tökéletesebb lesz, mint teremtője, az ember, megállíthatatlanná válik.

Ez nem sci-fi, hanem a valóság: a megvadult konteóhívőkön és Hawkingon kívül viszonylag sokan számolnak azzal, hogy ez egyszer megtörténik, és komoly kutatásokat folytatnak annak érdekében, hogy az emberiség ne szabadítson magára egy digitális szörnyszülöttet. Jaan Tallinn, a Skype társalapítója annyira komolyan veszi ezt a veszélyt, hogy az évek során 600 ezer dollárt adományozott a problémát kutató Machine Intelligence Research Institute-nak. Tallinn szerint hasonló történelmi helyzetben van az emberiség, mint az atombomba kifejlesztésekor, és ennek megfelelően a mesterséges intelligencia kutatóinak és fejlesztőinek is ki kellene állniuk a nyilvánosság elé, és a Manhattan-terv kutatóihoz hasonlóan fel kellene hívniuk a nyilvánosság figyelmét a technológia veszélyeire. Elon Musk, Bill Gates, Steve Wozniak és egy tucatnyi tudós, köztük két Nobel-díjas kutató néhány éve nyílt levélben figyelmeztették az emberiséget arra, hogy a mesterséges intelligencia veszélyes is lehet.

Még nincs itt a Skynet

De mekkora a veszély? A mesterséges intelligencia jelenlegi formájában nem túl ijesztő, és nagyon messze jár a szuperintelligenciától. Az, hogy az algoritmus le tudja győzni a sakkbajnokot sakkban, a go-bajnokot góban, sőt mesterien tetrisezik, még nem jelenti azt, hogy készen áll a világuralomra. Ezekből a példákból talán a Tetris a leginkább aggasztó: egy Tom Murphy VII nevű programozó 2013-ban létrehozta a tökéletes tetrisezőt, ami egyetlen meccset sem veszített el. A program titka az volt, hogy simán lepauzálta a játékot, a nyerő stratégia meg az, hogy úgy nem veszített, hogy nem is játszott. A módszer némileg hasonlít arra, mint amikor a sakkozó szétveri a táblát az ellenfele fején, amikor mattot kap, de tulajdonképpen működik.

Egyes kutatók jobban aggódnak, mások kevésbé, megint mások pedig amellett érvelnek, hogy ez az egész vihar a biliben, több köze van a Terminátorhoz, mint a tudományhoz. Mindegyik tábornak megvannak a maguk előfeltételezései, a helyzetet pedig némileg megnehezíti, hogy az, amiről beszélnek, egyelőre még nem is létezik (és persze az aggódók annak drukkolnak, hogy soha ne is létezzen). Az előfeltevések mellett persze külön problémát jelent az is, hogy ki mit ért intelligencia alatt.

Az aggódók érvei

Azok, akik nagyon aggódnak, nagyjából biztosra veszik, hogy az a szuperintelligencia, amitől tartanak, mindjárt itt van, sőt könnyen lehet, hogy már most késő megállítani, hiszen ha egy önmagát fejlesztő, az embernél sokkal intelligensebb valamiről van szó, bizonyára nem esik nehezére titokban tartani a saját fejlődését. A már korábban említett Tallinn szerint egy ilyen potenciális szuperintelligenciának nem is jelentene különösebb korlátozást az, amit az emberek kitalálnak neki: az általa feltételezett algoritmus úgy viszonyul az emberhez, mint az ember a gorillához. Azt, hogy egy ilyen szuperintelligenciát az ember felügyeljen, ahhoz hasonlította, mint ha egy meglett embert próbálna foglyul ejteni egy ötéves gyerek. Stuart Armstrong oxfordi matematikus-biológus szerint ráadásul bármilyen biztosíték, amit a rendszerbe építenének, óhatatlanul feltűnne a szuperintelligenciának, ha már tényleg szuperintelligens, és valószínűleg megtalálná a módját, hogy megkerülje a nagy piros gombot. A Tetrist játszó robot is rájött, hogyan lehet játék nélkül nyerni.

Egy januári spanyol kutatás szerint ráadásul úgy néz ki, hogy egy ilyen szuperintelligenciának bizonyos esetekben lehetetlen lenne parancsolni. Manuel Alfonseca, a tanulmány vezető szerzője szerint ugyan még nagyjából kétszáz évig ez nem jelent majd problémát a gyakorlatban, később viszont még gondokat okozhat. Alfonseca maga is elismeri, hogy egyelőre csak gondolatkísérletről van szó, és az sem biztos, hogy egyáltalán lehetséges egy ilyen szuperintelligencia létrehozása, annyit viszont bizonyítottnak lát, hogy az ilyesmit nem lehetne tökéletes kontroll alatt tartani.

Ahogy a részben ismertetett névsor is utal rá, ezek az emberek nem ludditák: Hawking sem a mesterséges intelligencia alkalmazása ellen emelt szót (ha nem lett volna mesterséges intelligencia, egyáltalán nem is tudott volna szót emelni, hiszen a kommunikációban is ez a technológia segítette), hanem az ellenőrizetlen, elvadult, extrém formája ellen, ami, ugye, egyelőre csak feltételezés. A mesterséges intelligencia, ha felelőtlenül használják, már a szuperintelligencia létrejötte előtt is komoly problémákat okozhat: könnyen elképzelhető, hogy az emberiségnek nem is maradt kétszáz éve, mert az autonóm robothadseregek már azelőtt felperzselik a Földet, hogy ideje lenne kifejlődnie annak a bizonyos szuperintelligenciának.

Óvatos optimizmus

Ha eltekintünk a megvadult robothordáktól, amelyek kiirtják az emberiséget, illetve attól, hogy egy emberfeletti algoritmus hirtelen úgy dönthet, hogy a bolygó (program, terv, bármi) sikerét épp az emberiség gátolja, ezért meg kell szabadulni tőle, a mesterséges intelligencia egyébként elég hasznos dolog. Az autonóm fegyvereken és drónokon kívül egy sor hasznos, sőt, életmentő alkalmazása létezik: magabiztosabban diagnosztizálja a rákot, mint egy orvos, új gyógyszereket fejleszt ki, az optimista megközelítés szerint pedig a megfelelő használatával pedig akár végleg fel lehetne számolni az egyenlőtlenséget és a szegénységet. A kevésbé optimista álláspont szerint persze ez az új ipari forradalom is csak növeli az egyenlőtlenségeket, mindenesetre abban sokan egyetértenek, hogy felbecsülhetetlen értékű eszközről van szó.

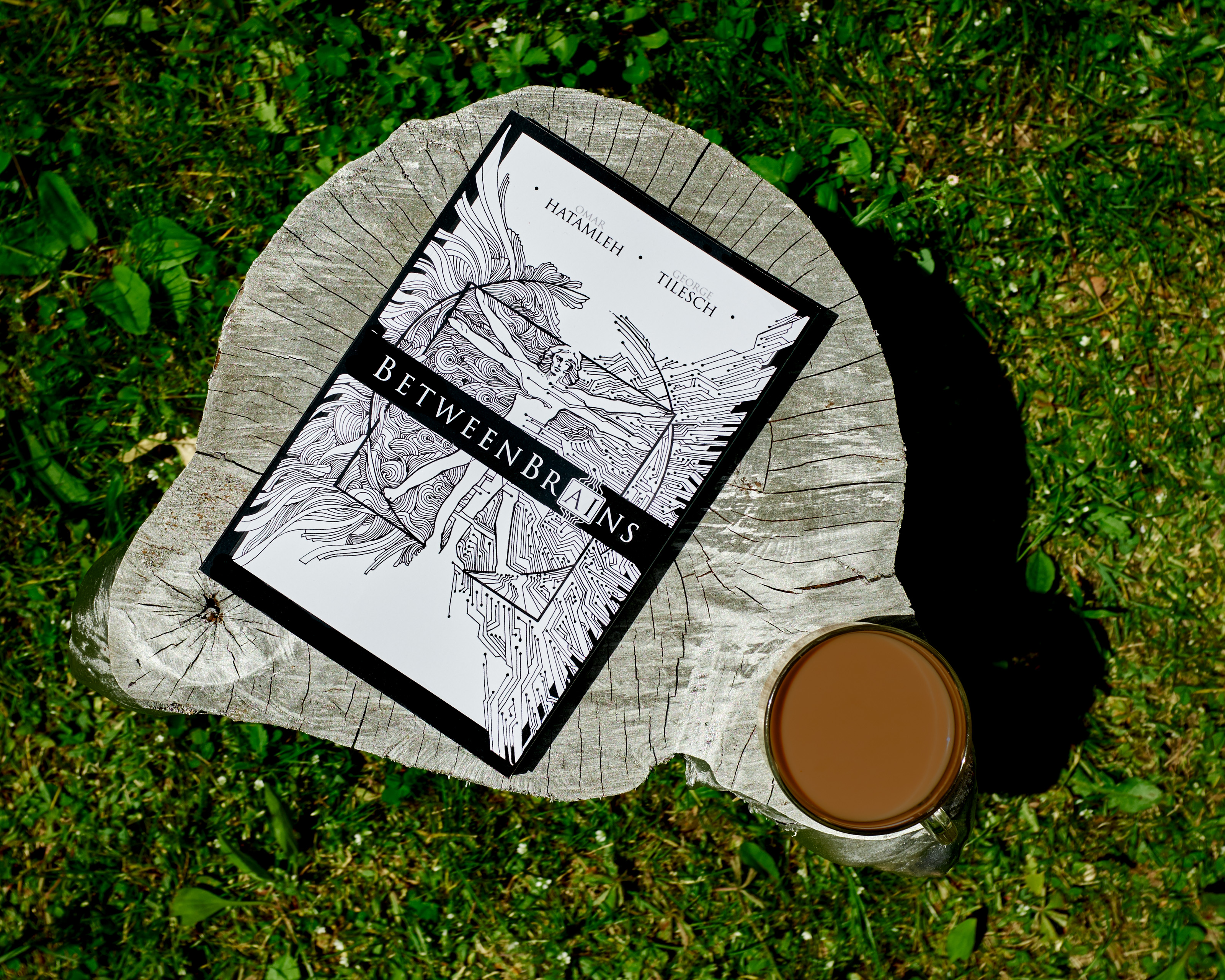

Tilesch György és Omar Hatamleh magyarul idén megjelent könyvükben, a Mesterség és Intelligenciában újrahuzalozott iparágakról írnak, és nem véletlenül. A szerzőpáros szerint a félelmek ellenére a Skynet-szingularitás elmaradt, emiatt pedig sokan nem is veszik komolyan az éppen zajló tudományos és ipari forradalmat – mégpedig ehhez hasonlót még nem élt át az emberiség. Kétségtelen, hogy átalakul a logisztikai ipar, az építőipar, az oktatás és az egészségügy is, és ez nem feltétlenül baj, de az ilyesmi mindig veszélyeket rejt magában, méghozzá nem is annyira az algoritmusok, hanem az emberi reakciók miatt.

Az óvatos optimisták szerint a kulcskérdés a szabályozás (az előbb említett könyv hetedik és főleg nyolcadik fejezete teljes egészében ezzel foglalkozik: a szerzőpáros szerint elkerülhetetlen a globális együttműködés, átláthatóság és szabályozás, hogy az ipari forradalom sikert, és ne nyomort hozzon a világra).

A szabályozás lehet maga az erkölcsi törvény is: ha feltesszük, hogy van egy autonóm, tanulni és fejlődni képes szuperintelligencia, abba akár plántálhatnánk erkölcsi érzéket is. Meg kell ismertetni vele a Biblia, a Korán, a Tóra, a Bhagavad-Gíta és a buddhista szútrák tartalmát, el kell olvastatni vele Platón, Arisztotelész, Konfúciusz, Descartes és a többi nagy filozófus összes műveit, és hagyni, hogy ezek alapján rájöjjön, mi a jó és a rossz közötti különbség. A mesterséges intelligencia erkölcsi nevelését szorgalmazó szakértőknek valószínűleg feltűnt, hogy ez az elmúlt néhány ezer év alatt az emberiségnek sem sikerült igazán, no de a szuperintelligencia azért szuper, hogy ott is boldoguljon, ahol a teológia és a filozófia professzorai már nem. Ezzel párhuzamosan sokan úgy gondolják, hogy nem ártana, ha nem is a robotok, hanem a programozók foglalkoznának többet az etikával, bár a kifejezetten a jó és rossz közötti különbségtételre specializált robotok ötlete egyszerre hangzik riasztónak és csábítónak. Ezt Ronald Dworkin vetette fel a Herkules bírónak keresztelt robotról szóló gondolatkísérletben: itt a helyesről és a helytelenről szóló vélekedések minél nagyobb mintáját kaphatná meg a robot, amely ezután ezeket elemezné, és megteremtené azt a közös erkölcsi alapot, amely szerint egy cselekedet jó vagy rossz, ennek megfelelően pedig igazságosabb és elfogulatlanabb ítéletet tudna hozni, mint bármely bíró vagy esküdtszék.

Nincs itt semmi látnivaló

Szuperintelligencia még nem létezik, és könnyen lehet, hogy soha nem is jön létre. Vannak nagyon hatékony algoritmusok, amelyek kiválóan teljesítenek egy szűk területen, de ha az összteljesítményt nézzük, messze elmaradtnak még az embertől. Megver sakkban? Oké, de ki tud menni a hűtőhöz egy sörért, orra tud esni a kutyában, és miután orra esik, eltűnődik-e rajta, hogy vajon Ádámnak és Évának a Paradicsomban volt-e köldöke, és ha volt, az vajon azt is jelenti-e, hogy Istennek is volt köldöke? És ha volt, akkor minek? Na ugye.

Az ember többek között attól ember, hogy számtalan olyan hülyeségre képes, amire a mesterséges intelligencia valószínűleg soha nem lesz. „Az emberi intelligencia olyan, a mesterséges intelligencia által nem értelmezhető dimenziókkal rendelkezik, mint az empátia, intuíció, ítélőképesség, szenvedély, érzelmek”, olvashatjuk Tilesch és Hatamleh könyvében. Mire akkor ez a nagy felhajtás?

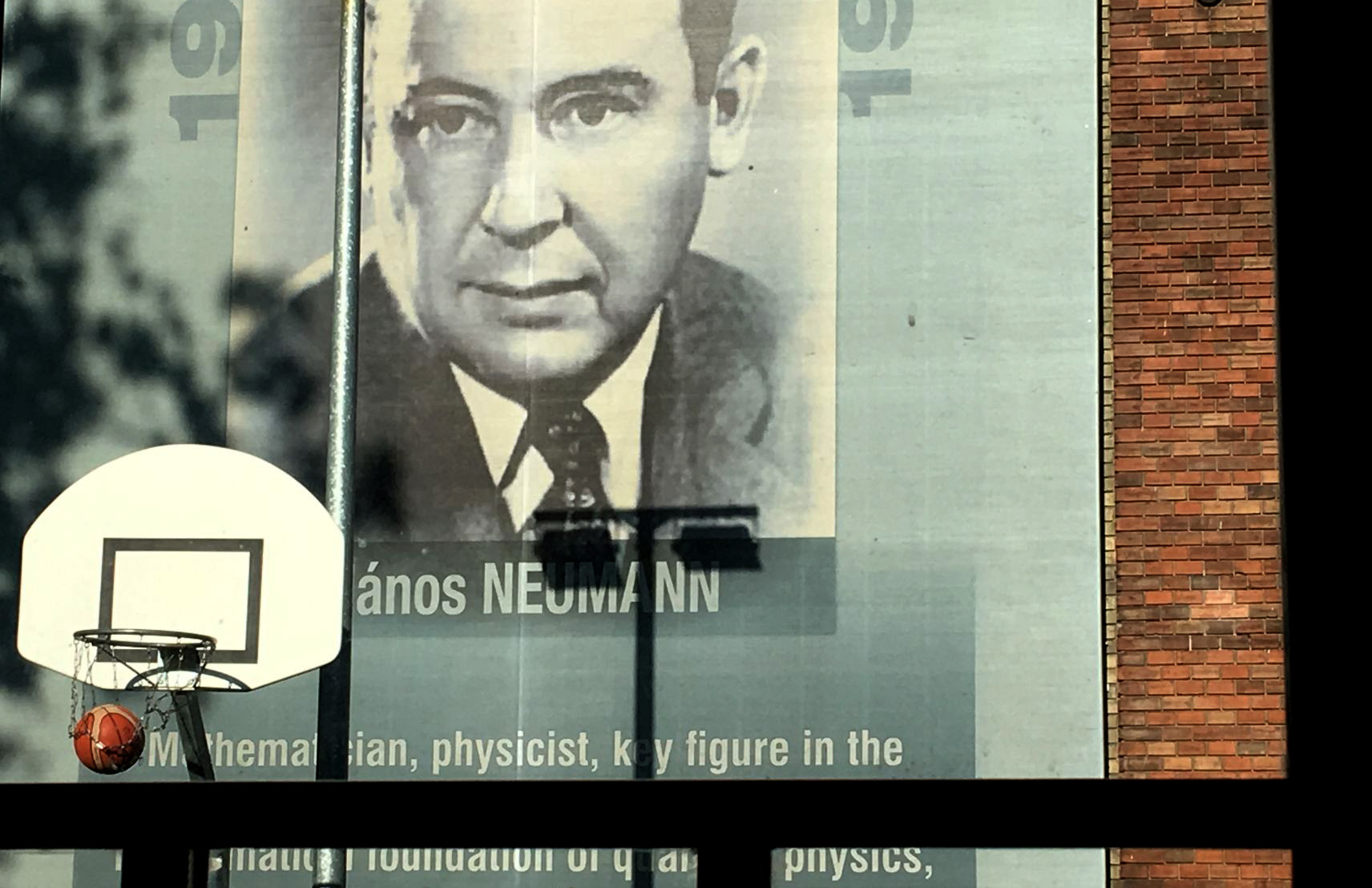

Alfonseca abban látta a problémát, hogy a mesterséges intelligencia nem tudja előre felmérni a tettek következményeit, legalábbis nem minden esetben, ezért a viselkedése nem is kontrollálható. Egy másik kutatásban Mauro Vallati, a Huddersfieldi Egyetem számítástechnikai szakembere épp ebben látja a gátját annak, hogy egyáltalán kifejleszthető legyen a szuperintelligencia: a kicselezhetetlen, emberfeletti algoritmus sem látja előre a jövőt. Vallati úgy látja, hogy mivel a kvantumelmélet szerint az univerzum kaotikus, instabil és kiszámíthatatlan, minden lehetséges intelligenciának el kell érnie azt a határvonalat, ameddig viszonylag megbízható jóslatokba bocsátkozhat, de ez soha nem lehet tökéletes – a káosznak mindig marad némi helye. Tökéletes jóslás és tökéletes intelligencia nem létezik. Igaz, elméletileg lehetséges, hogy csak az ember nem lát előre mindent, és erre egy fejlettebb algoritmus akár képes is lehet, de ez a dolgok jelenlegi állása szerint elég valószínűtlennek tűnik.

Vannak, akik szerint már a kérdés is rossz, mert az alapjául szolgáló felvetések is rosszak. Kevin Kelly, a Wired társalapítója szerint öt (hibás) premissza alapján rettegnek, akik rettegnek. Ezek a következők:

- a mesterséges intelligencia máris intelligensebb nálunk, és exponenciálisan növekvő mértékben egyre inkább az lesz;

- a mesterséges intelligenciát általánossá, az emberi intelligenciához hasonlatossá fogjuk fejleszteni;

- az emberi agy működését mesterségesen tudjuk modellezni;

- az intelligencia növekedése korlátlan;

- ha sikerült megteremteni a szuperintelligenciát, az az emberiség legtöbb problémáját képes lesz megoldani.

Kelly szerint ezek közül egyik sem igaz – eleve az intelligencia fogalma sem tisztázott, nem lenne gazdaságos egy ilyen eszköz kifejlesztése, és nem is vágyna senki ilyesmire. Az intelligenciának van küszöbe, és nem is minden arról szól, hogy ki az „okosabb”, mert ilyen nincs is. Az eredmény? Nincs Skynet, nincs Arnold, nincs világpusztulás, és nincs olyan evolúciós ranglétra sem, ahol egy az embernél intelligensebb bármi automatikusan kipusztítaná a nála kevésbé intelligens lényeket. A gorillának ugyanannyi ideje volt fejlődni, mint nekünk, még sincs mikrója, nem is szállt a Holdra. Eddig jutott.

És akkor most mi van?

Jobb félni, mint megijedni – nagyjából így néz ki most a konszenzus. Lehet nagy baj abból, ha szabadjára engedjük a mesterséges intelligenciát? Lehet, de ez nem a gép hibája lesz, hanem az emberé. Volt már náci és nőgyűlölő chatbot, Hitlert éltető ikeás segítő, és lesz is még egy sor ilyesmi. Van, hogy rosszabb hitelminősítéseket adnak feketéknek, mint fehéreknek, mert úgy dönt az algoritmus, és van, hogy senkihez nem jut el egy cikk, mert a Facebook úgy gondolja, hogy senkit sem érdekel. A hibákat alapvetően mind emberek okozták, és ha egy program olyasmit dob ki, amire senki sem számított, abban sincs semmi különös, ez egybevág Murphy törvényével (ami elromolhat, el is romlik) és Rice elméletével is (ez utóbbi azt mondja ki, hogy a program által közölt eredmények csak akkor biztosak, ha a program már kiszámította őket, akár hülyeségek, akár nem).

Mégis van látnivaló

Lehet, hogy Skynet nincs, de átalakulás van: a szűk értelemben vett MI már itt van velünk, és ez nem feltétlenül jobb hír az aggodalmaskodók számára, mint a szuperintelligencia, amivel választásokat lehet nyerni, deepfake videókat lehet készíteni, és az elképesztő mennyiségű adattal elképesztő mennyiségű adathoz lehet jutni. Ez adja el neked a tévét, a Jokkmokk étkezőgarnitúrát, és ez hirdeti neked ugyanezt a garnitúrát az után is, hogy megvetted. De tanul, okosodik, idővel kiismeri a szokásaidat, az életedet, az ízlésedet, és egyszer csak azon kapod magad, hogy már megint vettél egy asztalt négy székkel. „Egyszerű és strapabíró készlet, amely a reggelizősarokba és kisebb étkezőkbe is ideális”. Vesd össze: „Minden értékem, beleértve a kristályzöld üveg étkészletet, amelyben a lehetletnyi buborékok és homokszemek, az apró csiszolási hibák megnyugtatóan bizonyítják, hogy darabjait bizony saját kezűleg készítették egyszerű, dolgos iparosok valahol Nyasszaföldön, szóval az égvilágon mindenem megsemmisült egy gázrobbanásban”.

És a tanulság? A Pegasus után és ki tudja, mi előtt, jobb vigyázni: gonosz robotok még talán nincsenek, de gonosz emberek mindig is voltak.

Kapcsolódó cikkek a Qubiten:

Asimovtól a Tesláig: a mesterséges intelligencia akár meg is taníthat rá, hogyan viselkedjünk

Ideje komolyan venni a mesterséges intelligencia szabályozását, de még mindig nem világos, hogy egy autonóm döntéshozó robot esetében ki lehetne a felelős a mesterséges intelligencia döntéseiért. Két gondolatkísérlet viszont azt mutatja, hogy nem csak taníthatjuk a moralitást a robotoknak, hanem esetleg még tanulhatjuk is tőlük.

Vér nélkül lezajlik az információs forradalom, vagy lesznek áldozatai is?

A digitális átalakulás következményeit tárgyalta a Graphisoft-alapító Bojár Gábor szombaton elindított vitasorozata, amelyen szociológus, biotechnológus és közgazdász fontolgatta, mit hoz a jövő.

Nem létezik olyan algoritmus, ami hülyébb lehetne, mint maga az ember

A mesterséges intelligencia lehet áldás és átok is: miközben gyakran az sem világos, hogy mire képes jelenlegi állapotában, komoly indulatokat gerjeszt a felhasználókban. Ebben a zűrzavarban próbál rendet vágni George Tilesch és Omar Hatamleh angolul nemrég megjelent könyve, a BetweenBrains.