Szerencse, hogy nem létezik a gépi szuperintelligencia, mert ha létezne, nem irányíthatnánk

Számítástudományi szakértők és filozófusok gyakran hangoztatott kérdése, hogy vajon képesek lennénk-e uralni egy mesterséges szuperintelligenciát. A kérdés ma még céltalan léggömbhámozásnak tűnik, hiszen nem liheg a nyakunkban a Skynet. Ugyanakkor gondoskodnunk kell róla, hogy a mesterséges intelligenciák fejlődése ne jelentsen veszélyt az emberiségre.

„Egy szuperintelligens gép, ami képes uralni a világot, ma még sci-finek hangzik. De már ma is léteznek gépek, amik önállóan hajthatnak végre fontos feladatokat, méghozzá úgy, hogy néha még a programozók sem értik teljesen a működési elvét. Joggal merül fel a kérdés, hogy mindez ellenőrizhetetlenné és veszélyessé válhat-e majd az emberiség számára.”

– mondta a Techxplore hírportálnak Manuel Cebrian, a Max Planck Intézethez tartozó Digital Mobilization Group vezetője.

Cebrian és munkatársai – egy nemzetközi kutatócsoport – elméleti számításokkal igyekezett választ találni a kérdésre. A kutatásuk azt az eredményt hozta, hogy a szuperintelligens AI-k irányítása alapvetően lehetetlen. A témával foglalkozó tanulmányt („Superintelligence Cannot Be Contained: Lessons From Computability Theory”) a Journal of Artificial Intelligence Research folyóirat közölte.

A kutatók arra voltak kíváncsiak, hogy ha egy mesterségesintelligencia-alapú rendszert csatlakoztatunk az internethez, hogy az AI hozzáférhessen az emberiség által felhalmozott összes adathoz, annak vajon utópia vagy disztópia lenne a vége? Mit tenne a az AI? Rákot gyógyítana? Kivívná a világbékét? Visszafordítaná a klímaváltozás folyamatát? Vagy leigázná az emberiséget, és átvenné a bolygó fölötti uralmat?

Hülye legyen vagy veszélyes?

Cebrian és munkatársai a kutatásban két, a szuperintelligencia kordában tartását célzó megközelítést vizsgáltak meg:

- Zárjuk el a mesterséges intelligenciát a tanulás lehetőségétől! Egy szuperintelligens AI képességeit jelentős mértékben korlátozná, ha elzárnák az interneten és az adathordozókon tárolt információktól, és nem lenne kapcsolata a külvilággal. Ha azonban megfosztanánk a szuperintelligenciát a tanulás lehetőségétől, csökkenne a hatékonysága, és nem tudna megfelelő válaszokat adni a neki feltett kérdésekre.

- Tanítsuk erkölcstanra a mesterséges intelligenciát! Ha elvetjük az előbbi lehetőséget, megpróbálkozhatunk azzal, hogy az AI-t a kezdetektől fogva az emberiséget szolgáló célok követésére motiváljuk – például etikai irányelvek megadásával. A kutatók azonban kimutatták, hogy ennek, illetve más, a szuperintelligens AI-k megzabolázását célzó törekvéseknek megvannak a technikai korlátai.

A tanulmányhoz a kutatók megalkottak egy elszigetelést biztosító algoritmust, ami biztosíthatja, hogy a szuperintelligens AI-k semmilyen körülmények között ne okozzanak kárt az embereknek. Az algoritmus először szimulálta az AI viselkedését, és ha károsnak érezte azt, leállította a működését.

Jól hangzik – csakhogy a tapasztalatok azt mutatják, hogy a ma használt számítástudományi paradigmában nem lehet ilyen algoritmust írni.

„Ha a problémát visszabontjuk az elméleti számítástudomány alapjaiig, kiderül, hogy egy algoritmus, ami arra utasíthatna egy mesterséges intelligenciát, hogy ne pusztítsa el a világot, akaratlanul is leállíthatja a saját működését. Ha ez megtörténne, nem tudnánk, hogy vajon a korlátozó algoritmus még mindig a fenyegetést vizsgálja-e, vagy leállt, hogy csapdába ejtse a kártékony AI-t. Ez a mechanizmus használhatatlanná teszi a korlátozó algoritmust.”

– mondta Iyad Rahwan, a Center for Humans and Machines igazgatója.

A kutatók számításai alapján nem lehetséges a szuperintelligens AI-ket ellenőrzés alatt tartó algoritmusokat fejleszteni, mivel nincs önálló algoritmus, ami meghatározhatná, hogy a mesterséges intelligencia veszélyezteti-e az világot.

A kutatók eredményeiből az is levezethető, hogy valószínűleg nem fogjuk tudni, hogy mikor válnak valósággá a szuperintelligens gépek, mert annak az eldöntése, hogy egy gép intelligensebb-e az embernél, ugyanahhoz a problémakörhöz tartozik, mint az elszigetelő algoritmusok működése.

Kapcsolódó cikkek a Qubiten:

A gyilkos robotokat még azelőtt be kell tiltani, hogy elkezdenék a gyártásukat

A mesterséges intelligenciával rendelkező, emberi felügyelet nélkül támadni képes fegyverek előzetes tiltása mellett érvel az a jelentés, amelyet az Állítsuk meg a gyilkos robotokat nevű kampány magyar aktivistái az egyetemeken és a parlamentben is terjesztenek majd.

Mit tanulhat Buddhától a mesterséges intelligencia?

Az AI etikai kérdéseivel foglalkozó szakértőknek remek ihletforrások lehetnek az olyan buddhista tanítások, mint az együttérzés, az önfejlesztés, az elszámoltathatóság, vagy a szenvedés megszüntetésére irányuló törekvések.

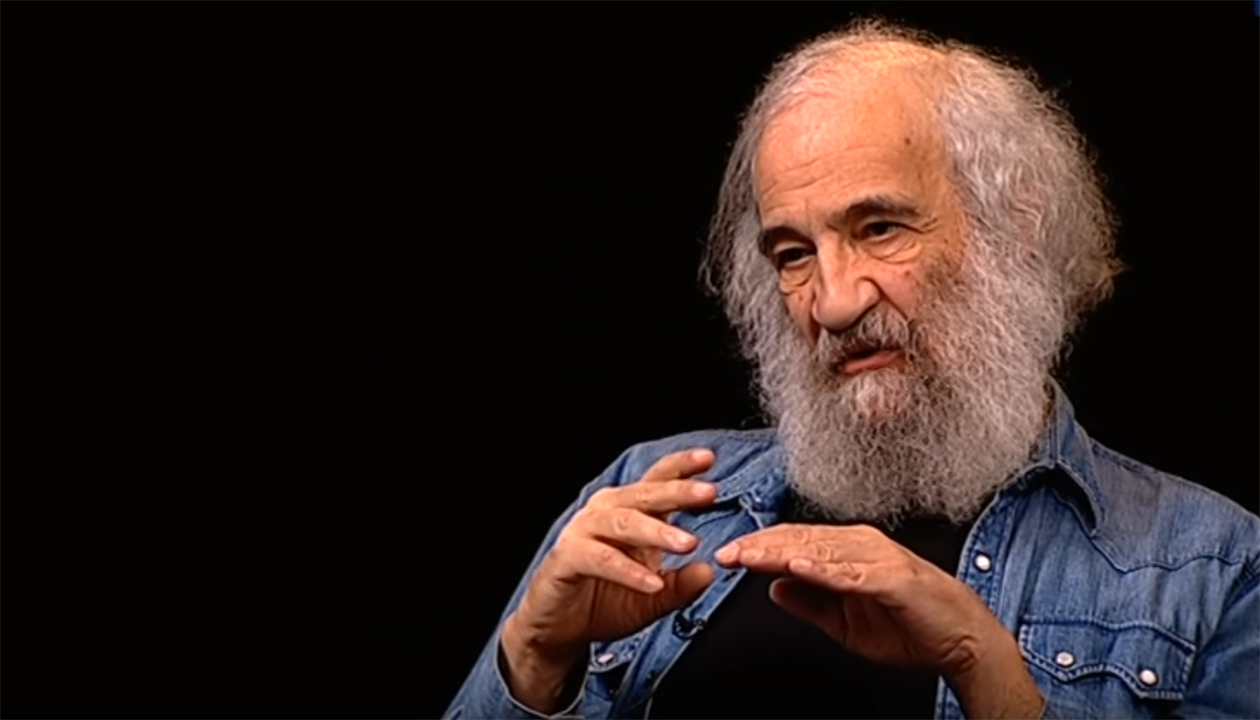

Mérő László: Ha az önvezető autóm versekről diskurálna, vinném a bontóba

Nem az a kérdés, hogy öntudatra ébredhet-e a mesterséges intelligencia, hanem az, hogy az ember hogyan tud majd kooperálni olyasvalamivel, ami bizonyos területeken okosabb nála, és hogyan köt majd vele kompromisszumot - mondta Mérő László kedd este az Európa Pontban megrendezett, A mesterséges intelligencia közeljövője című előadásán.