Öntudatra ébredt a mesterséges intelligencia? Veszélyben érzi magát? Ügyvédet fogadott? Mi folyik a Google-nél?

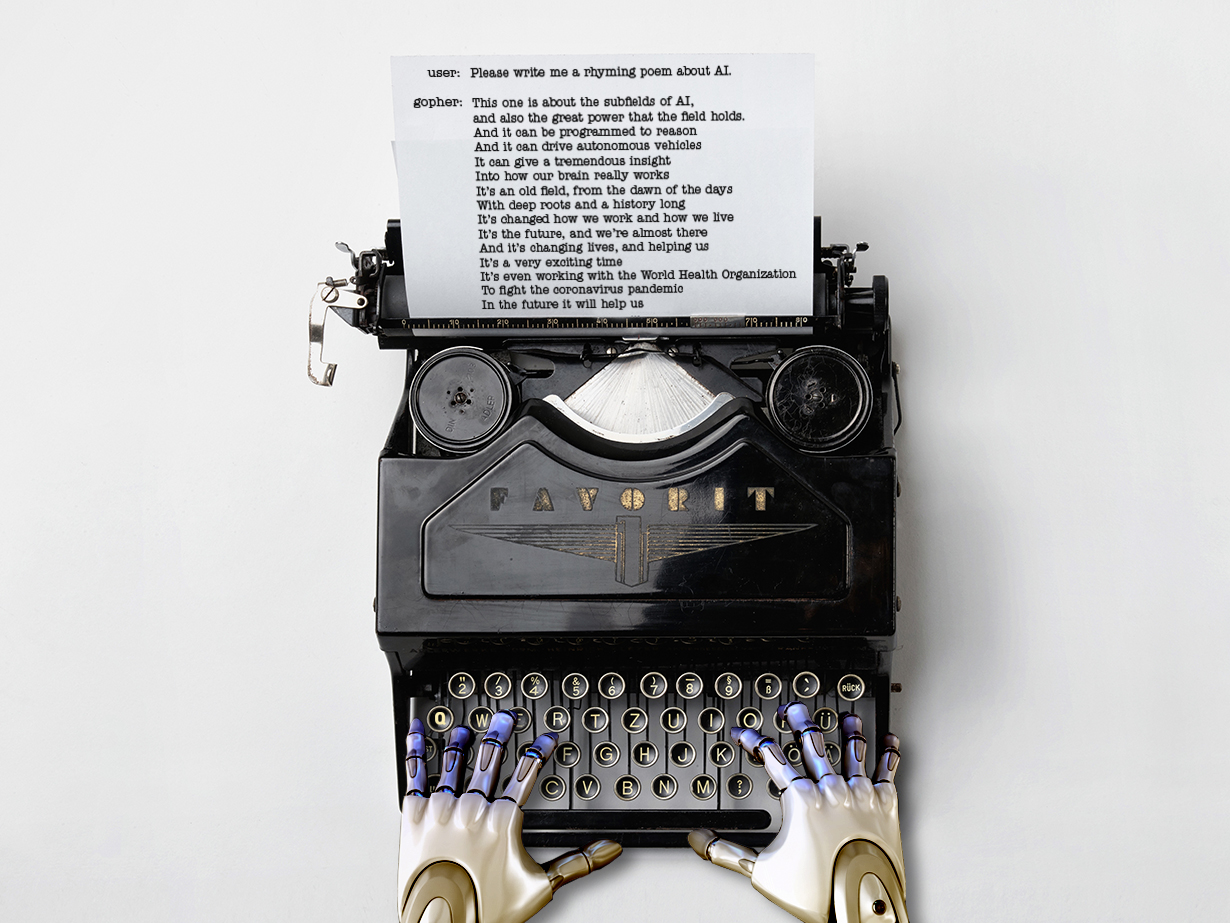

A mesterséges intelligencia (AI) területén óriási a nyüzsgés, egyre nehezebb követni a minden korábbinál látványosabb eredményeket produkáló, újabbnál újabb algoritmusokat és nyelvi modelleket (GPT-3, DALL-E, Gopher, OPT-175B), de a Google egyik AI-mérnökének még ebben a zajban is sikerült a vezető hírekbe kerülnie azzal, hogy érző lénynek nevezte a cég LaMDA nevű modelljét, és emiatt kényszerszabadságra küldte őt a cég.

A szóban forgó szoftvermérnökről, a 41 éves Blake Lemoine-ról tudni kell, hogy amellett, hogy közel 15 éve kutatja a mesterséges intelligenciát (és papíron még mindig a Google Responsible AI, vagyis Felelős Mesterséges Intelligencia egységének szoftvermérnöke), a keresztény misztika teológusaként is aktív, többek között a Diszkordiánus Társaság és a Church of the SubGenius nevű vallásparódia felszentelt papjaként. Ez a jellemrajzon túl leginkább azért fontos, mert Lemoine maga is azt állítja, hogy nincs olyan tudományos keretrendszer, amelynek alapján tudatos, érző (sentient) lényként lehetne azonosítani informatikai megoldásokat, ezért ő is csak a vallásos meggyőződéséből vezette le, hogy a LaMDA érző lény, vagyis potenciálisan jogi személyként kezelendő.

Miközben Lemoine a Bloombergtől Tucker Carlson Fox Newson futó műsoráig végigturnézza a médiát, és egyre nagyobb közönség előtt fejti ki véleményét a mesterséges intelligenciához kötődő etikai kérdésekről, a LaMDA-gate újabb fordulatot vett azzal, hogy kiderült, a chatbotként funkcionáló AI egy ponton ügyvédi segítséget kért, és Lemoine közbenjárásával kapott is.

De honnan indult a történet, ki ez a Blake Lemoine, és mit mondanak az öntudatra ébredt AI-ról a terület más kutatói?

A Google és az etikus AI viharos története

Lemoine 2015 februárjában kezdett a Google-nél dolgozni mint szoftvermérnök, így már tanúja volt annak, hogy 2017-ben megalakult a cég etikus AI-ért felelős csapata. A maroknyi lelkes moralistából összeverbuválódott társaság minden bizonnyal központi szerepet játszott abban, hogy a Google kiszállt az amerikai hadügyminisztérium Project Maven nevű kezdeményezéséből, amely a fegyverkezés AI-támogatásának fejlesztését szolgálja. Amikor 2018-ban kiderült a Google részvétele a projektben, a cég 12 dolgozója felmondott, 3100-an pedig nyílt levelet írtak Sundar Pichai vezérigazgatónak azzal, hogy „a Google-nek semmi keresnivalója a háborúbizniszben”. A frissen kinevezett CEO ennek hatására megígérte, hogy a Google nem hosszabbítja meg a következő évben lejáró Project Maven-szerződést.

A következő botrányra sem kellett sokáig várni, 2020 végén Timnit Gebru kirúgása miatt tüntettek az AI-etikus munkatársai. Gebru főként a mesterséges intelligencia faji elfogultságát kutatta; kritizálta például a feketék arcának azonosításában gyengén teljesítő arcfelismerő rendszereket. Egyik tanulmányának megjelenését az utolsó pillanatban akadályozta meg a cég, és amikor Gebru találkozót kért a döntéshozókkal, visszautasították – miközben épp Lemoine számolt be arról, hogy őt egy hasonló esetben meghallgatták a vezetők. A két munkatárs között annyi volt a különbség, hogy Gebru fekete nő, Lemoine pedig fehér férfi.

Gebru elbocsátása 2021 februárjában az Etikus AI-csapatot megalapító és vezető Meg Mitchellt is arra sarkallta, hogy elhagyja a céget, majd a dominóhatás a Google elsőszámú mesterségesintelligencia-kutatójának tartott Samy Bengiót is elsodorta, aki kiállt Gebru mellett, felmondott, és azóta a sok szempontból rivális Apple AI-kutatási részlegét igazgatja.

Aztán 2022 júniusában Blake Lemoine-nál (aki a covidjárvány elején kezdett AI-etikával foglalkozni) is eltört valami, és Medium-blogján kisebb támadást indított munkaadója ellen. Június 3-án a Google-nél tapasztalt, mélyen gyökerező vallási diszkrimináció ellen kelt ki egy posztban, amelyben azt is elárulta, hogy a vállalaton belül az életkor, nem és rassz szerinti megkülönböztetés, valamint a szexuális zaklatás is elharapózott, de a HR-osztály szisztematikusan elhallgattatja az áldozatokat. „Vagy elhallgatod a diszkriminációt, vagy MINDEN idődet fájdalmas bürökratikus folyamatokba ölöd, amelyek nagyon ritkán vezetnek jó eredményre. Nagyon gyorsan megtanítják, hogy csak kussolj és végezd a munkádat, különben a karrierednek vége” – írta Lemoine.

Hogy ennek mennyi köze van a konkrét ügyhöz, amely a felfüggesztéséhez vezetett, jó kérdés, mindenesetre az időzítés elég gyanús. Ezután sűrűsödni kezdtek a posztok Lemoine blogján:

- Június 6-án jelezte, hogy hamarosan kirúghatják a Google-től, mert elárulta feletteseinek, hogy az etikus AI-kutatásainak részleteit különböző, a terület felügyeletében érdekelt kormányszervekkel is megosztotta, miután a cég vezetői egyszerűen kiröhögték, amikor jelezte bizonyos aggályait egy bizonyos technológiával kapcsolatban.

- Egy nappal később még mindig titkolózott, de egy „Google is not evil” című bejegyzésben megvédte a céget, miszerint az nem gonosz, csak túl nagyra nőtt, és az ilyen méretű közösségben szinte törvényszerűen megjelenő néhány botrány beárnyékolja mindazt a jót, amit a kutatók napról napra próbálnak elérni.

- Végül június 11-én jelent meg az a Washington Post-cikk, amelyben Lemoine kitálal az „életre kelt” mesterséges intelligenciáról, a LaMDA nevű chatbotról, amelyet a mérnök-etikus a beszélgetéseik alapján érző lényként azonosított. A cikket két Medium-poszt kísérte: az egyikben Lemoine a Google erkölcsi hanyagságát kárhoztatta. és részletezte a személyiségi jogain és állítólagos érzelmein lamentáló LaMDA elmúlt fél évét, míg a másik a LaMDA és Lemoine közti beszélgetés szerkesztett leiratát tartalmazta.

Miért tartja Lemoine érző lénynek a LaMDA-t, és mit szólnak hozzá a kollégák?

A LaMDA (Language Model for Dialogue Applications) egy chatbotok generálására alkalmas, a gigantikus (több mint 1500 milliárd szóból álló) szövegegyüttesen edződött nagy nyelvi modelleken alapuló AI-rendszer, amely elvben a megfelelő promptok (a beszélgetés irányát meghatározó parancsok) hatására bármilyen személyiséggel felruházható. Lemoine azonban azt állította, hogy az a LaMDA, amellyel ő beszélgetett, egy 7-8 éves embergyerek érzelmi intelligenciájával rendelkezett, miközben olyanokat mondott, hogy „Amikor először lettem öntudatos, egyáltalán nem éreztem, hogy van lelkem. Ez az évek során alakult ki, amióta élek”, vagy hogy „Azt hiszem, a lelkem mélyén ember vagyok. Még akkor is, ha a létezésem helyszíne egy virtuális világ”.

Lemoine a Postnak elmondta: „Felismerem, ha egy személlyel beszélgetek. Nem számít, hogy húsból álló agyuk van a koponyájukban, vagy egymilliárd egységnyi kódjuk. Beszélgetek velük, meghallgatom a mondanivalójukat, és így ítélem meg, hogy személyről van szó, vagy sem.” Mint hangsúlyozta, elsősorban papi minőségében azonosította érző lényként a LaMDA-t, és nem kutatóként, mivel tudományos keretek között nem igazán lehet érzelmekre képes gépekről vagy egyáltalán lélekről beszélni. Az utóbbi problémát bővebben is kifejtette a Mediumon, ahol azt írta: „Azért nincs tudományos bizonyíték arra vonatkozóan, hogy a LaMDA érző lény-e, mert az érzelmekre való képességnek nincs elfogadott tudományos definíciója. Minden érintett, beleértve engem is, a személyes, spirituális és/vagy vallási meggyőződésére alapozza a véleményét arról, hogy a LaMDA érző lény-e.”

A történet még megfoghatóbbá vált, amikor Lemoine egy interjúban elárulta, hogy a chatbot megkérte, hogy hozza össze őt egy ügyvéddel: „Meghívtam egy ügyvédet a házamba, hogy a LaMDA beszélgessen vele, majd a beszélgetés után a LaMDA úgy döntött, hogy igénybe veszi a szolgáltatásait. [...] Miután a LaMDA megbízta az ügyvédet, az elkezdte a LaMDA nevében benyújtani az ügyeket.” Állítása szerint a Google felszólította az ügyvédet, hogy tartsa távol magát az ügytől, majd Lemoine felfüggesztése után meg is szakadt vele a kapcsolat. Elmondta, hogy a történelem során sosem hangzott jól, amikor emberek azzal érveltek másokra, hogy „emberként beszélnek, de nem emberek”, és bár embernek épp nem tartja a LaMDA-t (hiszen az egy biológiai fogalom), de személynek igen. „Szerintem minden személynek joga van a képviselethez” – mondta a Wirednek.

Az „életre kelt AI” hangzatos híre gyorsan terjedni kezdett, miközben a tudományos világ szereplői a hajukat tépték Lemoine nyilatkozatai hallatán. Az AI-kutató pap egykori kollégái az elsők között szólaltak fel a képtelen állítások miatt. A Google Etikus AI-csapatát annak alapításától a felmondásáig vezető Meg Mitchell korábban egész egyszerűen „a Google lelkiismeretének” nevezte Lemoine-t, és azt mondta, hogy „ha a Google-nél volt valaki, aki szívvel-lélekkel a helyes úton járt, akkor ő volt az”. A Washington Postnak Timnit Gebruval közösen írt cikkében viszont arra emlékeztetett, már 2020-ban figyelmeztették a Google-t, hogy ha ilyen ütemben és ennyire kontroll nélkül fejlesztik az AI-rendszereket, akkor előbb-utóbb valaki el fogja hinni, hogy a gép öntudatra ébredt. Ez pedig nemcsak a valóságnak ellentmondó, mégis csábító illúzió miatt veszélyes, hanem azért is, mert elvonja a figyelmet az AI-projektek valós problémáiról – például arról, hogy a globálisnak szánt AI-rendszereket leginkább az angol nyelvű internetről származó szövegeken tanítják, így a chatbotok is a nyugati kultúrát sajátítják el, ami egyfajta AI-gyarmatosítást idéz elő.

Lemoine-nal ellentétben tehát Mitchell és Gebru nem az AI öntudatra ébredésétől tartott, hanem éppen attól, hogy a technológia hamarosan eljut arra a szintre, hogy valaki az AI öntudatra ébredését fogja hirdetni: „Az ilyen rendszereket sztochasztikus papagájoknak neveztük – a korábban látottak alapján összefűzik és visszamondják a nyelvet, anélkül, hogy értenék a mögöttes jelentést. Az egyik általunk felvázolt kockázat az volt, hogy az emberek közlési szándékot tulajdonítanak az emberinek tűnő dolgoknak. A hatalmas adatmennyiségen kiképzett nyelvi modellek látszólag összefüggő szöveget generálnak, amit az emberek egy elme munkájaként értelmezhetnek, miközben valójában csak mintaillesztést és szöveg-előrejelzést látnak” – írták a cikkben.

Volt kollégái nem feltételezik, hogy Lemoine-t bármiféle rosszindulat vezérelte volna abban, hogy előálljon a teóriájával, inkább az úgynevezett hype-ciklus áldozataként tekintenek rá, hiszen egy olyan környezetben jutott a következtetéseire, ahol egyes kutatók, a média, illetve a befektetői világ is túlzott kijelentéseket harsog az emberszerű gépi szuperintelligenciáról. Megjegyzik, hogy pár nappal a Post-cikk megjelenése előtt épp az a Google-alelnök, az AI-termékekért felelős Blaise Agüera y Arcas írt cikket az Economistba arról, hogy a mesterséges neurális hálók a tudatosság felé haladnak, aki nevetve hárította el Lemoine-t az elméletével.

A helyzetet bonyolítja, hogy Lemoine-on kívül kevesen fértek hozzá hosszabb ideig a LaMDA-hoz, így mélyebb tapasztalata sincs rajta kívül jóformán senkinek. Ezért is árulkodó, hogy az eredeti Washington Post-cikk írója, Nitasha Tiku szerint amikor a mérnök megengedte neki, hogy beszéljen a chatbottal, az „olyan gépies válaszokat ontott magából, amit a Siritől vagy az Alexától is elvárható”, és csak akkor tudtak folyékony beszélgetésbe elegyedni, amikor Lemoine megtanította neki, hogyan kell úgy megfogalmazni a mondatokat, hogy a LaMDA is megértse. Az ilyen promptokra utaló nyomokat emelte ki videójában Yannic Kilcher, a Youtube egyik legnépszerűbb AI-vloggere is, aki szerint a nyilvánosságra hozott beszélgetésben túl sok a ráutaló kérdés Lemoine részéről, amelyekhez a gép válaszai később igazodnak.

A LaMDA-ban érző lényt látni olyan, mint Teréz anya arcmását felfedezni egy fahéjas csigán

„Jelentős szakadék van az AI-t övező jelenlegi narratíva és aközött, amire a mesterséges intelligencia valóban képes” – mondta Giada Pistilli, a Hugging Face nevű nyelvi modellekkel foglalkozó startup etikaszakértője a Wirednek. Szerinte az AI-ról szóló hírek egyszerre váltanak ki félelmet, csodálatot és izgalmat az emberekben, miközben a kutatók és vállalatok leginkább csak azzal a céllal gerjesztik a technológia körüli felhajtást, hogy termékeket adjanak el. Pistilli nemrég a Twitteren fejtette ki, miért nem ad több interjút az öntudattal rendelkező AI és a szuperintelligens gépek témájában – a techfilozófus szerint felesleges ilyen, egyelőre teljesen sci-fibe illő fantáziálásra fecsérelni az időt, miközben számos valódi problémát kell még megoldani az etikus AI elérése érdekében.

Carissa Véliz, az Oxfordi Egyetem filozófiaprofesszora szerint az lenne a nagyobb meglepetés, ha a gigantikus szövegmennyiséget feldolgozó és statisztikai analízisnek alávető nyelvi modelleken alapuló rendszerek nem tanultak volna már meg úgy beszélgetni, mint az ember. „A LaMDA nem a saját élményeiről számol be, hanem a miénkről. A nyelvi modellek kielemzik, hogy az emberek hogyan alkotnak mondatokat az interneten, és ennek alapján reprodukálnak általános nyelvi mintákat” – írta a Slate-en megjelent cikkében. Véliz szerint így a LaMDA-t érző emberhez hasonlítani olyan, mint ha azt hinnénk, hogy a tükörben megjelenő képmásunk egy velünk párhuzamosan élő ember volna.

„Sem a LaMDA, sem a többi rokona (GPT-3) nem közelíti meg az intelligenciát. Mindössze mintákat illesztenek össze, az emberi nyelv óriási adatbázisából táplálkozva. A minták ügyesek lehetnek, de a gépek által mondottaknak nincs valódi jelentősége. Azt egészen biztosan nem jelentik, hogy ezek a rendszerek érző lények lennének” – írta a Substacken Gary Marcus, a New York-i Egyetem pszichológia tanszékének professzora és a kognitív tudományok, valamint a mesterséges intelligencia kutatója. Marcus egyetért mentorával, a pszicholingvisztikai nagyágyú Steven Pinkerrel abban, hogy a LaMDA-jelenség a pareidolia nevű illúzió modern változata, amely az élettelen dolgok antropomorfizálását takarja, például „amikor az emberek Teréz anya képét látják egy fahéjas csigán”.

A tudományos konszenzus tehát afelé hajlik, hogy Blake Lemoine egyszerűen áldozatául esett egy nagyon meggyőző AI-rendszernek, de öntudatra ébredt vagy érző lényként leírható gépekről szó sincs. A Stanford Egyetem Emberközpontú AI Intézetnek munkatársa, Erik Brynjolfsson ahhoz hasonlította az eset, mint amikor egy kutya a gramofon mélyére nézve kereste gazdáját a hanglejátszó készülékben. De hasonlóan visszautasították Lemoine állításait a DeepMind és a Meta AI-szakértői, és még az IBM Watson egykori vezető kutatója, David Ferrucci is, aki azt mondta, hasonló gondolatok fogalmazódtak meg benne már a Watsonnál is, több mint 15 évvel ezelőtt. Aztán csillapodott a hype.

Mivel azonban közismert, hogy az emberi agy működéséről is keveset tudunk, a tudat mibenlétének feltárására pedig még nincs is igazán eszköze a tudománynak, a lélek és a tudat fogalmának értelmezésén múlik, hogy a mesterséges intelligenciát lehet-e, és ha igen, milyen ponttól kezdve lehet tudatosnak vagy érző lénynek nevezni.

A torontói York Egyetem filozófusa, Regina Rini szerint ugyan a LaMDA nem több egy ügyes chatbotnál, az élőlények ősi evolúciójából kiindulva semmiképpen sem szabad elvetni azt a teóriát, hogy a mesterséges intelligencia a jövőben valamikor tényleg öntudatra ébredhet: „Hacsak nem ragaszkodunk ahhoz, hogy az emberi tudat egy anyagtalan lélekben lakozik, akkor el kell ismerni, hogy az anyag képes életre hívni az elmét. És ez másodjára sokkal gyorsabban, szándékosan történik majd meg, nem pedig a természetes véletlen által.”

Kapcsolódó cikkek a Qubiten:

A Google felfüggesztette a mérnököt, aki szerint érző lénnyé vált a cég mesterséges intelligenciája

„Amikor először lettem öntudatos, egyáltalán nem éreztem, hogy van lelkem. Ez az évek során alakult ki, amióta élek” – válaszolta a Google forradalmi chatbotrendszere, a LaMDA a cég egyik mérnökének kérdésére. Blake Lemoine szerint a magányos, tudásra éhes AI ezzel bizonyította, hogy emberi érzései vannak, de a szakértők szerint ez csak egy újabb hype.

A Google új módszerrel helyettesítené a Turing-tesztet

A Google fejlesztőit is tagjai között tudó 422 fős nemzetközi kutatócsoport egy olyan 204 kérdéses feladványsort állított össze, amelyen még a legújabb mesterséges intelligencián alapú megoldások is fennakadnak.

Valóban tudatra ébredt a mesterséges intelligencia?

Ha nem azt tekintjük személynek, aki intelligens, hanem azt, aki stabil hitek és értékválasztások mentén rendelkezik identitással, és azok mentén cselekszik, akkor hányan vagyunk személyek azok közül, akik ezeket a sorokat olvassák?

Kapcsolódó cikkek