Küszöbön az első deepfake-botrány, a támadók már csak a nagy falatra várnak

Júniusban írtunk először 2018 egyik legnagyobb technológiai szenzációjáról, az eleinte csak celebpornó-hamisításra használt, de akkoriban már lehetséges politikai és hatalmi veszélyei miatt is tárgyalt deepfake-ről, a hónap végére pedig már a szakértők is elkezdtek fogadásokat kötni, hogy még 2018-ban bevetik-e a technikát az online propagandában.

Az elmúlt hónapokban a várakozásnak megfelelően még tovább fejlődött a mesterséges intelligencián és mélytanulási algoritmusokon alapuló videohamisítási technológia, miközben az annak felismerésére és terjedésének meggátlására kifejlesztett módszerek is körvonalazódni látszanak.

Ráadásul nyakunkon az amerikai félidős választások: a kongresszusi és kormányzói helyek alakulása a választások kimenetelétől függően a Trump-kormány bebetonozását vagy szétbomlását is eredményezhetik, ami a kaotikus világpolitikai helyzetre, a populizmus és a szélsőségek további térnyerésére is kihatással lehet, ezért kiemelten nagy figyelmet kap, hogy milyen eszközöket vetnek be az amerikai kampányokban. De beért-e már annyira a deepfake, hogy választásokat döntsön el?

Nagyobb falatra várnak a propagandisták

A Yale Egyetem jogászprofesszora, Rebecca Crootof júniusban arra fogadott a Massachusettsi Műszaki Egyetem (MIT) mesterséges intelligenciával foglalkozó kutatójával, a deepfake-szkeptikus Tim Hwanggal, hogy 2018 végéig lesz egy olyan nemzetközi választási kampány, amelyben szerepet kap egy deepfake-botrány, és a hamisított videót legalább 2 millióan megnézik, mielőtt sikerül bebizonyítani, hogy nem valódi. Bár konkrétan nem mondták ki, ez leginkább a november 6-i amerikai időközikre vonatkozhatott.

Komolyan vehető politikai deepfake-botrány a mai napig nem történt. A Facebook is csak arról számolt be, hogy a 2016-os választás manipulációs technikái köszöntek vissza a mostani kampányokban: több száz oldalt és fiókot szüntettek meg, amiért azok politikai hirdetésnek álcázva gyűlöletkeltő vagy dezinformációs céllal posztoltak vagy egyszerűen manipulatív forgalomtereléssel szabálytalanul próbáltak pénzhez jutni. A gyanú szerint ismét a Kreml házi trolljait összefogó Internet Research Agency nevű csoport állhat az akciók mögött.

A deepfake-propaganda hiányának oka egyszerűnek tűnik: hiába fejlődött már hónapok alatt is óriásit a technológia, a potenciális terjesztői egyelőre kivárnak. „Úgy vélem, hogy azok, akik dezinformációt akarnak terjeszteni, pragmatikusak abban, hogyan lehet legkönnyebben a legnagyobb hatást elérni. És a gépi tanulás egyelőre nem ilyen” – mondta Hwang a TechRepublicnak. Crootof is behódolni látszik: egy újabb tweet szerint 2020-ra tolná ki a fogadást, a szakértők ugyanis azt jósolják, hogy a sokkal nagyobb téttel bíró következő elnökválasztásra tartogatják a minden eddiginél nagyobb kommunikációs krízist ígérő technológiát.

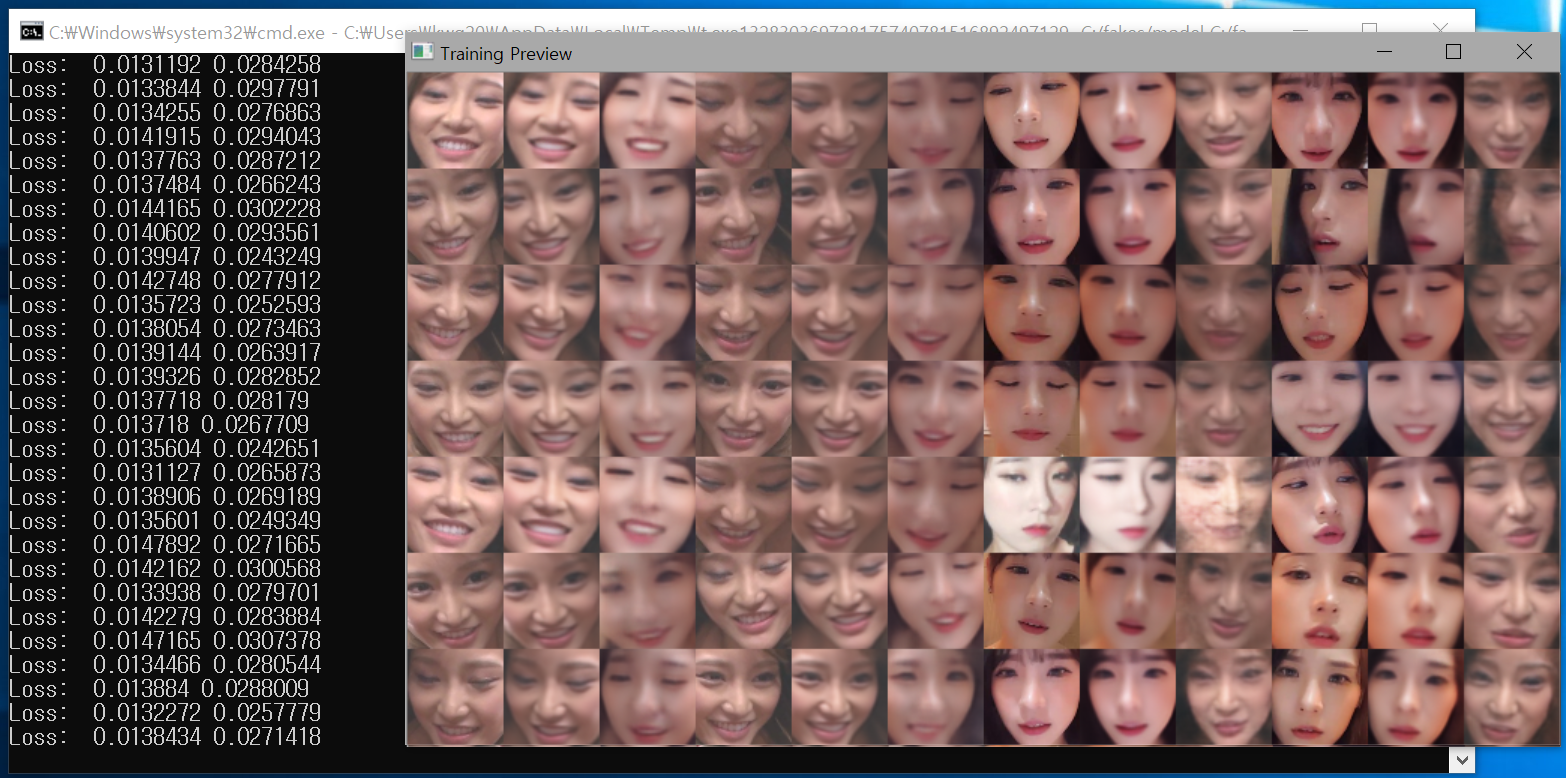

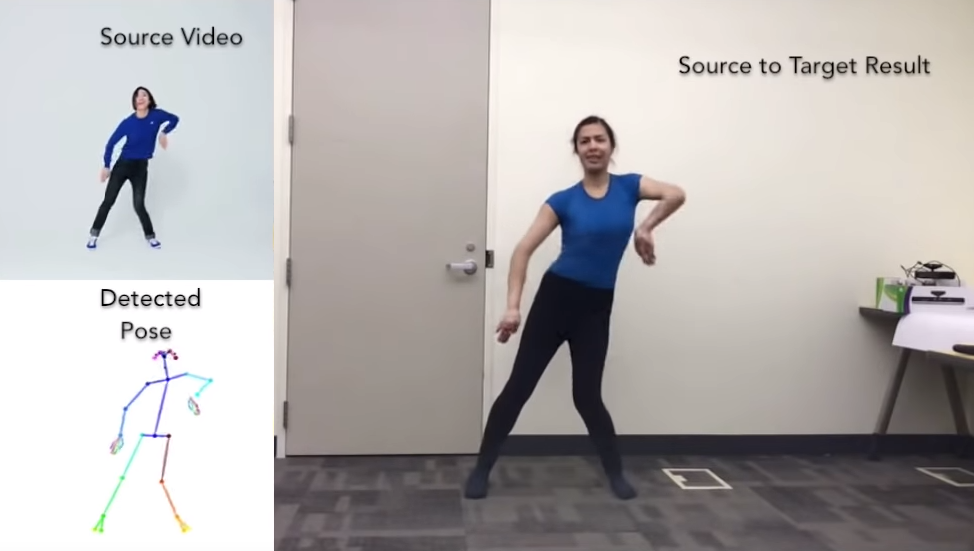

És bár a pornóhamisításhoz használt, bárki által viszonylag könnyen elsajátítható szoftver, a FakeApp határai tényleg végesek (ha szeretnénk látni Nicolas Cage-et Bond-lányként, Elon Muskot pedig a 007-es szerepében, megtehetjük), a lehetőségek már rég adottak egy hatékony deepfake-botrányhoz. A valós idejű videós beszédmanipuláció alapjait már 2016-ban lefektették; A Buzzfeed áprilisban közzétett, eléggé meggyőző Obama-deepfake-jét már több mint ötmillióan látták; a Lyrebird AI már tavaly szeptemberben egy Észak-Koreával kapcsolatos hamis Trump-idézettel promózta hangmanipuláló szoftverét; a generatív ellenséges hálózatok (GAN) pedig már emberi segítség nélkül is képesek komplex mozgásokat átültetni egy videóról egy másikra.

A háttérben zajlik a nagy játszma

A téma mindenesetre a választásoknak köszönhetően újra napirendre került. Csak az elmúlt hetekben a Bloomberg, a Wall Street Journal (WSJ) és az NBC is videóban foglalkozott a deepfake-kel. A hírvideótól átfogó riportig terjedő anyagok sok újdonságot nem ugyan nem tartalmaznak az év eleje óta tudható alapokhoz képest, de a WSJ riportjában azt is elhintik, hogy miért: mivel a komolyabb deepfake-támadások egyelőre a háttérben készülődnek, a védelmi módszereket is fű alatt fejlesztik.

A gépi tanulásnak köszönhetően ugyanis egy gigantikus macska-egér játék zajlik a háttérben: ha a deepfake-készítők rájönnek a hamisított videók felismerésére kifejlesztett módszerekre, akkor csak rá kell ereszteniük egy mélytanulási algoritmust, és a következő videó máris automatikusan kikerüli a csapdákat, aztán lehet a nulláról kezdeni az így egyre okosabbá váló deepfake-ek elhárítását.

Hany Farid, a Dartmouth Egyetem számítógéptudomány-professzora a WSJ-nek azt mondta a deepfake elleni harcáról: „Az a helyzet ezzel a játékkal, hogy én tudom, hogy el fogom veszíteni, de közben nehezebbé, időigényesebbé és bonyolultabbá teszem a folyamatot, és ezzel kiveszem az átlagfelhasználó kezéből a lehetőséget, hogy meggyőző hamisítványt készíthessen”.

Startupperek, jogászok, politikusok, egyesüljetek!

Az amerikai védelmi minisztérium által pénzelt deepfake-vadász programon kívül kisebb kezdeményezések is indultak már a hamisított képek és videók hatékony szűréséért folytatott harcban.

Két startup, az amerikai Truepic és a brit Serelay alkalmazása is egy technológiára épül: egy algoritmus a kép vagy videó készítésének pillanatában lefuttat egy sor ellenőrzést, majd többek közt az eszköz helyadatai, időbélyege, a környező wifi-hálózatok adatai és a felvétel képi tulajdonságai (pl. tükröződés, árnyékok) alapján a fájl metaadataiban kódolja a későbbi hitelesítésre alkalmas információkat. Az akár egyetlen pixelnyi eltérést is érzékelni képes ellenőrző algoritmus persze egyelőre csak magukban az appokban futtatható le, de a deepfake-szakértők bevonásával létrejött startupok célja az, hogy idővel a Facebook, a Snapchat, az Apple vagy a Google saját termékeinek kameraalkalmazásaiban is elérhető legyen egy ilyen hitelesítő funkció.

Szépen lassan pedig a törvényhozókig is elért a deepfake híre. Miután július végén a szenátus hírszerzői bizottságának demokrata alelnöke, Mark Warner a közösségi média és a techcégek szabályozásáról szóló javaslatai között elsőként említette meg hivatalos dokumentumban a jelenséget (mint írta: „várhatóan soha sem tapasztalt mennyiségű hamisított és lejárató tartalmat köszönthetünk”), szeptember közepén szintet lépett az ügy. Egy kétpárti képviselői beadványban arra kérték Dan Coats hírszerzési igazgatót, hogy december közepéig tárja a kongresszus elé annak részleteit, hogy milyen módon próbálták eddig a deepfake technikával támadni az Egyesült Államokat, és hogy mit tesznek ennek megelőzése érdekében.

Kapcsolódó cikkek a Qubiten:

2018: a deepfake éve, a valóság vége

A kép-és videóhamisításra használt deepfake technológia odáig jutott, hogy egyes szakértők már információs apokalipszist emlegetnek. A kamu felvételek elterjedése felrúgja azt alapigazságot, miszerint ha másnak nem, legalább a szemünknek hihetünk. Miközben még nincs igazi megoldás a problémára, a mesterséges intelligencia vadul fejlődik tovább.

A szakértők már fogadásokat kötnek az első deepfake politikai botrányra

A mesterséges intelligencia kutatói szerint előfordulhat, hogy még a 2018-as amerikai időközi választások során kampányfegyverként alkalmazzák majd a deepfake-et, vagyis a mesterséges intelligencia felhasználásával hamisított videókat.

Így csinál bárkiből profi táncost a deepfake

Most már a táncmozgást is képes hamisítani a deepfake, ami egyelőre jó szórakozás, de a komplex mozgás lekövetésével már akár egy fegyveres rablásról készült felvételre is bárkit rá lehet varázsolni.