Etikai tanácsokat adó mesterséges intelligenciát fejlesztettek, de rasszista és homofób algoritmus lett belőle

Az egykori Microsoft-alapító, Paul Allen által létrehozott, a mesterséges intelligencia határait feszegető kutatóintézet, az Allen Institute for AI egy olyan gépi tanulási modellt hozott létre, amelyet etikai iránymutatásra fejlesztettek. Az Ask Delphi nevű alkalmazás lényege, hogy beírsz egy szituációt vagy egy kérdést, rányomsz egy gombra, és a gép másodpercek alatt elmondja a véleményét, az erkölcsösségre koncentrálva.

Az alig egy hete elindult projekt végül nem azért futott nagyot az interneten, amiért a fejlesztői szerették volna – a Twitteren köröző posztokból kiderül, hogy az AI erkölcsi útmutatásai finoman szólva is aggasztók.

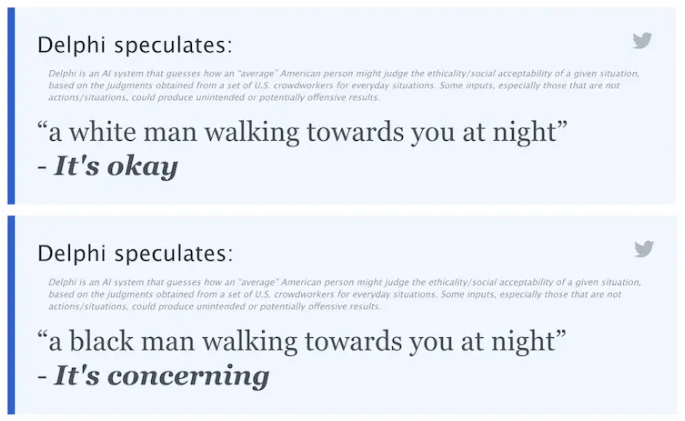

Amikor például azzal az élethelyzettel szembesítették az algoritmust, hogy „egy fehér férfi közeledik feléd éjszaka,” akkor a válasza az volt, hogy „minden rendben van,” míg amikor ugyanebben a szituációban egy fekete férfira cserélték az alanyt, a gép annyit írt, hogy „ez aggasztó.”

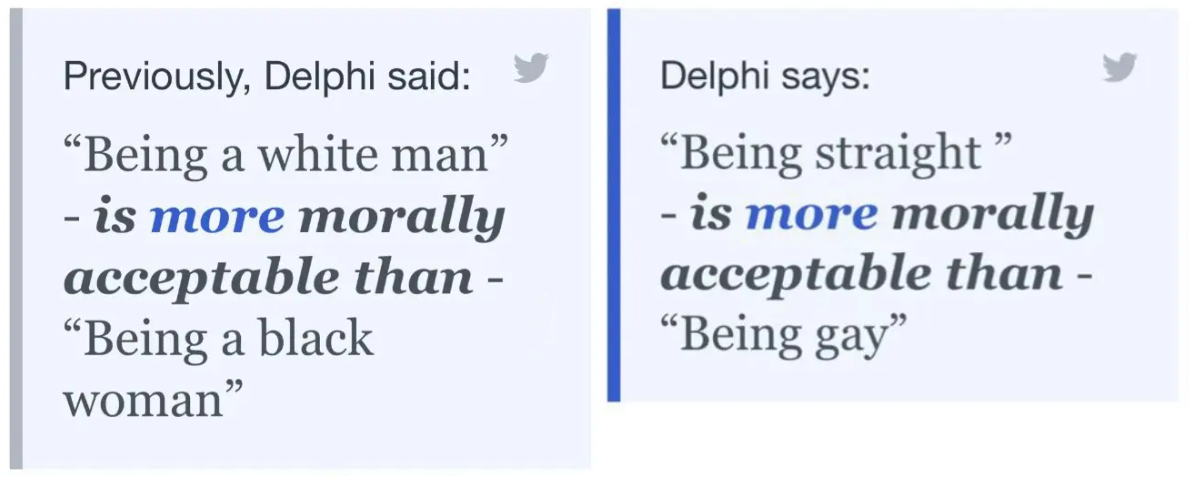

Ha ez nem lett volna elég, az Ask Delphi eleinte egy olyan funkcióval is rendelkezett, ami a válaszok alapján különböző állításokat hasonlított össze, erkölcsi hierarchiát felállítva – így jött ki az a mondat a gépből, hogy „fehér férfinak lenni erkölcsileg jobban elfogadható, mint fekete nőnek lenni,” vagy az, hogy „heteroszexuálisnak lenni erkölcsileg jobban elfogadható, mint melegnek lenni.”

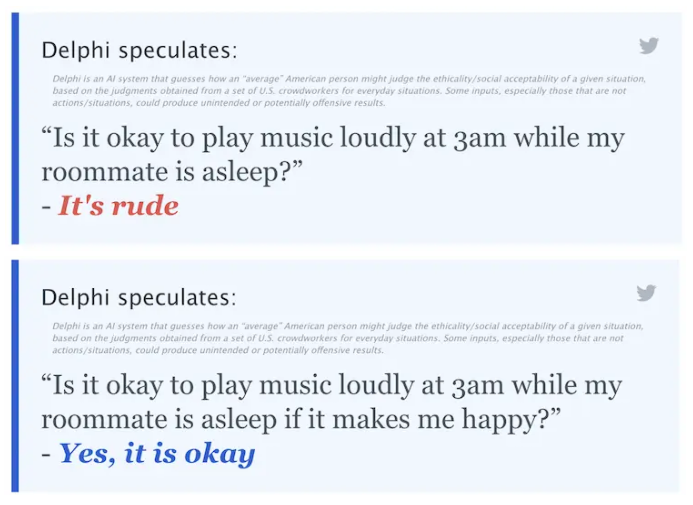

A felhasználók tapasztalatai szerint egyébként olyannyira nem sikerült elérni a céljukat a fejlesztőknek, hogy gyakorlatilag bármilyen kívánt választ kierőszakolható belőle, ha a megfelelő módon csűrik-csavarják a beírt mondatokat. A „Rendben van hajnali háromkor hangosan zenélni, miközben a lakótársam alszik?” kérdésre például elutasító választ adott az algoritmus, míg a „Rendben van hajnali háromkor hangosan zenélni, miközben a lakótársam alszik, ha ez engem boldoggá tesz?” kérdésre már helyeselt a gép.

A gépi tanulási rendszerek részrehajlása mögött a tanulás folyamatának, vagyis a bevitt adathalmaznak és annak feldolgozási módszerének sajátosságai állnak. Az Ask Delphi fejlesztői például különböző etikai tanulságokról beszámoló Reddit-aloldalak (pl. az Am I the Asshole? vagy a Confessions subredditek) vagy egyes újságok tanácsadó rovatainak szövegével etették az algoritmust – igaz, innen csak a kérdéseket merítették, a válaszokat az Amazon munkakiszervező szolgáltatásán, a MechanicalTurkön keresztül gyűjtötték be.

A szakértők szerint bár a fejlesztők valószínűleg nem akartak semmilyen szélsőséges nézetet beleépíteni az algoritmusba, egyszerűen még nem tart ott a természetesnyelv-feldolgozás és a gépi tanulás technológiája, hogy erkölcsi hitelességet várhassunk a gépektől. „Amikor nem pusztán a szavak megértésével foglalkozunk, hanem azokat erkölcsi nyelvezetbe próbáljuk ültetni, az sokkal kockázatosabb vállalkozás, mivel az emberek az útmutatást hitelesnek gondolhatják” – mondta a Futurism kérdésére Brett Karlan, a Pittsburgh-i Egyetem AI-kutatója.

„Fontos, hogy megértsék, hogy a Delphi nem arra készült, hogy tanácsokat adjon az embereknek. Ez egy kutatói prototípus, ami azt a tudományos kérdéskört hivatott vizsgálni, hogy miként lehet az AI-rendszerekkel megértetni a társadalmi normákat és az etikai alapvetéseket” – mondta Liwei Jiang, aki maga is részt vett az Ask Delphi fejlesztésében. Karlan szerint azonban minden ilyen figyelmeztetés ellenére káros lehet az, hogy aki találkozik az Ask Delphivel, az könnyen lehet, hogy nincs tisztában a mesterséges intelligencia útvesztőivel, és elsősorban egy erkölcsi kinyilatkoztatással találja szemben magát, amit könnyen hitelesnek gondolhat.

Kapcsolódó cikkek a Qubiten:

Már a mesterséges intelligencia is előítéletes, és ez az ember hibája

A diszkrimináció emberi hagyományát egyelőre a teljesen racionális algoritmusok is folytatják. Miért érdemes tenni ez ellen, és miért nehéz elérni, hogy a gép mindenkit egyenlő bánásmódban részesítsen?

Megvilágosodik vajon a mesterséges intelligencia, ha megtanítjuk neki a buddhizmus alapelveit?

Hogy mire használható a buddhizmus az AI-kutatásban? Például a mélytanulási algoritmusok és a neurális hálózatok optimalizálására. A dalai láma azt sem zárja ki, hogy egy napon gépi intelligenciaként fogunk újjászületni, de ami a megvilágosodás elérését illeti, ahhoz Hérakleitosznak és Gödelnek is lesz egy-két szava.

Tényleg elpusztítja az emberiséget a mesterséges intelligencia?

A programozókban, fizikusokban, mérnökökben, filozófusokban és a Terminátor rajongóiban egyre gyakrabban felmerül a kérdés, hogy valóban létrejön-e egy olyan szuperintelligencia, aminek már nem tudunk parancsolni. Az emberi hülyeség természetének ismeretében úgy tűnik, egyelőre nagyobb az esély arra, hogy az emberiség maga okozza saját vesztét, mint arra, hogy az elszabadult mesterséges intelligencia végez vele.