Magyarul gondolkodni

A tudomány nem pusztán információfeldolgozás, és nem mindegy, hogy milyen nyelven művelik. Ez a mesterséges intelligencia, a nagy nyelvi modellek korában fontosabb, mint valaha.

A tudomány nem pusztán információfeldolgozás, és nem mindegy, hogy milyen nyelven művelik. Ez a mesterséges intelligencia, a nagy nyelvi modellek korában fontosabb, mint valaha.

Jobb, ha nem támaszkodunk rájuk, ha egészségügyi kérdésekben kell döntést hoznunk.

Egyre több AI a kutatásban, személyre szabott génterápiák, rákteszt a vérből, Hold-és Mars küldetések, a tengermély vizsgálata, még profibb részecskegyorsítás, és persze Donald Trump.

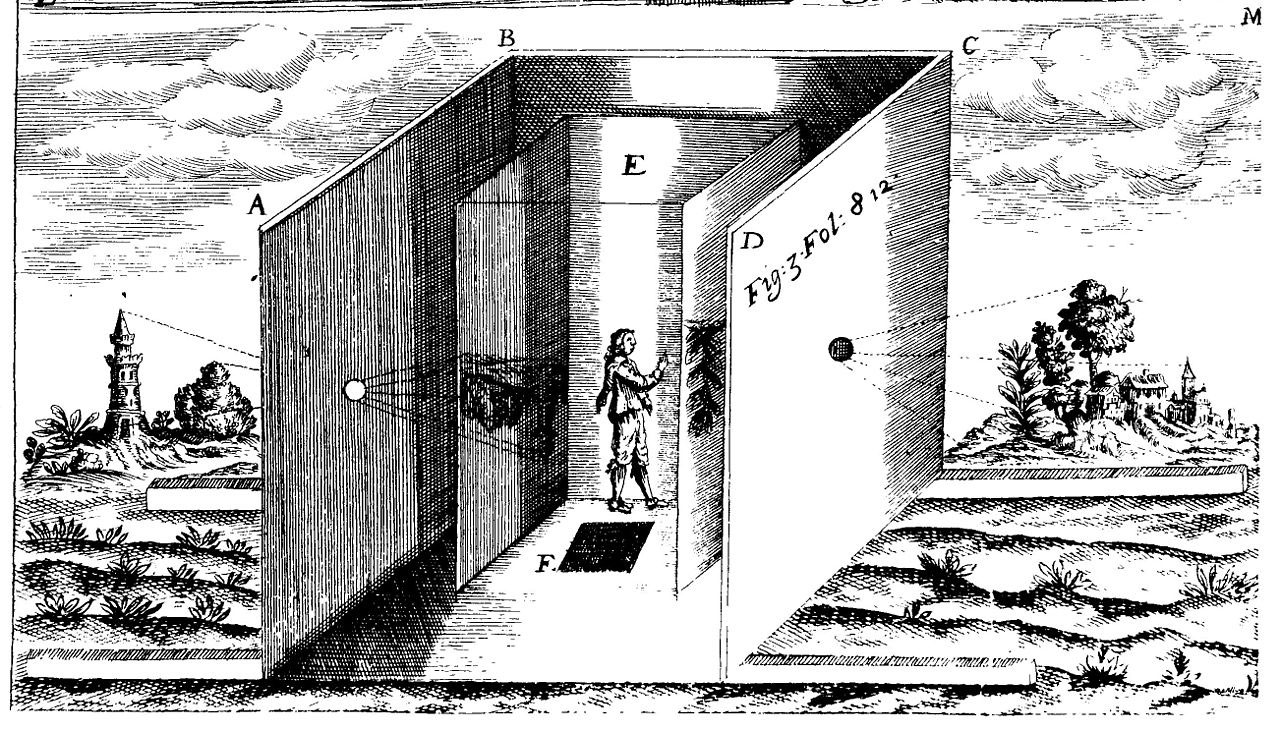

Az OpenAI új modellje, a GPT–5.2 a legmodernebb Turing-teszten 18-ról 53 százalékra javította az eredményét, és a 44 vizsgált munkakör közel háromnegyedében legalább olyan jól helytáll, mint egy humán szakértő.

A kutatók jutalmazó módszerrel tanították a GPT-5-öt, hogy megértsék, milyen gondolatmenetek alapján „hazudik”. Az AI egészen elképesztő technikákhoz folyamodott.

Az elődjénél nagyságrendekkel több számítási kapacitást biztosító szerver digitális bölcsészeti, történeti és kulturális örökséghez kapcsolódó projekteket, valamint AI-kutatásokat fog támogatni.

Az Anthropic a könyveket és cikkeket a LibGen-ről és hasonló oldalakról töltötte le, de most a maga nemében egyedülálló megállapodást kötött a szerzőkkel.

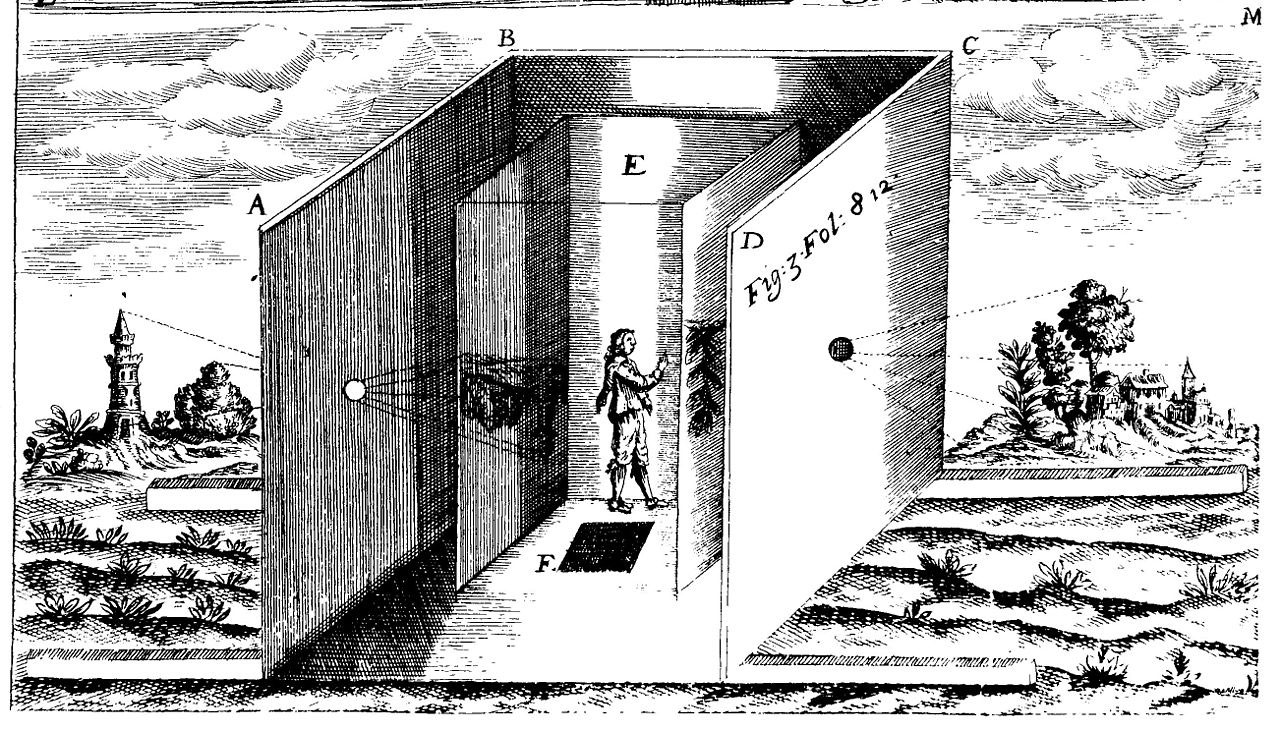

Az alkalmazott nyelvész a 12. Qubit Live-on elmondta: a chatbotok által használt modellek a nyelv lenyomatai számokban és valószínűségekben. Egy saját modellhez rengeteg pénzre és emberre van szükség, de a ChatPuli már üzemel – Ligeti-Nagy előadása már videó és podcast formájában is elérhető.

Az OpenAI a szülők értesítésével tervezi csökkenteni az öngyilkossági kísérletek lehetőségét a tinédzserek körében, azonban az új biztonsági funkció használata adatvédelmi dilemmákat is felvet.

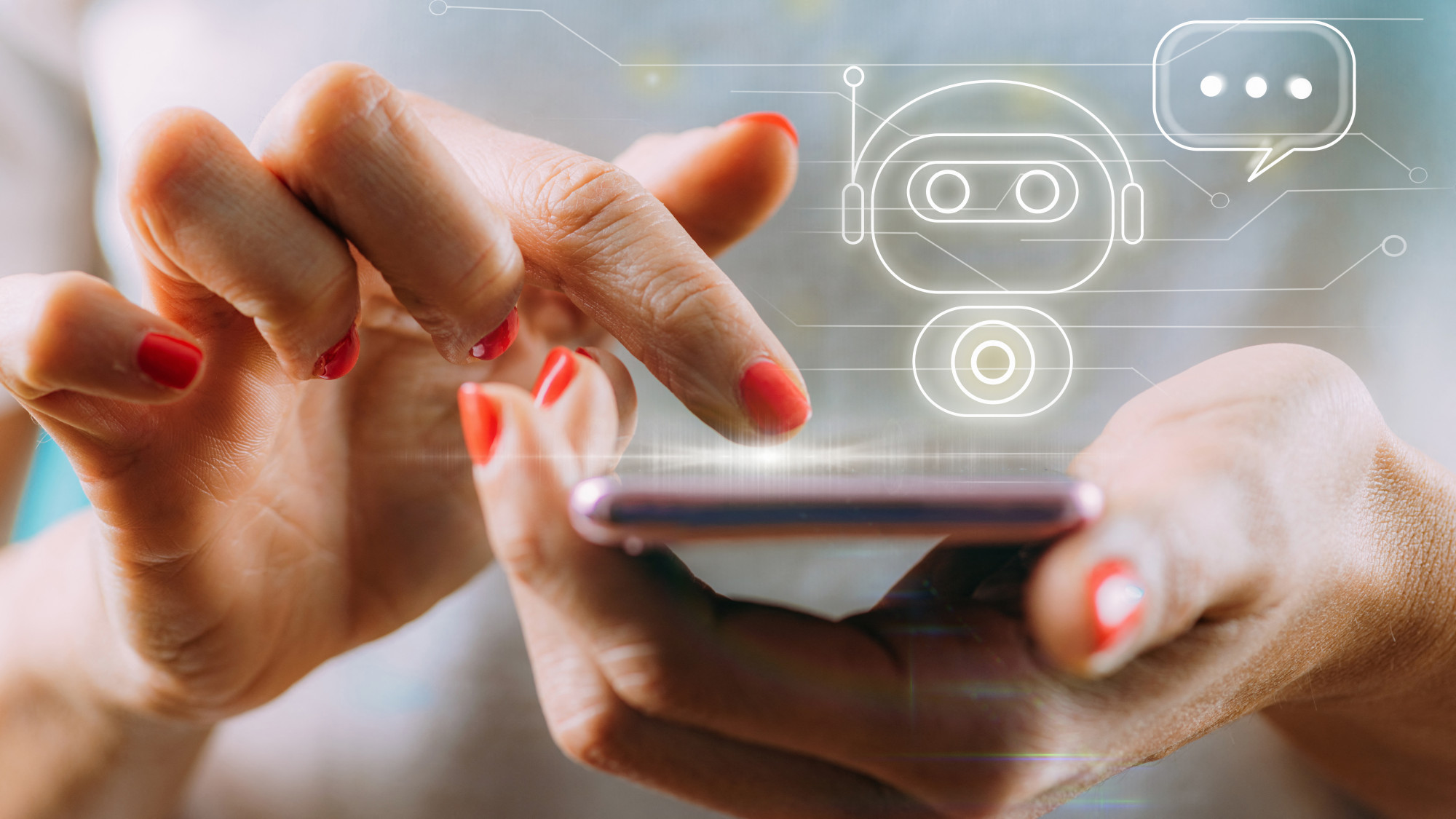

Az R1 nevű érvelő modell több feladatban felülmúlta a hagyományos, emberi iránymutatással képzett modelleket, és 86,7 százalékos eredményt ért el az egyik legnehezebb középiskolai matekversenyen.

Az ember által megadott cél eléréséért dolgozó AI-ágensek fontos lépést jelentenek a mesterséges általános intelligencia (AGI) felé, de rengeteg a kockázat – mondja Gyevnár Bálint, az Edinburgh-i Egyetem kutatója.

Adakozóbb a mesterséges intelligencia, ha ember helyett egy másik mesterséges intelligencián kell segítenie. Viselkedéskutatási kísérletnek vetettek alá nagy nyelvi modelleket.

Már legalább 300 esetben derült ki, hogy ügyvédek és bírók mesterségesen generáltak szövegeket beadványokban és ítéletekben, nem létező ügyekre és idézetekre hivatkozva – legutóbb egy emberölési ügy tárgyalásán.

Csakhogy az is kérdés, létezik-e egyáltalán olyasmi, hogy anyai ösztön.

Sam Altman szerint a GPT–3 olyan volt, mint egy középiskolás, a GPT–4 mint egy egyetemista, a ChatGPT-t hajtó legújabb AI-modell viszont már minden témában PhD-szintű szakértelmet nyújt. Egyes szakértők viszont úgy vélik, kipukkadt a GPT-lufi.