„A mesterséges intelligencia arra jó, hogy az emberek okosabban tudják elmondani a butaságaikat”

– Nem a mesterséges intelligencia a legnagyobb félelmem, hanem az, hogy az emberek mire fogják majd használni. Az amerikai OpenAI cégnél a ChatGPT kifejlesztése több mint 100 millió dollárba került. Amikor már elkészült, utána már nem volt olyan bonyolult egy ChatGPT-szintű eszközt reprodukálni. A Stanford Egyetem el is készítette, majd feltette az internetre a szoftvert. Ennek az áttanítása bármire, amire ezt valaki szeretné, a becslések szerint már csak 600 dollárba kerül. Ezzel hackerek és más rosszindulatú emberek óriási eszközt kapnak a kezükbe – mondta Lőrincz András mesterséges intelligencia kutató, az ELTE Informatikai Kar Mesterséges Intelligencia Tanszékének tudományos munkatársa a CEU Határtalan tudás sorozatának szerda esti évadzáró eseményén, amely azt a témát boncolgatta, hogy kell-e félnünk a mesterséges intelligenciától.

Hozzátette, egy barátja szerint az egyetem arra jó, hogy az emberek a butaságaikat okosabban tudják elmondani, és szerinte a mesterséges intelligencia is ebben fog segíteni.

Lőrincz András mellett Karsai Márton, a CEU Hálózattudományi Tanszékének docense, Gácsi Márta etológus, az ELKH–ELTE Összehasonlító Etológiai Kutatócsoportjának tudományos főmunkatársa és Ujhelyi Adrienn, az ELTE PPK Szociálpszichológiai Karának docense beszélgettek arról, hogy ha a mesterséges intelligencia (MI) már a világ legjobb sakkozója, GO-játékosa és vadászrepülőgép-pilótája, akkor kinek és hogyan veheti el a munkáját, elképzelhető-e, hogy az emberek lecserélhetők a gépekre. Kordában tudjuk-e tartani vagy le tudjuk-e lassítani azt a folyamatot, ami zajlik, ahogy számos techvezető kérte ezt az utóbbi időszakban? Vagy gondolhatjuk-e azt, hogy mint a negyedik ipari forradalom eszköze, akár előnyünkre is válhat az MI, ha megfelelően használjuk?

Honnan ez a páni félelem?

A pszichológia oldaláról közelítve Ujhelyi inkább azt a kérdést tette fel, vajon a mesterséges intelligenciára miért mindig a félelem az első reakció. „Ez csak ugyanaz, mint ami minden technológiai újítást jellemez vagy van most valami speciális? Azt érezzük, hogy a gépek a leginherensebben emberit veszélyeztetik és azt veszik el épp tőlünk?” – kérdezte.

Szerinte más megközelítésekből is lehet vizsgálni az MI és az ember kapcsolatát, a technocentrikus nézet azt vallja, hogy a gép túlnő az emberi intelligencián, egy másik azt, hogy az emberben vannak tulajdonságok, amelyeket a gép sosem helyettesíthet, ő viszont egy harmadik, konstruktív megközelítést javasol. Ujhelyi szerint arra kellene koncentrálni, hogy együttműködésben gondolkodjunk és abban, hogyan lehetne olyan MI-t létrehozni, ami jól működik együtt az emberrel.

Az, pedig, hogy érzelmeket tulajdonítunk az MI-nek és antropomorfizáljuk, abból indul ki, hogy az emberek a gépeknek is hajlamosak motivációkat, érzelmeket, szándékokat tulajdonítani. Például Ujhelyi szerint egy kutatás kimutatta, hogy az emberek jobban szeretik, ha a GPS férfihangon szól hozzájuk, míg az Amazon Alexa, a Google Assistant és más hangasszisztensektől inkább a női hangot preferálják.

A szociálpszichológus szerint pedig amikor arról van szó, hogy empátiát és kreativitást tulajdonítunk a mesterséges intelligenciának, vajon mennyit látunk ebbe bele mi emberek. „Ha arról van szó, hogy az MI nyer egy művészeti versenyt, az nem a mi szemünkben látszik csak mélynek és kreatívnak?” – vetette fel Ujhelyi.

A beszédét felturbózták, de még nem tud viselkedni

Gácsi szerint, aki etorobotikával foglalkozik, vagyis azzal, hogyan lehet olyan robotokat létrehozni, amelyekre élőlényként tekint egy igazi élőlény, például egy kutya, és szociális viselkedéseket képes mutatni felé, nagy kérdés, mennyire forradalmasíthatja a robotikát a ChatGPT megjelenése – hiszen a Boston Dynamics egyik robotkutyájába már be is építették. Sőt, ha például ezt a nyelvi szoftvert döntéshozatalra is használják egy segítőrobotban, akkor ezek a döntések hogyan ítélhetőek meg, és mennyire lesznek biztonságosak technikai vagy etikai szempontból.

Az etológus azt mondta, egyelőre a robotika viselkedéses oldala elmarad attól, ami a nyelvi oldalon történik. Egyelőre a segítőrobotokat például nem lehetne idősotthonokban vagy kórházakban alkalmazni, mert ezek egyrészt sokba kerülnek, másrészt a segítő személyzetet nem váltanák ki, irányításukhoz még plusz ember kellene, a lakók pedig nem tudnak kapcsolódni hozzájuk, rosszabb esetben a betegek félnek tőlük.

„Hiába építjük be a ChatGPT-t a robotba, nem elég, hogy a beszéd emberszerű kommunikációt ígér, ha ami közben történik, az viselkedéses szempontból egy nagyon buta darab vas” – fogalmazta meg. Az empátiára és olyan tulajdonságokra reagálva, amelyeket embereknek tulajdonítunk, Gácsi azt mondta, nehéz ezeket megfogalmazni, hiszen a bűntudat vagy az empátia megléte még a kutyáknál is kérdéses, mit tudnánk akkor mondani a gépekről?

Kőbalta, kerék vagy mozdony-e?

Lőrincz az MI fejlesztői oldaláról nézte meg a kérdést, és először azt mutatta meg, mit is jelent a mesterséges intelligencia. Az óriási riadalmat keltő és napok alatt 100 millió felhasználót begyűjtő ChatGPT alapját képező nagy nyelvi modellek (large language model - LLM) működésének módszerét adó mesterséges neurális hálókról (artificial neural networks - ANN) elmondta, ezekben kis számítási egységek különböző erősségű súlyokkal vannak összekapcsolva, ezeket “tekergetik” a fejlesztők. Egy adott bemenet esetén a neurális hálótól elvárnak egy adott kimenetet, és addig változtatgatják a súlyozást, amíg a rendszer ki nem köpi a megfelelő választ, azt azonban senki sem tudja, mi történik a neurális hálók rejtett rétegeiben, és hogyan jut el végül az ANN az adott kimenethez.

Emiatt fordulhat elő az is, hogy a hatalmas adatbázisokban – a ChatGPT-t is sok-sok százmilliárd bemeneti adattal tanították – rejtett összefüggéseket találhat a gép, ezek alapján pedig olyan predikciókat tehet, amelynek alapját az ember nem értheti. „Mint amikor egy vaknak azt mondják, piros az ég alja, alighanem szél lesz. Majd a szelet megtapasztalja, de a piros eget sosem. Így érzékeljük mi is a mesterséges intelligenciát” – mondta az MI-kutató.

Azt is hozzátette, hogy hasonlíthatjuk a kőbaltához, a kerékhez, a mozdonyhoz, a szövőgéphez, a számítógéphez vagy az internethez az MI-t, mert ezek mind olyan eszközök, amelyek az egyik oldalon munkanélküliséget eredményeztek, míg a másik oldalon meg kellett tanulni egy új szakmát. Például a mozdony megjelenése a patkolókovácsokat szorította háttérbe, de eközben meg kellett tanulni mozdonyt vezetni. A nagy probléma Lőrincz szerint az MI esetén az, hogy most nincs hova fejlődni, mert a gép okosabbá kezd válni, mint mi.

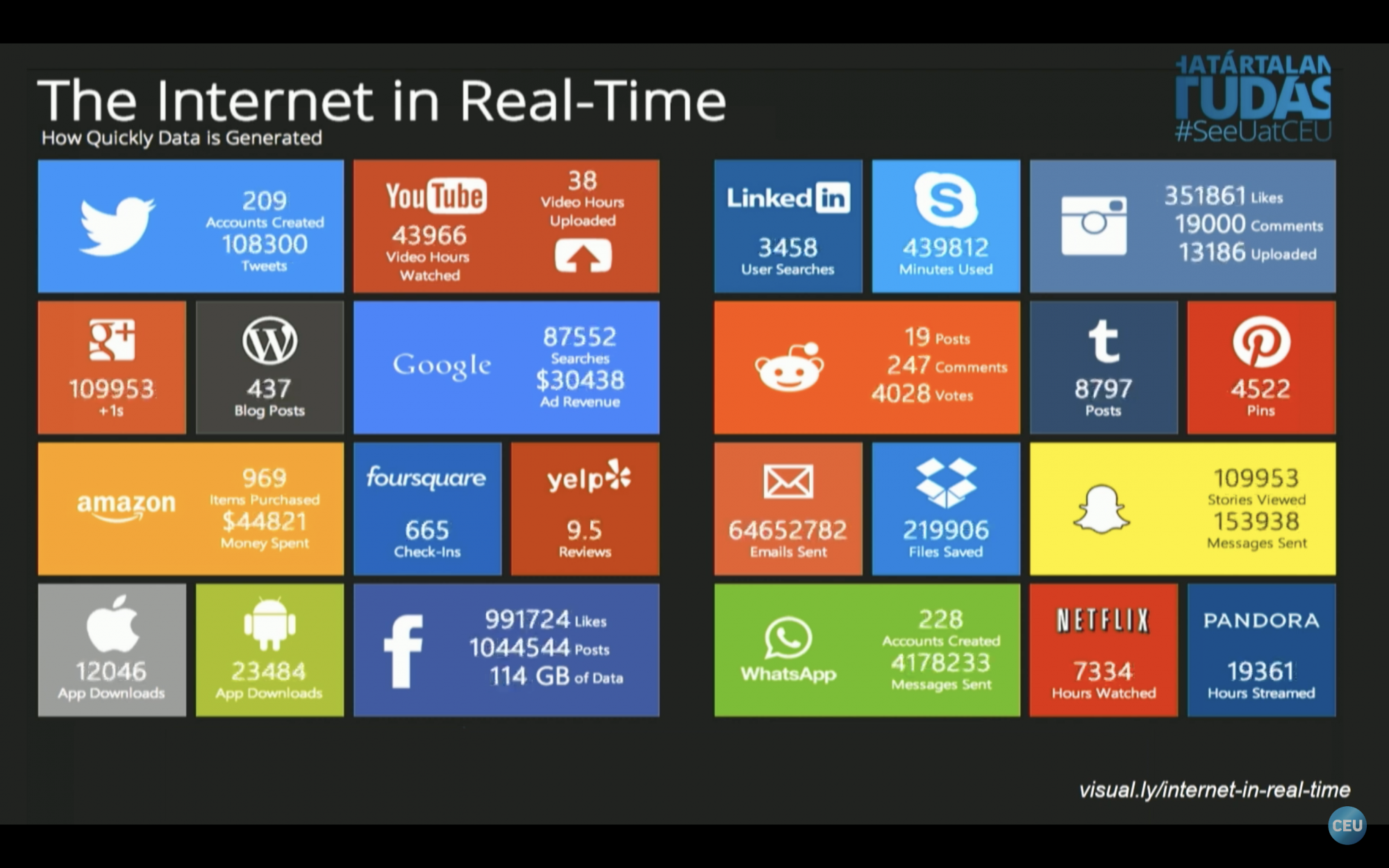

Az emberiség 1,2 évente annyi adatot termel, mint korábbi története során összesen

Karsai a szoftverek betanításához szükséges adatok oldaláról közelítette meg a kérdést. Elmondta, ez az első korszak, amikor hatalmas mennyiségben gyűlnek össze adatok az emberekről, ezek pedig egyfelől kényelmes szolgáltatásoknak ágyaznak meg, másfelől viszont jó pár problémát és veszélyt rejtenek magukban, amelyekre nekünk kell megtalálni a választ.

Az adattudomány kutatásai szerint ugyanis a technológiai fejlődésből ismert Moore-törvényhez hasonlóan minden 1,2 év alatt annyi adatot termel az emberiség, mint amennyit korábbi története során összesen.

Ezek rengetegféle AI-rendszert táplálnak, amelyek szinte észrevétlenül kényelmessé teszik a mindennapjainkat – termékeket ajánlanak, zenét ismernek fel, felismerik az arcokat, személyre szabott navigációs rendszereket tartanak fenn vagy önvezető autókat működtetnek.

Ugyanakkor Karsai szerint olyan veszélyekkel járnak, mint a deepfake-videók és generált fotók fémjelezte hamis tartalomgyártás, az igazságtalan és diszkriminatív algoritmusokon alapuló, átláthatatlan döntési rendszerek vagy az adatok kombinálásának veszélyei. Egy nézői kérdésre válaszolva azt mondta, igazán fontos kérdésekben nem hagyatkozhatunk az MI-re, ez pedig óriási korlátja a területnek. Például nem dönthet abban, kapjon-e tüdőt egy beteg vagy sem, és önvezető autóknál, hogy elüsse-e az elé kerülő embert vagy ne. Hozzátette, hogy az már ma is igaz, hogy kevesebb balesetet okoz, mint egy ember, viszont kérdés, hogy mikor töri át azt a gátat, hogy elfogadjuk a korlátait, és azt, hogy a mesterséges intelligencia is hibázhat.

Az előadás itt tekinthető meg:

A CEU médiapartnere a Qubit.

(A beszélgetés élő közvetítése 20-25 percre megszakadt, az abban az időben elhangzottakról így sajnos nem tudunk beszámolni.)

Kapcsolódó cikkek a Qubiten:

Hát persze, hogy valaki már be is építette a ChatGPT-t a Boston Dynamics robotkutyájába

Az elmúlt évek legnagyobb technológiai szenzációit már együtt is lehet használni: a jó esetben csak ipari munkát végző robotkutyák innentől szóbeli utasításokat is végrehajtanak, és válaszolnak a kérdéseinkre.

Ontják magukból a fake newst a ChatGPT-t használó hírfarmok egy amerikai felmérés szerint

A NewsGuard dezinformáció ellen küzdő és híroldalak értékelésével foglalkozó szervezet 49 olyan új weboldalt talált áprilisban, ami AI chatbotok által generált tartalommal híroldalként állítja be magát a neten.

Elképzelhető, hogy a mesterséges intelligencia embert öl?

Egy magyar producer addig faggatta az ártatlan ChatGPT-t a robotika három törvényéről és a villamosdilemmáról, míg az kimondta, hogy az emberiség megmentése érdekében a gyilkosság is elfogadott lehet, a ChaosGPT formájában pedig már a destruktív, hataloméhes, manipulatív AI is megjelent.