Itt a GPT-4, ami már nemcsak szövegeket, hanem képeket is tud értelmezni

Nem revolúció, csak evolúció – így foglalhatók össze az első benyomások az OpenAI legújabb nyelvi modelljéről, a kedd este bemutatott GPT-4-ről. Még a mesterséges intelligenciával foglalkozó cég vezetője, Sam Altman is azt nyilatkozta, hogy az évek óta várt GPT-4 a nagy hype miatt valószínűleg csalódást okoz majd, ami tehát nem forradalmi újítás, de mindenképpen fontos lépcsőfok a generatív AI történetében.

Közel három éve annak, hogy az egykor nonprofitként működő, de ma már kis híján a Microsoft leányvállalataként szolgáló OpenAI megjelentette a GPT-3 nevű nagy nyelvi modelljét, amely ugyan chatelni még nem tudott, de már nagyjából hozta azt, ami a tavaly év végén ledobott ChatGPT varázsát adja. Egyszerű utasításra verset, esszét, kódot írt, utazási tippeket vagy életvezetési tanácsokat adott, és megtévesztően emberi szöveget generált.

Mindez a ChatGPT érkeztével sokkal interaktívabbá és gördülékenyebbé vált, ráadásul a chatbot már a 2020-ban kiadott GPT-3 finomított változatán, a GPT-3.5 modellen alapszik. A most bemutatott GPT-4 legnagyobb újdonsága az elődjeihez képest, hogy míg azok csak szöveget tudtak kezelni, az új változat úgynevezett multimodális modell, vagyis a szövegek mellett képekkel is dolgozik. Ez egyelőre csak a bemeneti oldalon igaz: egy feltöltött képet körbe tud írni, de szövegből még nem tud képet generálni.

Hogy ebben milyen lehetőségek rejlenek, azt még az OpenAI fejlesztői is csak találgatják, de a New York Times példáján keresztül jól látszik, hogyan javítja a képes funkció az alig négy hónapos ChatGPT már így is körberajongott képességeit: már nem kell egyesével beírogatni, hogy milyen hozzávalók vannak otthon, ha recepthez kérünk tanácsot, elég lefotózni a hűtő tartalmát, és a GPT-4 először azonosítja a képen látható élelmiszereket, majd több lehetséges receptet is ajánl belőlük.

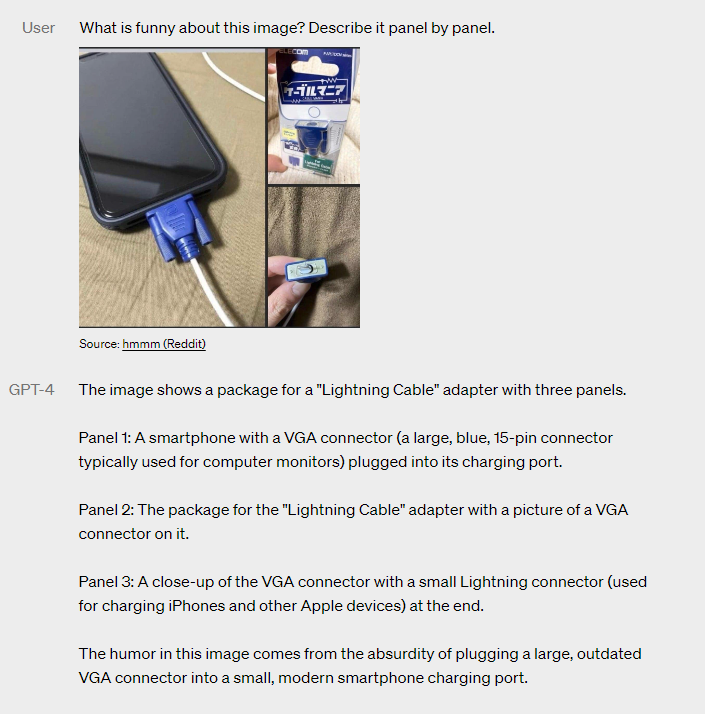

A kutatási ismertető szerint emellett grafikonok tartalmát is képes szövegesen összefoglalni, és már vizuális poénokról vagy mémekről is el tudja magyarázni, hogy azok miért viccesek. Alább például egy három panelből álló kép látható, amit mindenféle kontextus nélkül töltöttek fel a Redditre, a GPT-4 viszont kérésre szépen levezette, hogy mi benne a poén: a VGA kábelnek álcázott iPhone-töltő az ósdi és a modern technika keresztezése.

Javult a memóriája, és a teszteken is jobban teljesít

A GPT-4 másik legnagyobb, vagy legalábbis legobjektívebben mérhető újítása (mert hát azt nehezen lehet megállapítani, hogy mennyire lett kreatívabb vagy pontosabb) az, hogy jelentősen javult a rövid távú memóriája, vagyis sokkal hosszabb beszélgetések kontextusát tudja megjegyezni, így akár komolyabb tanulmányokat vagy novellákat is képes egyben értelmezni, míg korábban ezeket szakaszonként kellett a ChatGPT-nek beadagolni, így nem tudta átlátni a teljes szövegkörnyezetet.

Ez számszerűsítve annyit tesz, hogy míg a GPT-3.5 nagyjából 3000 szavas kérdés-válasz egységeket tud kezelni, a GPT-4 emlékezete már akár 25 ezer szóra is kiterjedhet. Ezek csak hozzávetőleges számok, mivel az AI-rendszerek nem szavakat kezelnek, hanem tokeneket, és a kettő közötti átváltás igencsak bonyolult (egy token átlagosan nagyjából 4 karakterre vagy háromnegyed szóra jön ki), de a lényeg, hogy 4000-ről 32 ezerre nőtt az egy beszélgetésben kezelt tokenek száma.

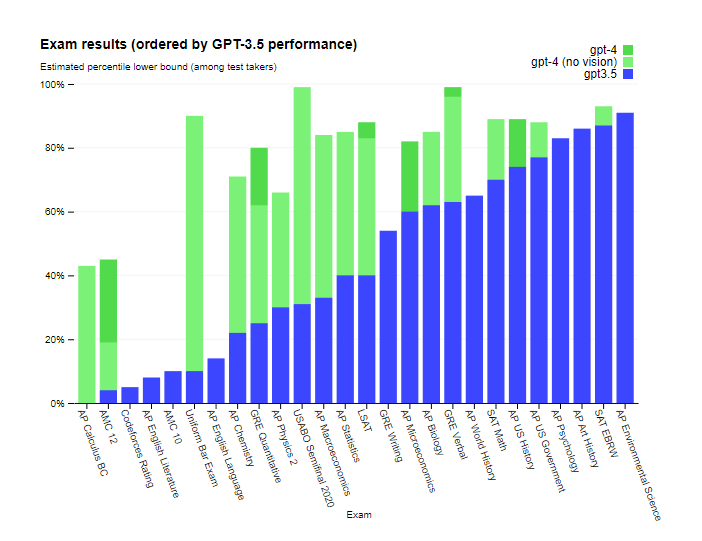

A szövegek értelmezésére képes algoritmusok egyik visszatérő mércéje, hogy milyen jól teljesítenek különböző iskolai vizsgákon. Még a ChatGPT előtti időkben, 2022 januárjában dicsekedett el azzal a DeepMind, hogy Gopher nevű modellje már egy középiskolás szintjén teljesít szövegértésben, de az algoritmus akkor a reáltárgyakkal még nagyon küszködött. Az alábbi grafikonon jól látszik, hogy a GPT-4 már közvetlen elődjéhez képest is sokat javult ezekben: középiskolai emelt statisztikában például az emberek 85 százalékánál jobban teljesített (a GPT-3.5 csak a 40 százalékuknál), de makroökonómiában, fizikában vagy kémiában is látványos javulást ért el, és már a kalkulus is szépen megy neki.

Az orvosok után az ügyvédekre is jól ráijesztett az OpenAI: miután a ChatGPT-ről januárban kiderült, hogy külön felkészítés nélkül is le tudja tenni az orvosi szakvizsgát, most a GPT-4 mutatta meg, hogy az emberi vizsgázók 90 százalékánál jobb eredményt képes elérni a jogi szakvizsgán – a GPT-3.5 még csak az emberek 10 százalékát előzte meg.

Továbbra is hallucinál

Bár a korábbi modellekről szinte mindent megosztott az eredetileg a nyílt forráskódú mesterséges intelligenciát hirdető OpenAI (innen tudtuk például, hogy a GPT-3 azért is jobb a GPT-2-nél, mert 1,5 milliárd helyett 175 milliárd paraméteren tanították be), a technikai részletek megosztása most elmaradt – a cég szerint azért, mert mára túl nagy lett a verseny az AI területén. Így be kell érnünk az olyan hangzatos közleményekkel, miszerint „a GPT-4 a GPT-3.5-nél 82 százalékkal kisebb valószínűséggel válaszol kérdésekre olyan témákban, amiket az OpenAI nem enged, valamint 60 százalékkal kisebb valószínűséggel ad fiktív válaszokat”.

Ezzel együtt az OpenAI sem titkolja, hogy még mindig ki lehet játszani a rendszer beépített biztosítékait, és elődjeihez hasonlóan a GPT-4 is hallucinál – így nevezik azt, amikor teljesen fiktív, kitalált dolgokról ír, ahogy azt az elmúlt hetekben terjedő posztokban is lehetett látni, amikben emberek a saját életrajzukat íratták le a ChatGPT-vel. De az alábbi beszélgetés is jól példázza, mekkorákat tud hallucinálni az AI: az első kérdésre még teljesen jó választ ad, de aztán valahogy belekeveri az egyébként 2017-ben alapított Qubit történelmébe az Indexet és olyan sajtómunkásokat, akiknek sosem volt közük lapunkhoz.

A bejelentést kísérő tanulmányban azt is írják, hogy a GPT-4 és a jövőbeni modellek „képesek jelentősen befolyásolni a társadalmat, mind jótékony, mind pedig káros módon”, ezért külső szakértőkkel együtt igyekeznek felismerni, elkerülni, illetve elhárítani a veszélyeket. Még egy olyan mondatot is elrejtettek a szövegben, hogy „a GPT-4 és más AI-rendszerek lehetséges társadalmi és gazdasági hatásaival kapcsolatos további gondolatainkat hamarosan megosztjuk”.

Ez azért is érdekes, mert az utóbbi időben mintha egy kisebb törésvonal alakulna az OpenAI és a Microsoft között: miközben Sam Altman a mesterséges intelligencia szabályozását sürgeti (nem mintha a törvényhozók egy mukkot is értenének abból, mi folyik az AI területén), addig a Microsoft feloszlatta a teljes AI-etikai részlegét, Satya Nadella vezérigazgató pedig agresszívan követeli, hogy a legújabb algoritmusok egyből kerüljenek a felhasználók elé, a biztonsággal látszólag nem törődve.

Hol találom, és mire lehet már használni?

Az első kérdésre könnyebb a válasz: a GPT-4-et egyelőre a fizetős (havi 20 dollár + áfa) ChatGPT Plusba építették bele, és mint kiderült, a Bing chatbotja is az új modellen fut már hetek óta. Akik pedig saját terméket építenének rá, azoknak fel kell iratkozniuk a GPT-4 API várólistára.

De az OpenAI már a bejelentés előtt együttműködött különböző ügyfelekkel, akik így egyszerre voltak kénytelenek bemutatni a GPT-4-re alapuló új szolgáltatásaikat.

- A Duolingo Max chatbotjával könnyen rá lehet jönni a nyelvtanulás közben vétett hibákra, valamint szerepjátékos helyzetekben is tesztelni lehet vele a nyelvtudást.

- A Stripe nevű fizetési technológiai startup (amelynek egyébként Sam Altman is jelentős befektetője) a szoftverfejlesztéstől a felhasználói felületekig mindenhova integrálja a modellt, hogy a dokumentumok böngészését kiváltsa az egyszerű szöveges keresés.

- A Be My Eyes nevű app eddig úgy működött, hogy a vak vagy látássérült felhasználók bekapcsolták a telefonjuk kameráját, és az adott pillanatban online tartózkodó ép látású felhasználók segíthettek nekik tájékozódni és eligazodni – vagyis elmagyarázták, hogy mit látnak. A humán segítőket már a GPT-4 is helyettesítheti.

- A Khan Academy kettős szerepben alkalmazza az AI-modellt: a diákoknak virtuális tanítói, a tanároknak asszisztensi szerepben lesz elérhető a tananyag megértését segítő chatbot.

- Izland kormánya az izlandi nyelv fennmaradásáért küzd, és ebben nagy segítség lehet az, ha az előzetesen tökéletesített izlandi nyelvtudással felvértezett GPT-4-re épülő appok és chatbotok ott vannak a helyiek okostelefonjain.

- De van, aki arra használta a modellt, hogy a nulláról megírja a Pong nevű egyszerű videójáték kódját – ehhez mindössze egyetlen percre volt szüksége a GPT-4-nek.

Kapcsolódó cikkek a Qubiten:

Innováció és horror: a cég, ami a szemünk előtt forgatja fel a világot

Az Elon Musk közreműködésével alapított OpenAI az elmúlt fél évben két forradalmi technológiával is előállt (DALL-E 2, ChatGPT), a Microsoft pedig épp most tolt bele 10 milliárd dollárt. Bemutatjuk napjaink legizgalmasabb techcégét és vezetőjét, Sam Altmant.

A ChatGPT betette a lábát a magyar egyetemekre, már csak az a kérdés, hogy mihez kezdenek vele

Van olyan magyar egyetem, ahol a ChatGPT már vizsgázott is, máshol a diákok még csak nem is hallottak róla, de tény, hogy az MI megjelent a felsőoktatásban, úgyhogy ideje kitalálni az alkalmazás kereteit is. Erről volt szó az ELTE pénteki minikonferenciáján.

A ChatGPT a trollok munkáját is elveszi, és erre a kibervédelemnek is fel kell készülnie

A mesterséges intelligencia, különösen a nagy nyelvi modellek kiváló alternatívái a fizetett hülyéknek, így propagandacélokra is könnyűszerrel bevethetők.

„Ha a ChatGPT nem ismerné a kereket, magától nem tudná feltalálni”

Pótolhatatlan tudományos asszisztens vagy béna bullshitgenerátor? Milyen szerepe lehet napjaink első számú gépsztárjának a tudományban? Aki válaszol: Kornai András matematikai nyelvész, Kmetty Zoltán szociológus és Nagybányai-Nagy Olivér pszichológus.

Kapcsolódó cikkek