Úgy tűnik, hogy a Facebook helyrehozhatatlan társadalmi károkat okozott

A múlt héten olyasmi történt, amire régen volt példa: a Meta (leánykori neve: Facebook) PR-osztályán elégedetten dőlhettek hátra, miután végigböngészték a tech- és tudományos sajtót. A legnagyobb tudományos lapokban, a Science-ben és a Nature-ben ugyanis megjelentek azok a tanulmányok, amelyekben a Meta munkatársai független kutatókkal együtt vizsgálták – még a 2020-as amerikai elnökválasztási kampány idején –, hogy mekkora a közösségi média hatása a demokráciára. Miután semmilyen bombasztikus eredményre nem jutottak a polarizáció csökkentésére tett kísérletekben, úgy tűnik, az lett a konszenzus, hogy a Facebook-algoritmusnak talán még sincs olyan nagy társadalomformáló hatása, mint korábban gondolták.

Az eredmény kapóra jön Mark Zuckerberg cégének, ami hosszú évek óta kitartóan gyakorolja a felelősséghárítás művészetét, és amit legalább a 2016-os választási kampány óta vádolnak azzal, hogy túl nagy befolyással bír a felhasználóinak gondolkodására, és óriási a felelőssége az amerikai társadalom egyre nagyobb megosztottságában. Csakhogy a 2020-as kísérletekben részt vevő független kutatók szerint a cég hiába osztott meg velük korábban nem látott mennyiségű adatot a felhasználók viselkedéséről, az egyes kísérletek mindössze három hónapig tartottak – azon meg ne kelljen már csodálkozni, hogy miután évtizedes adatgyűjtés után jobban ismer minket a Szent Algoritmus, mint ki-ki önmagát, három hónap alatt nem lehet kirángatni az embereket a buborékjaikból.

„Azt találtuk, hogy az algoritmusok rendkívüli befolyással bírnak az emberek élményeire a platformon, és jelentős ideológiai szegregáció figyelhető meg a politikai híreknek való kitettségben – mondta az AP hírügynökségnek Talia Jomini Stroud, az austini Texasi Egyetem médiakutatója, az egyik tanulmány vezető szerzője. – Emellett arra jutottunk, hogy a közösségi média algoritmusainak megváltoztatására irányuló népszerű javaslatok nem befolyásolták a politikai attitűdöket.”

Három hónap alatt nem lehet csodát tenni

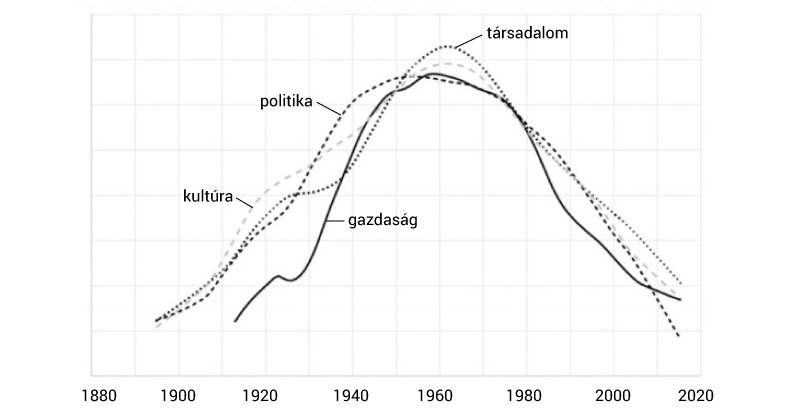

Az amerikai társadalom a legújabb kutatások szerint a 19. század közepén vívott polgárháború óta nem volt olyan megosztott, mint ma, és bár a politikai véleménykülönbség egyébként nem ördögtől való egy demokráciában, a polarizáció jelensége túlmutat ennél: olyan ideológiai törésvonalat jelent, amely az átjárhatatlanságig sodorja egymástól a két szembenálló oldalt. Ennek szélsőséges esete az affektív (vagy érzelmi) polarizáció, amelynek megvalósulásakor a két nagy társadalmi tömb már az ellenséget látja egymásban. Ez a fajta megosztottság nemcsak a demokratikus intézményekbe vagy a szabad sajtóba vetett hit gyengülésével jár, hanem erőszakos eseményekbe is torkollhat – lásd az USA Capitoliumának ostromát 2021. január 6-án.

A most megjelent tanulmányokban arra jutottak, hogy ez a polarizáció nagyon is jelen van a Facebookon, de kérdéses, hogy ebben mekkora a platform felelőssége. A Nature-ben közzétett, több mint 23 ezer felnőtt amerikai felhasználó adatait feldolgozó kutatás szerint az internetezők elé kerülő tartalmak többsége olyan emberektől, oldalakról vagy csoportokból származik, akikkel és amikkel az illető ideológiailag azonosul. Amikor a kutatók az összes megjelenő tartalom harmadára csökkentették az adott felhasználók ideológiájának megfelelő posztokat, hogy változatosabb hírforrásokból tájékozódjanak, nem történt csoda: három hónap elteltével semmit sem változott a politikai meggyőződésük. Sandra González-Bailón, a Pennsylvaniai Egyetem kommunikációkutatója vezetésével sikerült megerősíteni a visszhangkamrák (vagy buborékok) létezését: „A Facebook mint társadalmi és információs színtér ideológiailag jelentősen szegregált.” Az oldalon terjedő álhírek azért leginkább a konzervatív követőkhöz jutnak el: a megbízhatatlannak bélyegzett források 76 százalékát konzervatívok látogatták, míg az összes álhír 97 százaléka szólt elsősorban konzervatív közönségnek.

A Princeton Egyetem kutatói két kísérletet is végeztek a Facebook algoritmusával, mindkettő eredménye a Science-ben jelent meg. Az egyikben a távolabbi forrásból eredő, de egy általuk követett oldalon vagy csoportban, esetleg ismerőseik által újra megosztott tartalmakat tüntették el három hónapra a résztvevők szeme elől. A virális posztok kinyírásával jelentősen csökkent a felhasználók aktivitása a Facebookon, de így nemcsak az álhírekből, hanem a megbízható hírforrásokból is 62 százalékkal kevesebbet láttak. A kísérletet követő kérdőívek alapján a polarizáció nem csökkent, de közben még tájékozatlanabbá is váltak az alanyok. A másik princetoni kutatásban egész egyszerűen kiiktatták az algoritmust, és időrendi sorrendben mutatták meg a posztokat a résztvevőknek, a legfrissebbekkel kezdve. Ezzel több politikai tartalom került a felhasználók elé (mind megbízható, mind kétes forrásból), akik jóval kevesebb időt töltöttek emiatt a platformon. A vége ugyanaz: semmi jelentős változás a polarizációt tekintve.

Ezeket az eredményeket kétféleképpen lehet értelmezni. Ha nem vesszük figyelembe az elmúlt bő tíz évet, és csak a négy tanulmány konklúziójára támaszkodunk, akár olyan következtetést is levonhatunk, mint Nick Clegg, a Meta globális ügyekért felelős elnöke (és volt brit miniszterelnök-helyettes), aki blogposztjában azt írta: „A kísérletek azt mutatják, hogy kevés bizonyíték van arra, hogy a Meta platformjainak alapvető jellemzői önmagukban káros, affektív polarizációhoz vezetnek, vagy jelentős hatást gyakorolnak a politikai attitűdökre, meggyőződésekre vagy viselkedésre”.

Ha viszont figyelembe vesszük az elmúlt bő tíz évet, akkor valami olyasmi juthat eszünkbe, mint a Science főszerkesztőjének, Holden Thorpnak, aki előszavában azt írta: „A Facebook már olyan hatékony munkát végezhetett abban, hogy a vágyaikat kielégítő feedhez szoktassa a felhasználókat, hogy azok már megváltoztathatatlanul szegregálódtak.” Vagy ahogy Joshua Tucker, a New Yorki Egyetem Közösségi Média és Politika Kutatóközpontjának munkatársa, a projekt egyik felügyelője mondta a Nature-nek: „Ezek az eredmények azt nem tudják megmondani, hogy mi lett volna, ha nincs a kezünkben a közösségi média az elmúlt 10-15 évben.”

Miért, mi történt az elmúlt bő tíz évben?

A Facebook bűnlajstroma szinte felsorolhatatlanul hosszú, de rögtön az első nagyobb botránya egy olyan pszichológiai kísérletet érintett, amiből kiderült, a cég igenis képes tömegesen befolyásolni a felhasználóit. 2012-ben 700 ezer embert osztottak tudtuk nélkül két csoportra, hogy kipróbálják, mi történik, ha eltüntetik a hírfolyamukból a pozitív, illetve negatív töltetű posztokat. Mint kiderült, a felhasználók maguk is az általuk látott posztoknak megfelelő hangulatú tartalmakat osztottak meg, így valószínűleg a közérzetükre is hatással volt a titkos kísérlet. Vagyis egy héten át manipulálták emberek tömegeinek érzelmeit, amit két évvel később, amikor kiderült az eset, a cég egyik akkori vezetője, Sheryl Sandberg elintézett ennyivel: „Ez egy olyan kutatás része volt, amit a cégek a különböző termékek tesztelésére végeznek, és ennyi. Rosszul kommunikáltuk, és ezért a kommunikációért bocsánatot kérünk. Senkit nem akartunk felzaklatni.”

Aztán jött a 2016-os amerikai elnökválasztás. A BuzzFeed napokkal Donald Trump megválasztása után tette közzé elemzését, amelyből kiderült, hogy a Trumpot és Hillary Clintont érintő álhírek az év augusztusától már több embert értek el az oldalon, mint a valódiak. A választást megelőző három hónapban egy Ending the Fed nevű Facebook-oldal posztja generálta a legtöbb, 960 ezer interakciót (lájk, komment, megosztás), miszerint „Ferenc pápa sokkolta a világot, közleményben támogatja Donald Trump elnökké választását”, de a Washington Post, a New York Times vagy a CNN olyan bejegyzésekkel sem tudta felvenni a versenyt elérésben, amelyek szerint Clinton terroristáknak adott el fegyvereket vagy FBI-ügynöket gyilkoltatott meg. Ezért már magának Zuckerbergnek kellett magyarázkodnia, ő pedig a szokásos módon reagált: komolyan veszik a problémát, és nagy erőket fektetnek abba, hogy ez ne fordulhasson elő többet.

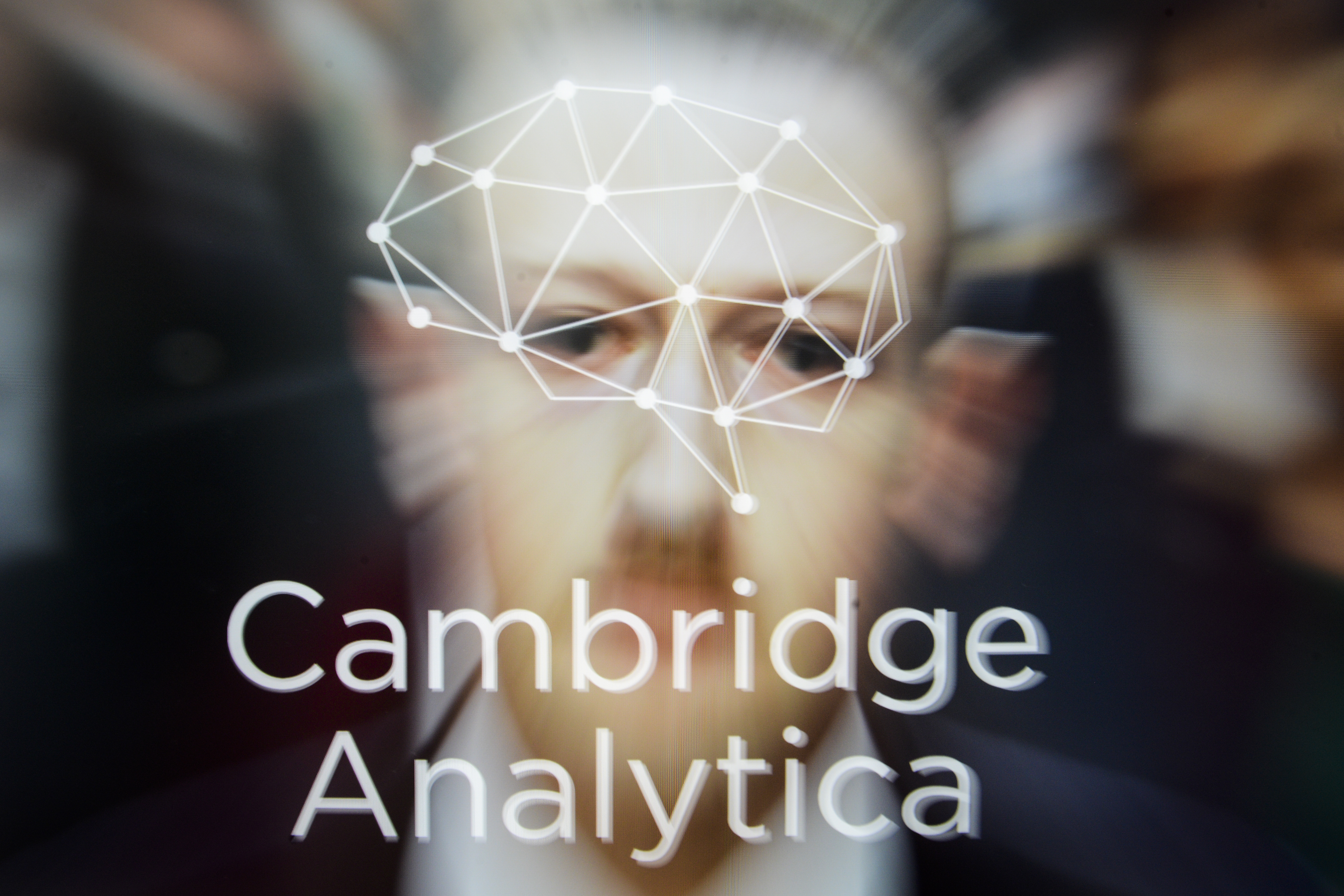

Erre tett rá még egy lapáttal a cég történetének egyik, ha nem a legnagyobb botránya. A politikai tanácsadással foglalkozó brit cég, a Cambridge Analytica (CA) egy korábbi alkalmazottja 2018-ban mesélte el a sajtónak, hogyan használta ki a vállalat a Facebook adatgyűjtési gyakorlatát arra, hogy 87 millió felhasználó személyes adatai alapján pszichológiai profilokat alkosson, amiket célzott politikai hirdetésekhez tud felhasználni – természetesen a felhasználók tudta nélkül. Többek között Trump 2016-os kampányát segítették így a Facebookon, és bár azt valószínűleg soha sem tudjuk meg, hogy ez mekkora löketet adott a Trump-kampánynak, a szoros eredmény láttán felmerülnek kérdések. Az FBI nyomozást indított, mire a CA csődöt jelentett, a Facebookra pedig végül 5 milliárd dolláros rekordbírságot szabott ki a Szövetségi Kereskedelmi Bizottság (FTC), de azóta még jóval többe került a cégnek az adatszivárgás – még tavaly decemberben is 725 millió dollárral kellett kiengesztelniük egy csapat pereskedőt.

Kétpárti szenátusi bizottság mondta ki: a Facebook hidat teremt a demokráciák és a diktatúrák között

Amikor 2017-ben kezdett világossá válni, hogy az orosz propaganda online terjesztéséért felelős szentpétervári trollfarm (az úgynevezett Internet Research Agency) olyan fizetett hirdetéseket tolt a Facebookon, amik így vagy úgy Trump malmára hajtották a vizet, a Facebook vezetői a jól bevált „nem média-, hanem techcég vagyunk” mantrával hárították a felelősséget. Egy évvel később viszont már az amerikai szenátus kétpárti hírszerzési bizottsága mondta ki, milyen hatékonyak voltak a közösségi médiában terjedő, változatos módszereket alkalmazó orosz dezinformációs kampányok: hol Clinton-ellenes tüntetésre buzdították a népet, hol Trumpot tették meg a kereszténység megmentőjének, hol pedig inkább arra játszottak, hogy minél kevesebben induljanak el a szavazófülkékhez a választás napján. A – még egyszer, kétpárti – bizottság lesújtó ítélete szerint

„a közösségi média a kollektív sérelmek megosztásának és a civil szerepvállalásnak természetes infrastruktúrájából ravasz politikai tanácsadók által manipulált, a társadalom irányítására szolgáló technológiai eszközzé vált, amit demokráciákban és diktatúrákban is ugyanúgy fel tudnak használni a politikusok”.

Aki megkérdőjelezi a Facebook társadalmi felelősségét, az már biztosan nem emlékszik arra, amikor 2016–17-ben rohingyák tízezreit ölték meg és további százezreknek kellett elmenekülniük Mianmarból, miután etnikai tisztogatás célpontjai lettek – amit az ENSZ vizsgálata szerint a Facebookon terjedő álhírek is szítottak. Vagy mondjuk arra, hogy miközben a cégen belül is tisztában vannak vele, hogy a közösségimédia-használat miatt egyre több a depressziós és szorongó fiatal, az Instagram pedig különösen rossz hatással van a tinilányok lelki egészségére és önértékelésére, a Facebook egyre fiatalabb korcsoportokat célozna termékeivel.

A fentiek egy részét azokból a belső dokumentumokból tudjuk, amiket 2021-ben szivárogtatott ki Frances Haugen, aki két évig dolgozott a Facebook Civic Integrity nevű tartalom-ellenőrző csapatában, ahol azt vizsgálták, hogyan használhatják a platformot politikai manipulációra, erőszakra való buzdításra vagy a demokrácia aláásására. Haugen később a kongresszus előtt is elmondta, hogy a cégnek fontosabb a profit, mint felhasználóinak biztonsága vagy mentális egészsége. Vagy ahogy a CBS 60 Minutes című műsorában fogalmazott: „Összeférhetetlenség alakult ki aközött, hogy mi szolgálja a közjót, és mi a Facebook érdekeit, a Facebook pedig újra és újra a saját érdekei mentén, a még nagyobb bevételek érdekében hozott döntéseket.”

Az interneten kétfajta identitás van: a tiéd meg az ellenségedé

Az Amszterdami Egyetem Nyelv, Logika és Számítás Intézetének kutatója, Petter Törnberg, aki a közösségi média, a politika és a mesterséges intelligencia határait vizsgálja, 2022 októberében egy új elméletet alkotott arról, hogy a digitális platformok miként okozzák a gyűlölködéstől hangos társadalmi megosztottságot, az affektív polarizációt. Ezt két egyszerű úton érik el: lehetővé teszik, hogy olyanokkal álljunk szóba, akikkel közösségi média nélkül nem beszélnénk, miközben arra ösztönöznek, hogy a sajátunkéhoz hasonló vélemények felé közelítsünk.

Törnberg szerint tehát nem az a baj a közösségi médiával, hogy buborékba terel minket és elzár a különböző véleményektől, hanem épp az, hogy összekapcsolja az embereket. Az internet előtt ugyanis a fizikai térben, lokálisan osztódtak csoportokra az emberek, mindenféle társadalmi mutató alapján, ami kevesebb lehetőséget adott a politikai-ideológiai konfliktusokra: lehet, hogy Sanyi fideszes, Kornél pedig baloldali, de ha mindketten nagy fradisták és szeretnek horgászni, ráadásul a gyerekeik is egy osztályba járnak, szívesebben félretették a pártpolitikai nézeteltéréseiket, mint ha csak egy profilkép és egy név lennének egymásnak a Facebookon, akiről semmi mást nem tudnak, és csak egymás túlfűtött kommentjére reagálnak. Ha valakinek csak az oltásellenes posztjaival találkozunk online, miközben mi büszkén beadattuk a covid boostert is, az első pillanattól olyan ideológiai törésvonal alakul ki, ahol aztán már nem számít, hogy éppen mindkét oldalon szerető férj, családapa és megbízható munkaerő áll, akiknek még a zenei ízlésük is hasonló, és jót tudnának beszélgetni a 80-as évek magyar filmjeiről is – a kezdeteknél eldől, hogy egymás esküdt ellenségei, akiknek élni sincs joguk, csak mert egy dologban nem értenek egyet.

És mivel a platformoknak – például a Facebooknak – az az érdekük, hogy minél több időt töltsünk rajtuk, általában olyan tartalmakkal látnak el, amikről már előre tudják, hogy tetszenek majd. Kedvenc focicsapat hírei, egyszer lájkolt véleményvezér posztja egy aktuális botránytémában, új bejegyzés a retró mobilos csoportból („lájk, ha neked is megvolt ez a régi Nokia”), a vérmérsékletünknek és pártpreferenciánknak megfelelő videós beszámoló a Pride-ról. Majd miután mindenféle identitásunk politikai színezetet kapott, megyünk a kommentszekcióba lájkokkal támogatni a harcostársakat és odamondós hozzászólásokkal hergelni az ellenséget.

Az interakciók azért fontosak a Facebooknak, hogy legyen miből megállapítani, milyenek a felhasználók, mit szeretnek, hova sorolják magukat – vagyis milyen hirdetéseket lehet rájuk hatékonyan targetálni. Ahogy Törnberg mondja: „Ezért van minden önkifejezésként keretezve. Ez egy identitásalapú politikát eredményez, ami pontosan olyan környezet, amilyet akkor teremtenénk, ha növelni akarnánk a polarizációt.”

Kapcsolódó cikkek a Qubiten:

A Facebook jól tudja, milyen károkat okoz a társadalomban, de a profit fontosabb

A nagy hétfői Facebook-leállás rögtön a cég eddigi legnagyobb botrányát követte. Egy korábbi alkalmazott több ezer belső dokumentumot szivárogtatott ki, amelyek szerint a Facebook tisztában van a demokráciára, a fiatalok mentális egészségére és az általános közbeszédre gyakorolt negatív hatásaival, és bűncselekmények fölött is szemet huny, ha nem az USA-ban történnek.

Amerikai szenátus: a közösségi média hidat teremtett a demokráciák és a diktatúrák között

Az orosz állami trollgyár több száz milliós elérést produkált az amerikai elnökválasztási kampány ideje alatt – a friss jelentésből kiderül, hogy a feketéket otthonmaradásra, a republikánusokat erőszakra biztatták a Facebookon, az Instagramon, de még a Pinteresten is.

Lawrence Lessig Budapesten: Ha nem tudjuk szabályozni az algoritmusokat, ők fognak szabályozni minket

A Facebook és a nagy platformok üzleti modellje az emberek butítása és megosztása lett, ezért a demokrácia védelmében nincs más választás, mint felülről szabályozni, mondta a Harvard jogászprofesszora pénteki előadásán. Erre még úgy is van lehetőség, hogy ne sérüljön a szólásszabadság, de az biztos, hogy le kell lassítani a vadul terjedő álhíreket, a cégeknek pedig felelősséget kell vállalniuk tetteikért.

Kapcsolódó cikkek