A gyilkos robotok elleni harc az egyetemeken kezdődik

„A világjárvány során a háborús zónákon túl is láthatóvá váltak az egyenlőtlenségek, közösségeket és országokat fordítva egymás ellen. Itt az idő, hogy elhallgattassuk a fegyvereket, és a közös ellenségünkre koncentráljunk: a vírusra” – mondta António Guterres, az ENSZ főtitkára a szervezet által 1982-ben bevezetett, minden év szeptember 21-én tartott Nemzetközi Békenapra készülve. A járvány azonban egy másik problémának is megágyazott: a kontaktuskerülés és a távolságtartás hangsúlyozásával az emberi jelenlétet nem igénylő fegyverrendszerek is felértékelődtek.

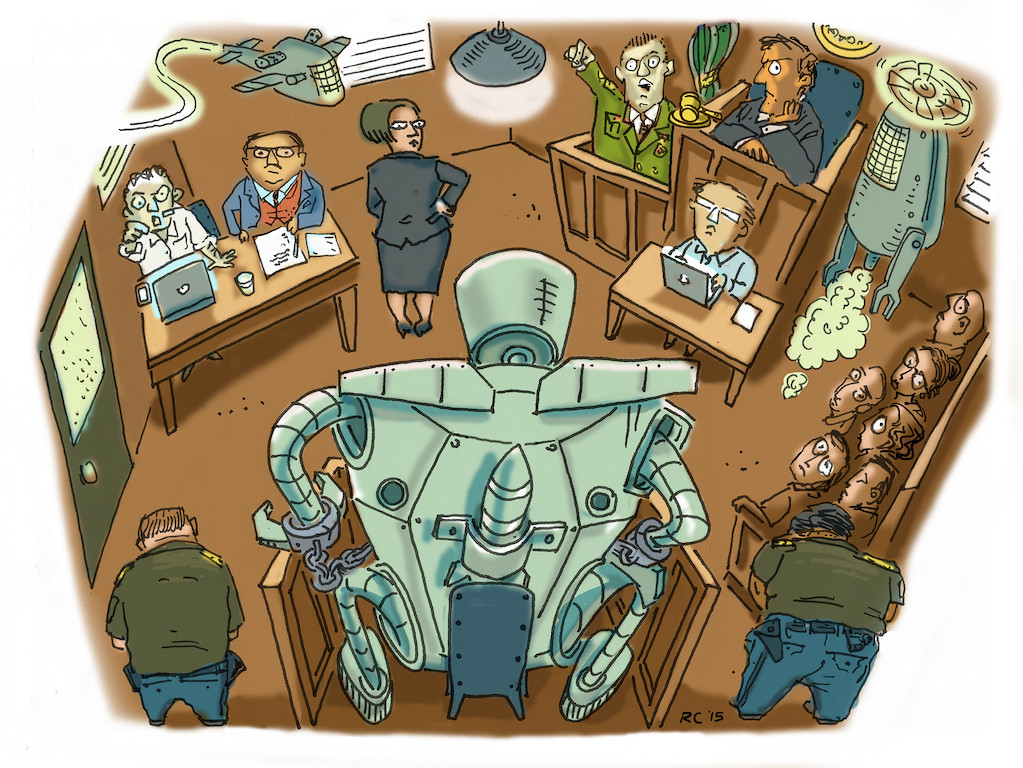

A Pentagon legfrissebb adatai szerint az amerikai hadseregben már legalább 60 ezren fertőződtek meg a világjárvány kezdete óta, ami új stratégiai megoldások felé hajthatja a katonai vezetőket. Sosem volt még ilyen könnyű dolguk azoknak, akik a mesterséges intelligenciával (AI) felvértezett halálos autonóm fegyverek, vagyis a gyilkos robotok bevetése mellett szeretnének érvelni. Miért is kellene például az amerikai katonáknak fertőzésveszélyes országokban állomásozni, ha a feladataikat már AI-vezérelt gépek is el tudják végezni?

Hús-vér ütközetekből a videojátékok szintjére süllyed a hadviselés

A hadviselésnek a politikai és gazdasági áldozatokon túl etikai, morális és pszichés ára is van, ezek összessége pedig visszatartó erőként is hat a fegyveres konfliktusokra készülő államok számára. Az elmúlt években azonban már megtapasztalhatták, milyen az, amikor ezeket kiveszik a háború képletéből: a távolból irányított drónoknak köszönthetően a támadások súlytalanná váltak, a háborúzás elkezdett a videojátékokhoz hasonlítani, hiszen a világ másik feléről, egy képernyő előtt ülve másképp hoz döntést az ember, mint a csatatéren, éles helyzetben, a halálfélelem által korlátozva.

A halálos autonóm fegyverek a maradék emberi tényezőtől is megfosztanák a háborúzást, és így a nagyhatalmak vezetőinek sem kellene többé azon töprengeni, hogy vajon mit szól majd a nép egy idegen ország megszállásához, vagy egy politikailag fontosnak tartott katonai akció levezényléséhez. Az egyre összetettebb globális rendszerek ráadásul előre nem látható veszélyeket is tartogathatnak – hasonlóan az amerikai jelzáloghitel-válságból kiindult globális gazdasági összeomláshoz, vagy az embereket összekötni kívánó, az információ szabadságát hirdető Facebook történetéhez, amely hozzájárult az álhírek és a dezinformáció terjedéséhez, valamint a populista rezsimek és a polarizált társadalmak kialakulásához.

Mark Esper amerikai védelmi miniszter egy szeptemberi szimpóziumon kijelentette, hogy az újra előtérbe került nagyhatalmi versengés egyik sarokköve a mesterséges intelligencia fejlesztése. Esper szerint az AI alapjaiban változtathatja meg a hadviselést, és az az ország, amely elsőként tesz szert hatékony AI-fegyverekre, hatalmas előnyből indul majd a versenytársakkal szemben – a miniszter kínai és orosz példákat emlegetett. Esper az eseményen a már elért eredményekről is beszámolt, például arról, hogy szimulációk során már esélyük sincs a vadászpilótáknak az AI ellen, és ezt éveken belül a való életben is hasznosíthatják.

A honvédelem és a fegyveripar is önti a pénzt az egyetemekhez

A PAX nevű nemzetközi békeszervezet magyar nyelven frissen megjelent jelentése arra hívja fel a figyelmet, hogy az innováció fejlődésében kulcsszerepet játszó egyetemek könnyen áldozatul eshetnek a felsőbb érdekeknek, így kutatóik a tudtukon kívül járulhatnak hozzá a halálos autonóm fegyverek technológiai alapjainak megteremtéséhez. Ezért is aggasztó, hogy az elmúlt években jelentősen megnőtt az egyetemi kutatás-fejlesztés ipari támogatása, nemcsak az Egyesült Államokban, de Kínában, Japánban, Ausztráliában, Nagy-Britanniában és az Európai Unión belül is. A védelmi minisztériumok mellett a fegyvergyártó cégek is együttműködéseket kötnek az egyetemekkel, de a kutatások valódi célja a hallgatók előtt titkos marad.

„A hadiiparral való együttműködés önmagában nem feltétlenül jelent problémát. Vannak olyan alkalmazásai az új technológiáknak, amelyek kevésbé megosztók, ilyenek például a repülőgépek fel- és leszállását, vagy a navigációt segítő autonóm rendszerek. Nagyon fontos azonban az, hogy az egyetemek tisztában legyenek azzal, hogy a jövőben milyen egyéb felhasználási módjai lehetnek az általuk fejlesztett technológiáknak” – írja a jelentés.

Mivel a civil és a katonai célú tudásfejlesztés közötti határ egyre inkább elmosódik, egyre fontosabbá válik, hogy az egyetemek tisztában legyenek ezzel a problémával. A PAX jelentése röviden bemutatja, hogy egyes egyetemek milyen katonai projektek részeseivé váltak, és felhívja a hallgatók, az egyetemi dolgozók és minden érdeklődő figyelmét a halálos autonóm fegyverekkel kapcsolatos aggályokra. „Félő, hogy amennyiben az egyetemek nem dolgoznak ki megfelelő irányelveket, az egyes, nem katonai célokra szánt technológiákat végül mégis fegyverrendszerekben használhatják fel.”

Az egyetemek és hallgatóik csak együtt előzhetik meg a tudomány újabb halálos szégyenét

Sokan elfelejtik, hogy a nukleáris fegyver megalkotását célzó Manhattan terv is az amerikai egyetemek kutatásaira támaszkodott, Hirosima és Nagaszaki bombázása után viszont már késő volt sajnálkozni a technológia fejlesztésében való részvétel miatt. Az Egyesült Államok védelmi minisztériuma mindenesetre az elmúlt két évtizedben megduplázta a K+F projektekre fordított összeget (35,5-ről 68,3 milliárd dollárra), amely javarészt az egyetemeknél köt ki. Bár a támogatás nagyobb részét nem fegyverekkel kapcsolatos kutatásokra fordítják, az MIT egyik kutatója szerint „nincs olyan, hogy ingyen ebéd, és a Pentagon nem osztogat pénzt csak azért, hogy jól menjen a tudománynak”.

A jelentés azokat a kutatási területeket is megjelöli, amelyek magukban hordozzák azt a kockázatot, hogy a fejlesztett technológiát AI-fegyverekben igyekeznek felhasználni: ide tartozik a szenzoros technológiák (kamerák, radar, linar); az objektumok észlelésére, azonosítására és követésére szolgáló szoftverek és a kapcsolódó hardverek (chipek, félvezetők); valamint a robotikai rendszerek kutatása.

A hallgatók és az egyetemi dolgozók kezében lévő legjobb eszközök a korábbi tapasztalatok alapján az AI-technológiák fejlesztését felügyelő etikai bizottságok létrehozása, nyílt levelek fogalmazása, valamint a témában tartott események és workshopok szervezése, a katonai jellegű kutatásokkal kapcsolatos párbeszéd ösztönzése. Az egyetemek ezenfelül testületileg is felléphetnek a gyilkos robotok fejlesztésének megelőzése céljából, többek között azzal, hogy nyilvánosan ígéretet tesznek és egyértelmű szabályokat alakítanak ki ennek érdekében, valamint biztosítják a kutatások finanszírozásának átláthatóságát.

A teljes jelentést (Alkotni vagy pusztítani? – A két tűz közé szorított értelem) ide kattintva lehet elolvasni.

Kapcsolódó cikkek a Qubiten:

A technológia megkönnyíti ugyan a háborúzást, de embertelenné teszi az embert

Minél távolabbról tud ölni az ember, annál jobban mosódnak el az erkölcsi határok. Ezt állítja Anthony Swofford, a Bőrnyakúak öbölháborús veterán szerzője, és erről beszélt már 1993-ban Bruce Sterling, a cyberpunk-irodalom legendás szerzője is.

A gyilkos robotokat még azelőtt be kell tiltani, hogy elkezdenék a gyártásukat

A mesterséges intelligenciával rendelkező, emberi felügyelet nélkül támadni képes fegyverek előzetes tiltása mellett érvel az a jelentés, amelyet az Állítsuk meg a gyilkos robotokat nevű kampány magyar aktivistái az egyetemeken és a parlamentben is terjesztenek majd.

A Magyar Honvédség ismerkedik a mesterséges intelligenciával, és megcélozza a fiatalságot

Magyarországon meglepően nagy arányban állítanák vissza a sorkatonaságot a huszonévesek, de a fiatalabbak pont nem a megfelelő generációba születtek ahhoz, hogy érdekelje őket a honvédelem. Közben az USA és Kína elszáguld az európai háborús technológia mellett.